支援向量機(SVM)第四章---支援向量迴歸

簡單總結一下自己對SVM的認識:有一條帶區域,固定差距為1,希望最大化間隔

SVR同樣有這樣的一條帶,迴歸的時候,落入帶內的點,損失為0,只記錄落入帶外的點的損失值。

SVR形式化表示:

其中第一項是正則化項,後面的損失函式是

引入鬆弛變數,可以重寫為:

引入拉格朗日乘子,得到原問題的對偶問題:

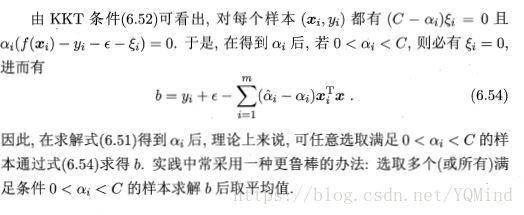

滿足的KKT條件:

其中,

相關推薦

支援向量機(SVM)第四章---支援向量迴歸

簡單總結一下自己對SVM的認識:有一條帶區域,固定差距為1,希望最大化間隔 1||w|| 1 |

支援向量機(SVM)第三章---軟間隔

參考周老師《機器學習》 在前面兩章裡,我們都是假設樣本在原始空間或者高維空間裡線性可分,並且我們提到核函式的選擇成為SVM的關鍵。即使我們找到了合適的核函式,也難斷定是否是因過擬合造成的。 引入軟間隔,允許一些樣本不滿足約束條件。在前面兩章所介紹的都是硬間隔,即所有樣本都必須滿足約束

資料探勘十大演算法——支援向量機SVM(四):SMO演算法原理

首先感謝“劉建平pinard”的淵博知識以及文中詳細準確的推導!!! 支援向量機原理SVM系列文章共分為5部分: (一)線性支援向量機 (二)線性支援向量機的軟間隔最大化模型 (三)線性不可分支援向量機與核函式 (四)SMO演算法原理 (五)線性支援迴歸

從零開始Desire HD刷機指南 —— 第四章:瞭解你的手機資訊

原文地址:http://blog.sina.com.cn/s/blog_722b43a60100q5ht.html 本教程由symen 原創,轉載請註明出處。 看完前面的文章,大家應該對android 系統有個初步的概念了吧。在刷機之前,讓我們繼續學習一些基礎知識。

吳恩達機器學習(第十三章)---支援向量機SVM

一、優化目標 邏輯迴歸中的代價函式: 畫出兩種情況下的函式影象可得: y=1: 我們找一條折線來近似表示這個函式影象 y=0: 我們用這兩條折線來近似表示原來的曲線函式可得新的代價函式(假設-log(h(x))為,-log(1

第七章 支援向量機(SVM)

1.1 支援向量機 1.1.1 定義 支援向量機(support vector machine)是一種二分類模型,它的基本模型是定義在特徵空間上的間隔最大的線性分類器間隔最大使它有別於感知機。支援向量機的學習策略是間隔最大化,支援向量機的學習演算法是求解凸二次規劃的最優化演算法。

【機器學習實戰】第6章 支援向量機(Support Vector Machine / SVM)

第6章 支援向量機 <script type="text/javascript" src="http://cdn.mathjax.org/mathjax/latest/MathJax.js?config=default"></script>

《機器學習》 周志華學習筆記第六章 支援向量機(課後習題)python 實現

一、 1.間隔與支援向量 2.對偶問題 3.核函式 xi與xj在特徵空間的內積等於他們在原始yangben空間中通過函式k(.,.)計算的結果。 核矩陣K總是半正定的。 4.軟間隔與正則化 軟間隔允許某些samples不滿足約束 鬆弛變數 5.支援

[四]機器學習之支援向量機SVM

4.1 實驗資料 本資料集來源於UCI的Adult資料集,並對其進行處理得到的。資料集下載地址:http://archive.ics.uci.edu/ml/datasets/Adult。本實驗使用LIBSVM包對該資料進行分類。 原始資料集每條資料有14個特徵,分別為age,workc

《機器學習實戰》第六章----支援向量機

支援向量機 SVM(Support Vector Machine)實際上是應用於二分類的一個分類器,其基本模型定義為特徵空間上的間隔最大的線性分類器,其學習策略便是間隔最大化,最終可轉化為一個凸二次規劃問題的求解。這裡不對整個過程進行推導,因為看了很多部落格,有幾篇大佬的部落格寫的非

《統計學習方法》第 7 章“支援向量機”導讀

目錄 《統計學習方法》第 7 章“支援向量機”導讀 學習“支援向量機”的步驟 第 1 階段:嚴格線性可分支援向量機 第 2 階段:差一點線性可分的支援向量機 理解鬆弛變數 什麼是懲罰係數 \(C\) ?

Stanford機器學習 第八講 支援向量機SVM

set type of SVM (default 0) 0 -- C-SVC 1 -- nu-SVC 2 -- one-class SVM 3 -- epsilon-SVR 4 -- nu-SVR-t kernel_type : set type of kernel functi

《機器學習(周志華)》——第6章 支援向量機

1、間隔與支援向量 (1)分類學習的最基本思想就是:基於訓練集D在樣本空間中找到一個劃分超平面,將不同類別的樣本分開。 (2)在樣本空間中,用線性方程來表示劃分超平面:ωTx + b = 0 ;其中ω = (ω1;ω2; … ; ωd)為法向量,決定超平面內的方向;b

Stanford機器學習---第八講. 支援向量機SVM

本欄目(Machine learning)包括單引數的線性迴歸、多引數的線性迴歸、Octave Tutorial、Logistic Regression、Regularization、神經網路、機器學習系統設計、SVM(Support Vector Machines 支援向量

機器學習實戰第六章支援向量機照葫蘆畫瓢演算法實踐

支援向量機簡要介紹 一些概念: 1.分隔超平面:在二維中直觀來說就是將資料集分隔開來的直線,三維中則是一個平面。觸類旁通。 2.超平面:分類的決策邊界,分佈在超平面一側的所有資料都屬於某個類別,另一側屬於另一個。 3.支援向量:離分隔超平面最近的那些

周志華《機器學習》第 6 章 支援向量機

本文是 周志華《機器學習》系列文章 之一,主要介紹支援向量機函式及核函式等概念。 第 6 章 支援向量機 6.1 間隔與支援向量 給定訓練樣本集分類學習最基本的想法就是基於訓練集 D 在樣本空間中找到一個劃分超平面,將不同類別的樣本分開。 在樣本

《機器學習實戰》第6章支援向量機(程式碼)

'''Created on Nov 4, 2010Chapter 5 source file for Machine Learing in Action@author: Peter'''from numpy import *from time import sleepdef

【機器學習實戰】第6章 支援向量機

def smoSimple(dataMatIn, classLabels, C, toler, maxIter): """smoSimple Args: dataMatIn 特徵集合 classLabels 類別標籤 C 鬆弛變數

《Hands-On Machine Learning with Scikit-Learn & TensorFlow》讀書筆記 第五章 支援向量機

第5章 支援向量機 支援向量機(SVM)是個非常強大並且有多種功能的機器學習模型,能夠做線性或者非線性的分類,迴歸,甚至異常值檢測。機器學習領域中最為流行的模型之一,是任何學習機器學習的人必備的工具。SVM 特別適合應用於複雜但中小規模資料集的分類問題。

[完]機器學習實戰 第六章 支援向量機(Support Vector Machine)

[參考] 機器學習實戰(Machine Learning in Action) 本章內容 支援向量機(Support Vector Machine)是最好的現成的分類器,“現成”指的是分類器不加修改即可直接使用。基本形式的SVM分類器就可得到低錯