steepest descent for Euclidean norm 最速下降法中二次範數的下降方向

在無約束優化中,設f(x)是凸函式。可以通過∂f(x)=0求解,如果不能直接得到解析解,可以通過構造一個序列,x0,x1,...,xk,使得f(x0)>f(x1)>...>f(xk),給定一個閾值η,當▽f(x)<η停止。

x:=x+tΔx (f是凸函式,滿足f(y)≥f(x)+▽f(x)TΔx)

於是就有了

一般下降方法General Descent Method: 給定一個初始值x, 重複以下步驟:

- 確定下降方向Δx

- 確定步長t(1.Exact line search, 2.Backtracking line search)

- 更新x,x=x+tΔx 直到滿足停止條件

梯度下降法,就是Δx=−▽f(x),停止準則是∣∣▽f(x)∣∣2≤η

下面介紹最陡下降法Steepest descent method

f(x)的一階展開式為f(x+v)≈f(x)+▽f(x)Tv,選擇一個方向v使f(x+v)最小,這個方向就是最陡下降法的方向。v大小要有一個限制,才有意義。

Δxnsd=argmin{▽f(x)Tv∣∣∣v∣∣≤1}

Δxsd=∣∣▽f(x)∣∣∗Δxnsd,這是最陡下降法的方向

根據範數的不同有幾個不同的方向。

歐幾里得範數Euclidean norm

方向就是Δxsd=−▽f(x)

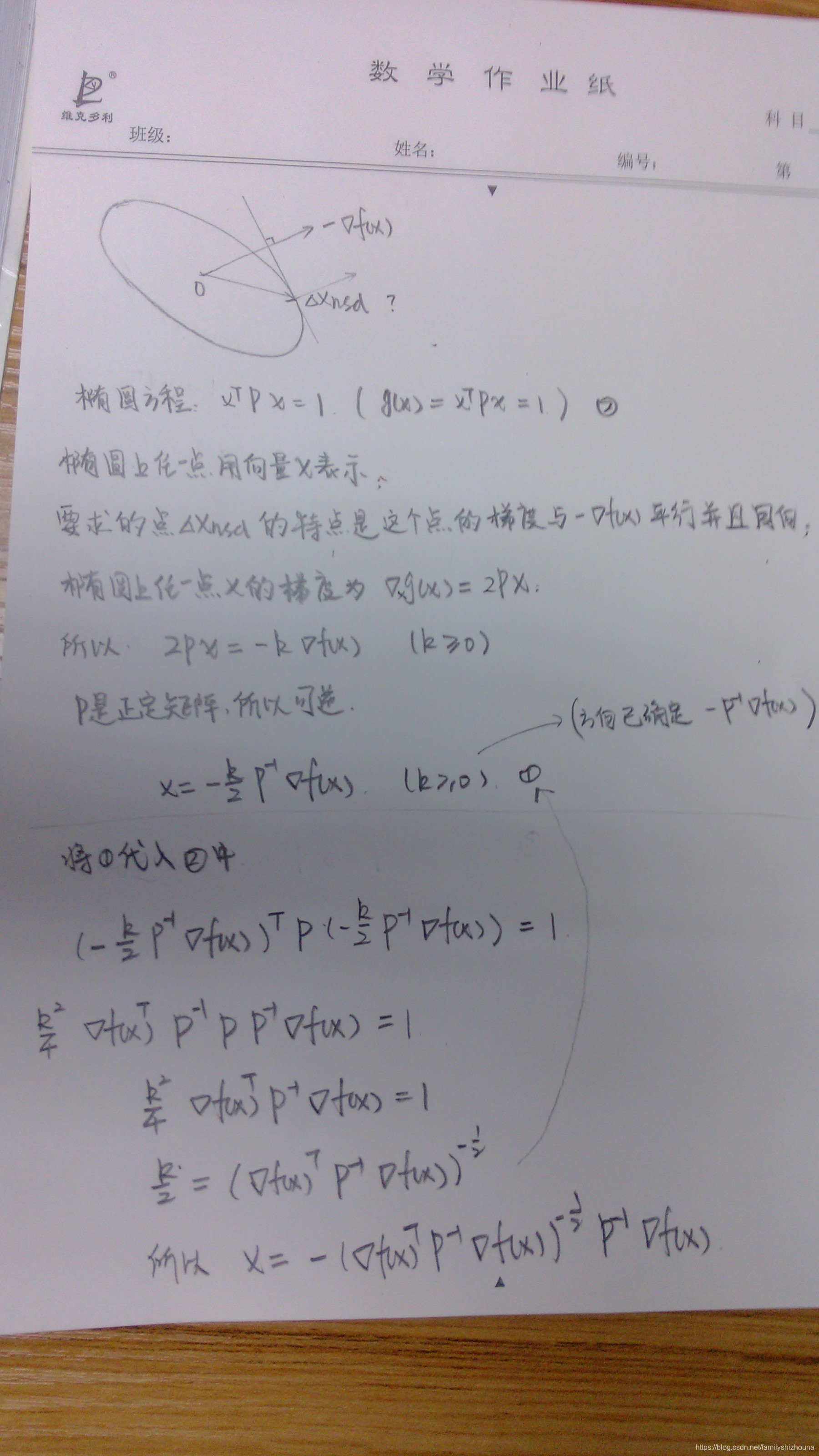

二次範數quadratic norm

方向就是Δxsd=−P−1▽f(x),下面的圖是具體怎麼求這個方向的過程。

l-1範數

Δxsd=−∂xi∂f(x)ei,方向是求偏導數的那個方向。

牛頓方法就是二次範數中P=▽2f(x),Hessian矩陣。當然也可以用泰勒二階展開式近似,然後求倒求展開式的最小值,也可得到相同的結果。停止準則為∣∣▽f(x)∣∣▽2f(x)≤η

相關推薦

steepest descent for Euclidean norm 最速下降法中二次範數的下降方向

在無約束優化中,設f(x)f(x)f(x)是凸函式。可以通過∂f(x)=0\partial f(x)=0∂f(x)=0求解,如果不能直接得到解析解,可以通過構造一個序列,x0,x1,...,xkx_0,x_1,...,x_kx0,x1,...,xk,使得f

梯度下降法中,為什麼在負梯度方向函式值下降最快

以下內容整理於高數課本以及李巨集毅老師的視訊: 我們想要利用梯度下降來求得損失函式的最小值。也就是每次我們更新引數,當前的損失函式總比上一次要小。 假設只有兩個引數θ1和θ2,上圖是損失函式的等值線,紅色點是初始值當前的狀態。以紅色點為圓心畫圓,在這個圓的範圍內,我們想要找到

MT【61】含參數二次函數最大最小值

tco pla 最大 back inline 我們 最小 但是 alt 評:此類題目在高考中作為壓軸題也曾考過,一般通性通法都如上面的做法,但是我們如果可以站在包絡的角度,很多問題將變得很清晰:MT【61】含參數二次函數最大最小值

MT【223】二次函數最大最小

http 最大 最小值 存在 its min bec 很多 解答 若函數$f(x)=ax^2+20x+14(a>0)$對任意實數$t$,在閉區間$[t-1,t+1]$上總存在兩實數$x_1,x_2$,使得$|f(x_1)-f(x_2)|\ge8$成立,則實數$a$的最

最優化學習筆記(三)最速下降法

tex track enter water pos 最優 content 分享 clas 最優化學習筆記(三)最速下降法

無約束演算法-最速下降,牛頓法,擬牛頓,共軛梯度求解二次函式極小值

import numpy as np import math a=np.random.randint(1,10,size=[100,1]) G=(a*a.T)+np.random.randint(1,5)*np.eye(100) b=np.dot(G,np.ones(

[最優化演算法]最速下降法求解無約束最優化問題

1. 問題描述 最優化問題的一般形式如下所示: 對於f:D⊆Rn→R1,求解 minx∈Ωf(x)s.t.{s(x)⩾0h(x)=0 其中f(x)稱為優化目標函式,s.t.稱為約束條件。對於無約束最優化,沒有約束條件要求,即在全部定義域內尋找目標函式最優

梯度下降法和最速下降法的細微差別

1. 前言: 細微之處,彰顯本質;不求甚解,難以理解。 一直以來,我都認為,梯度下降法就是最速下降法,反之亦然,老師是這麼叫的,百度百科上是這麼寫的,wiki百科也是這麼說的,這麼說,必然會導致大家認為,梯度的反方向就是下降最快的方向,然而最近在讀Steph

入門補充 最速梯度下降

名字很叼有木有? 實現了函式最小值的計算,具體說是高中數學知識,完成了求導和梯度下降,找出在某一範圍內的最小值,注意調節步長(賊坑) """ 最速下降法 Rosenbrock函式 函式 f(x)=100*(x(2)-x(1).^2).^2+(1-x(1)).^2 梯度 g(

使用非精確線搜尋Armijo演算法確定步長的最速下降法(MATLAB)

Armijo演算法實現: function mk = armijo( fun, xk, rho, sigma, gk ) assert( rho > 0 && rho < 1 ); assert( sigma > 0 &&

運籌學(1)-最速下降法

運籌學(1) 多維無約束優化演算法——梯度法之最速下降法 最近學習運籌學開始學習一些優化的演算法,之後的一系列部落格我會分享一些我學到的運籌學方法。這次我總結了我學習的最速下降法。 1. 原理 最速下降法是一個優化演算法,用於求解多維無約束問題。最速下降

最速下降法 and 共軛梯度法

註明:程式中呼叫的函式jintuifa.m golddiv.m我在之前的筆記中已貼出 最速下降法 %最速下降法求解f = 1/2*x1*x1+9/2*x2*x2的最小值,起始點為x0=[9 1] %演算法根據最優化方法(天津大學出版社)97頁演算法3.2.1編寫 %v1.0

批量梯度下降法(Batch Gradient Descent)

所有 margin 初始 ont 模型 log eight 梯度下降 img 批量梯度下降:在梯度下降的每一步中都用到了所有的訓練樣本。 思想:找能使代價函數減小最大的下降方向(梯度方向)。 ΔΘ = - α▽J α:學習速率 梯度下降的線性回歸

“最速曲線”蘊含的人生哲理

最短 人生 目標 快的 img log 同一時間 是你 自己 曾經,數學老師教過我們:兩點之間,直線最短 於是你給自己樹立了一個目標,筆直的想目標前行。 那你是否有想過?兩點之間,直線也不一定最短。 你從未想過,因為你總是在勇往直前中,撞的頭破血流。 其實你早就知道世界

(3)梯度下降法Gradient Descent

作用 http 方程 優化方法 radi 方法 分享 移動 最優解 梯度下降法 不是一個機器學習算法 是一種基於搜索的最優化方法 作用:最小化一個損失函數 梯度上升法:最大化一個效用函數 舉個栗子 直線方程:導數代表斜率 曲線方程:導數代表切線斜率 導數可以代表方

最速降線問題公式推導

關系 工作 第一個 int sub dash calc quad 證明 以前對物理特別感興趣的時候就專門研究過一段時間的變分法,記得當時閱讀了一本十分不錯的書籍,其作者名挺有趣的—老大中先生的《變分法基礎》(真的很不錯的一本講變分法的書,有興趣的同學可以去看

CF37E Trial for Chief(最短路)

mem aps ons stream can lose name oid 次數 題意 題意是給你一張 NMNMNM 的圖,每個點有黑色和白色,初始全為白色,每次可以把一個相同顏色的連續區域染色,求最少的染色次數;(n,m<=50) 題解 轉化為最短路。對於每一個點與它

UVa 753 - A Plug for UNIX(最大流)

printf ron 所有 ont flow new 使用 string can 鏈接: https://uva.onlinejudge.org/index.php?option=com_onlinejudge&Itemid=8&page=show_prob

2018.08.28 ali 梯度下降法實現最小二乘

4.3 div 數量 ask pre oss 找到 1.7 二維 - 要理解梯度下降和牛頓叠代法的區別 #include<stdio.h> // 1. 線性多維函數原型是 y = f(x1,x2,x3) = a * x1 + b * x2 + c * x

codeforces CF37E Trial for Chief BFS最短路

examples wing nta enter || entire ons number rmi \(\rightarrow\) 戳我進CF原題 E. Trial for Chief time limit per test: 2 seconds memory limit