基於深度學習的人臉識別綜述

本文轉載自

https://xraft.github.io/2018/03/21/FaceRecognition/

(作者:Caleb Ge (葛政)),如有侵權請告知刪除。

(下文中的“我”均為原文作者)

另附有查詢的其他參考連結:

論文介紹方面連結:

1、https://blog.csdn.net/fengbingchun/article/details/80904688

2、https://blog.csdn.net/chenriwei2/article/details/31415069

工程介紹方面連結:

1、https://blog.csdn.net/chenriwei2/article/details/49500687

2、https://github.com/RiweiChen/FaceTools

3、https://github.com/RiweiChen/DeepFace

4、https://github.com/liuxiao214/face_recognition

5、https://blog.csdn.net/qq_14845119/article/details/53308996

6、https://github.com/ydwen/caffe-face

前言

相信做機器學習或深度學習的同學們回家總會有這樣一個煩惱:親朋好友詢問你從事什麼工作的時候,如何通俗的解釋能避免尷尬?我嘗試過很多名詞來形容自己的工作:機器學習,深度學習,演算法工程師/研究員,搞計算機的,程式設計師…這些詞要麼自己覺得不滿意,要麼對方聽不懂。經歷無數次失敗溝通,最後總結了一個簡單實用的答案:“做人臉識別的”。為什麼這個答案管用,因為人臉識別在深度學習相關領域的課題中屬於商業落地情景多,被普及率廣的一項技術,以至於誰說不出幾個人臉識別應用,都有那麼點落後於時代的意思。今天出這篇人臉識別,是基於我過去三個月在人臉識別方向小小的探索,希望能為非技術從業者提供人臉識別的基本概念(第一部分),以及為人臉識別愛好者和入門人員提供儲備知識和實驗資料參考(第二、第三部分),也歡迎專業人士提供寶貴的交流意見。

本文將從接下來三個方面介紹人臉識別,讀者可根據自身需求選擇性閱讀:

- Chapter 1 人臉識別是什麼?怎麼識別?

- Chapter 2 科研領域近期進展Chapter 2 科研領域近期進展

- Chapter 3 實驗及細節Chapter 3 實驗及細節

1、第一章

1.1 人臉識別是什麼

人臉識別問題巨集觀上分為兩類:1.人臉驗證(又叫人臉比對)2.人臉識別

人臉驗證做的是1比1的比對,即判斷兩張圖片裡的人是否為同一人。最常見的應用場景便是人臉解鎖,終端裝置(如手機)只需將使用者事先註冊的照片與臨場採集的照片做對比,判斷是否為同一人,即可完成身份驗證。

人臉識別做的是1比N的比對,即判斷系統當前見到的人,為事先見過的眾多人中的哪一個。比如疑犯追蹤,小區門禁,會場簽到,以及新零售概念裡的客戶識別。這些應用場景的共同特點是:人臉識別系統都事先儲存了大量的不同人臉和身份資訊,系統執行時需要將見到的人臉與之前儲存的大量人臉做比對,找出匹配的人臉。

兩者在早期(2012年~2015年)是通過不同的演算法框架來實現的,想同時擁有人臉驗證和人臉識別系統,需要分開訓練兩個神經網路。而2015年Google的Facenet論文的發表改變了這一現狀,將兩者統一到一個框架裡。

1.2 人臉識別,怎麼識別

這部分只想闡明一個核心思想:不同人臉由不同特徵組成。

理解這個思想,首先需要引入的的是“特徵”的概念。先看下面這個例子:

| 特徵 | 0 | 1 |

| 特徵1.眼皮 | 單眼皮 | 雙眼皮 |

| 特徵2.鼻子 | 塌鼻樑 | 挺鼻樑 |

| 特徵3.眼球 | 藍色 | 灰色 |

| 特徵4.膚色 | 黃色 | 白色 |

| 特徵5.髮色 | 棕黃 | 黑色 |

假設這5個特徵足夠形容一張人臉,那每張人臉都可表示為這5個特徵的組合:

(特徵1,特徵2,特徵3,特徵4,特徵5)

一位雙眼皮,挺鼻樑,藍眼睛,白面板,瓜子臉的歐美系小鮮肉即可用特徵表示為(見表格加粗項):

(1,1,0,1,0)

那麼遍歷上面這張特徵表格一共可以代表 張不同的臉。32張臉可遠遠不夠覆蓋70多億的人口。為了讓不同特徵組成的人臉能覆蓋足夠多人臉,我們需要擴充上面那張特徵表。擴張特徵表可以從行、列兩個角度展開。

- 列的角度很簡單,只需要增加特徵數量:(特徵6.臉型,特徵7.兩眼之間距離,特徵8.嘴脣厚薄…)實際應用中通常應用128,256,512或者1024個不同特徵,這麼多特徵從哪來,該不會人為一個一個去設計吧?這個問題在後面會解答。

- 從行的角度擴充也很好理解,比如“特徵3”,除了值0代表藍色,值1代表灰色,是不是可以增加一個值2代表黑色,值3代表沒有頭髮呢?此外,除了這些離散的整數,我們也可以取連續的小數,比如特徵3的值0.1,代表“藍中略微帶黑”,值0.9代表“灰中帶藍”…

經過這樣的擴充,特徵空間便會變得無限大。擴充後特徵空間裡的一張臉可能表示為:

(0, 1, 0.3, 0.5, 0.1, 2, 2.3, 1.75,…)

之前提出的問題:用於表示人臉的大量特徵從哪來?這便是深度學習(深度神經網路)發揮作用的地方。它通過在千萬甚至億級別的人臉資料庫上學習訓練後,會自動總結出最適合於計算機理解和區分的人臉特徵。演算法工程師通常需要一定的視覺化手段才能知道機器到底學習到了哪些利於區分不同人的特徵,當然這部分不是本節重點。

闡明瞭不同人臉由不同特徵組成後,我們便有了足夠的知識來分析人臉識別,到底怎麼識別。

現在考慮最簡單最理想的情況,用於區分不同人的特徵只有兩個:特徵1和特徵2。那麼每一張臉都可以表示為一個座標(特徵1,特徵2),即特徵空間(這個例子裡是二維空間)內的一個點。人臉識別基於一個預設成立的假設:同一個人在不同照片裡的臉,在特徵空間裡非常接近。為什麼這個假設預設成立,設想一下,一個棕色頭髮的人,在不同光照,遮擋,角度條件下,髮色看起來雖然有輕微的區別,但依然與真實顏色非常接近,反應在髮色的特徵值上,可能是0到0.1之間的浮動。深度學習的另一任務和挑戰便是在各種極端複雜的環境條件下,精確的識別各個特徵。

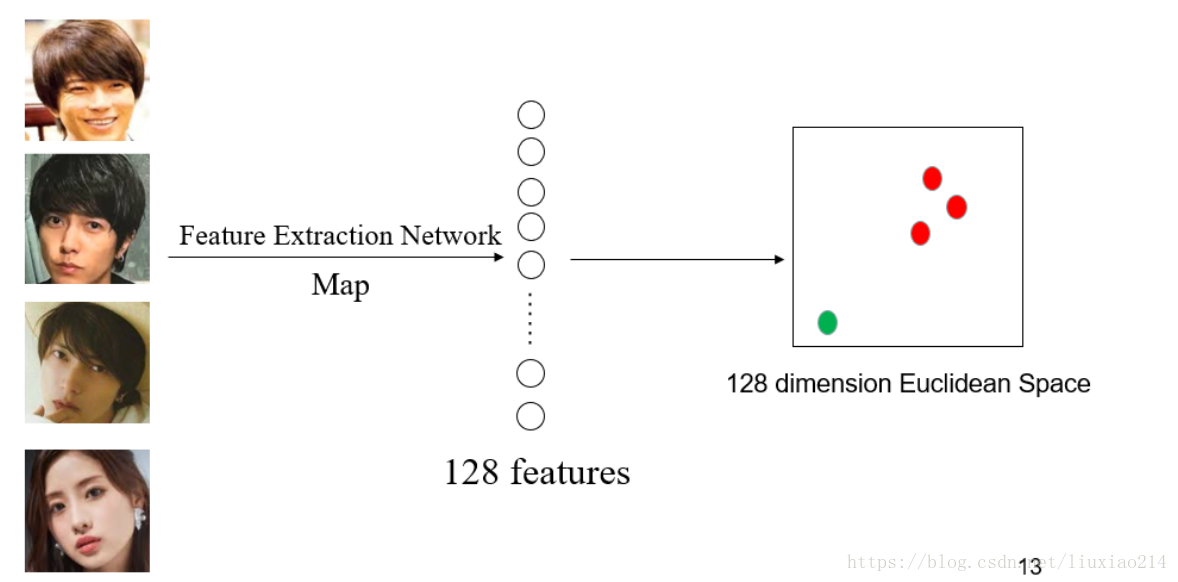

上圖是在熊本做大規模人臉資料集去噪演講時用的ppt,三張山下智久的照片經過神經網路提取出128維的特徵後,變成了3個在128維空間中的點(紅色),石原里美的特徵點為綠色,這張ppt想表達同樣的意思:同一人的不通照片提取出的特徵,在特徵空間裡距離很近,不同人的臉在特徵空間裡相距較遠。

再來考慮人臉識別領域的兩個問題:

- 人臉驗證

- 人臉識別

1.2.1 人臉驗證

比如FaceID人臉解鎖,Iphone事先存了一張使用者的照片(需要使用者註冊),這張照片變成了轉換成了一連串特徵數值(即特徵空間裡的一個點),使用者解鎖時,手機只需要對比當前採集到的臉和事先註冊的臉在特徵空間裡的幾何距離,如果距離足夠近,則判斷為同一人,如果距離不夠近,則解鎖失敗。距離閾值的設定,則是演算法工程師通過大量實驗得到的。

1.2.2 人臉識別

同樣考慮一個場景,人臉考勤。公司X有員工A,B,C,公司會要求三名員工在入職的時候各提供一張個人照片用於註冊在公司系統裡,靜靜地躺在特徵空間中。第二天早上員工A上班打卡時,將臉對準考勤機器,系統會把當前員工A的臉放到特徵空間裡,與之前特徵空間裡註冊好的臉一一對比,發現註冊的臉中距離當前採集到的臉最近的特徵臉是員工A,打卡完畢。

知道了人臉識別的基本原理,便能看清它的技術侷限。下圖展示了一些容易識別失敗的案例:

在光照較差,遮擋,形變(大笑),側臉等諸多條件下,神經網路很難提取出與“標準臉”相似的特徵,異常臉在特徵空間裡落到錯誤的位置,導致識別和驗證失敗。這是現代人臉識別系統的侷限,一定程度上也是深度學習(深度神經網路)的侷限。面對這種侷限,通常採取三種應對措施,使人臉識別系統能正常運作:

- 工程角度:研發質量模型,對檢測到人臉質量進行評價,質量較差則不識別/檢驗。

- 應用角度:施加場景限制,比如刷臉解鎖,人臉閘機,會場簽到時,都要求使用者在良好的光照條件下正對攝像頭,以避免採集到質量差的圖片。

- 演算法角度:提升人臉識別模型效能,在訓練資料裡新增更多複雜場景和質量的照片,以增強模型的抗干擾能力。

總而言之,人臉識別/深度學習還遠未達到人們想象的那般智慧。希望各位讀者看完第一節後,有能力分辨社交網路,自媒體上的資訊真偽,更理性的看待人工智慧,給它時間和包容,慢慢成長。

Preview:

下一節將通過論文和開源演算法跟進人臉識別領域的前沿研究。僅適合深度學習從業人員繼續閱讀。

2、第二章

這部分將從兩個思路跟進現代人臉識別演算法:

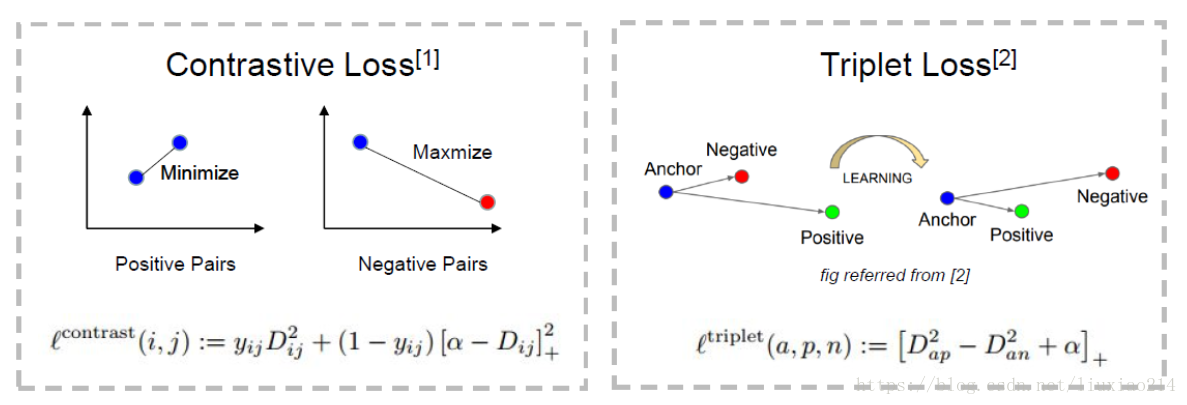

- 思路1. Metric Learning: Contrastive Loss, Triplet loss及相關sampling method。

- 思路2. Margin Based Classification: 包含Softmax with Center loss, Sphereface, NormFace, AM-softmax(CosFace)和ArcFace.

關鍵字:

DeepID2, Facenet, Center loss, Triplet loss, Contrastive Loss, Sampling method, Sphereface, Additive Margin Softmax(CosFace), ArcFace.

2.1 Metric Learning

2.1.1 Contrastive Loss

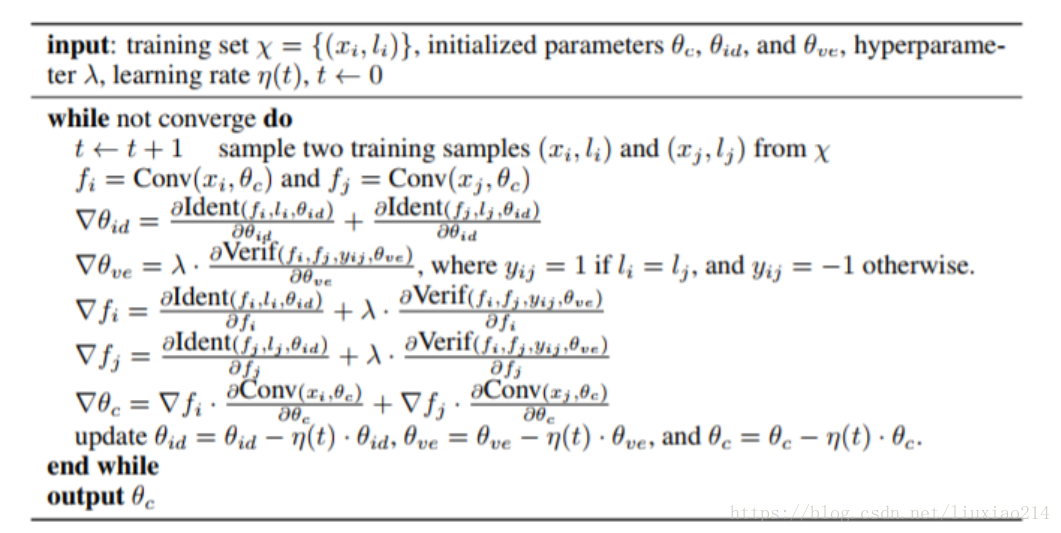

基於深度學習的人臉識別領域最先應用metric learning思想之一的便是DeepID2[2]了,同Chapter 1的思想,“特徵”在這篇文章中被稱為“DeepID Vector”。DeepID2在同一個網路同時訓練verification和classification(即有兩個監督訊號)。其中verification loss便在特徵層引入了Contrastive Loss。Contrastive Loss本質上是使同一個人的照片在特徵空間距離足夠近,不同人在特徵空間裡相距足夠遠直到超過某個閾值m(聽起來和triplet loss很像…)。基於這樣的insight,DeepID2在訓練的時候不是以一張圖片為單位了,而是以Image pair為單位,每次輸入兩張圖片,為同一人則verification label為1,不是同一人則label為-1,引數更新思路見下面公式(截自DeepID2論文):

DeepID2在14年是人臉領域非常有影響力的工作,也掀起了在人臉領域引進Metric Learning的浪潮。

2.1.2 Triplet Loss from Facenet

這篇15年來自Google的Facenet同樣是人臉識別領域的分水嶺性工作。不僅僅因為他們成功應用了Triplet loss在benchmark上取得state-of-art的結果,更因為他們提出了一個絕大部分人臉問題的統一解決框架,即:識別、驗證、搜尋等問題都可以放到特徵空間裡做,需要專注解決的僅僅是如何將人臉更好的對映到特徵空間。為此,Google在DeepID2的基礎上,拋棄了分類層即Classification Loss,將Contrastive Loss改進為Triplet Loss,只為了一個目的:學到更好的feature。

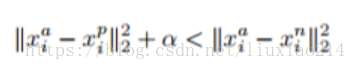

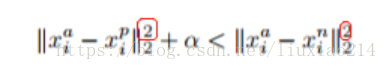

Triplet loss的思想也很簡單,輸入不再是Image Pair,而是三張圖片(Triplet),分別為Anchor face, negative face和positive face。Anchor與positive face為同一人,與negative face為不同人。那麼Triplet loss的損失即可表示為:

直觀解釋為:在特徵空間裡anchor與positive的距離要小於anchor與negative的距離超過一個margin alpha。有了良好的人臉特徵空間,人臉問題便轉換成了Chapter 1末尾形容的那樣簡單直觀。附上一張我製作的Contrastive Loss和Triplet Loss的ppt:

2.1.3 Metric Learning的問題

基於Contrastive loss和Triplet loss的Metric Learning符合人的認知規律,在實際應用中也取得了不錯的效果,但是它有非常致命的兩個問題,使應用它們的時候猶如pain in ass.

- 模型需要很很很很很很很很很很很很很很長時間才能擬合(months mentioned in Facenet paper),contrastive loss和triplet loss的訓練樣本都基於pair或者triplet的,可能的樣本數是O(N2)或者O(N3)的,當訓練集很大時,基本不可能遍歷到所有可能的樣本(或能提供足夠梯度額的樣本),所以一般來說需要很長時間擬合。我在10000人,500,000張左右的亞洲資料集上花了近一個月才擬合。

- 模型好壞很依賴訓練資料的sample方式,理想的sample方式不僅能提升演算法最後的效能,更能略微加快訓練速度。

關於這兩個問題也有很多學者進行了後續研究,下面的內容作為Metric Learning的延伸閱讀,不會很詳細。

2.1.4 Metric Learning延伸閱讀

Deep Face Recognition[3]

為了加速triplet loss的訓練,這篇文章先用傳統的softmax訓練人臉識別模型,因為classficiation訊號的強監督特性,模型會很快擬合(通常小於2天,快的話幾個小時)。之後移除頂層的classificiation layer,用triplet loss對模型進行特徵層finetune,取得了不錯的效果。此外這篇論文還發布了人臉資料集Vggface。

In Defense of the Triplet Loss for Person Re-Identification[4]

這篇文章提出了三個非常有意思的觀點。

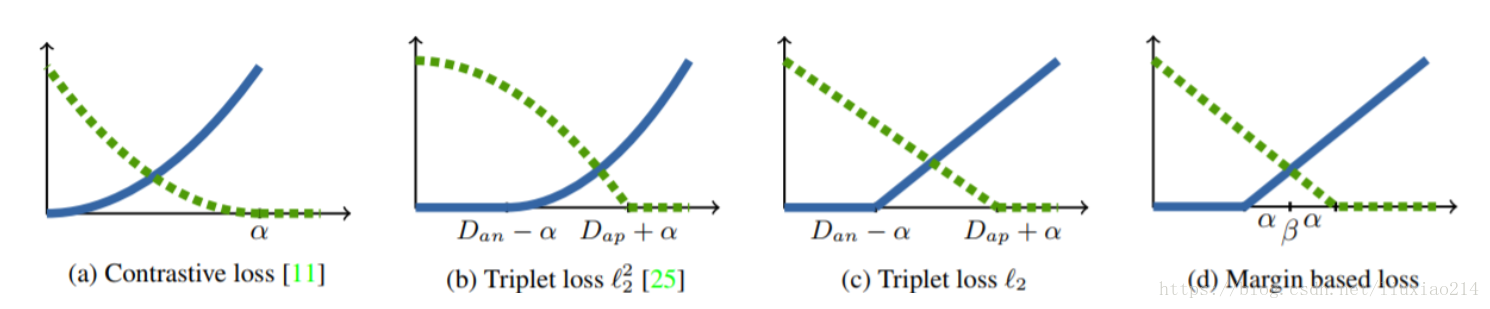

- 作者說實驗中,平方後的歐幾里得距離(Squared Euclidean Distance)表現不如開方後的真實歐幾里得距離(Non-squared Euclidean Distance),直白的說就是把下圖公式中的平方摘掉。

- 提出了soft-margin損失公式替代原始的triplet loss表示式。(3)引進了batch hard sampling。

- 引進了batch hard sampling。

Sampling Matters in Deep Embedding Learning[5]

這篇文章提出了兩個有價值的點。(1)從導函式角度解釋了為什麼第2點中提到的non-suqared distance比squared-distance好,並在這個insight基礎上提出了Margin Based Loss(本質還是triplet loss的variant,見下圖,圖片取自原文)。 (2)提出了distance weighted sampling。文章說Facenet中的semi-hard sampling,Deep Face Recognition[3]中的random hard和[4]中提到的batch hard都不能輕易取到會產生大梯度(大loss,即對模型訓練有幫助的triplets),然後從統計學的視角使用了distance weighted sampling method。

我的實驗感想

- 2,3點中提到的方式在試驗中都應用過,直觀感受是:soft-margin和margin based loss都比原始的triplet loss好用,但是mairgin based loss實驗中更優越。

- distance weighted sampling method沒有明顯提升。

延伸閱讀中有提到大家感興趣的論文,可參考reference檢視原文。最後,值得注意的是,triplet loss在行人重識別領域也取得了不錯的效果,雖然很可能未來會被Margin Based Classfication打敗。

2.2 Margin Based Classification

顧名思義,Margin Based Classficiation不像在feature層直接計算損失的Metric Learning那樣,對feature加直觀的強限制,而是依然把人臉識別當classfication任務進行訓練,通過對softmax公式的改造,間接實現了對feature層施加margin的限制,使網路最後得到的feature更discriminative。這部分先從Sphereface[6]說起。

2.2.1 Sphereface

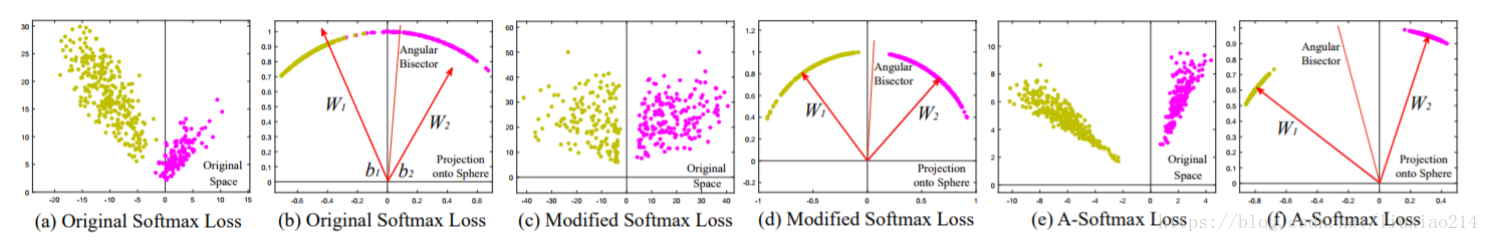

先跟隨作者的insight理下思路(圖截自原文):

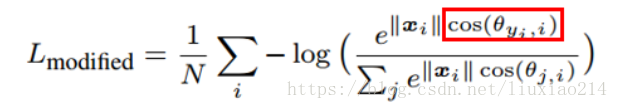

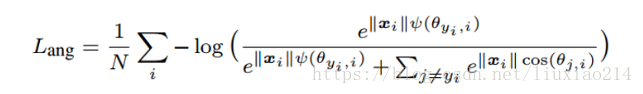

圖(a)是用原始softmax損失函式訓練出來的特徵,圖(b)是歸一化的特徵。不難發現在softmax的特徵從角度上來看有latent分佈。那麼為何不直接去優化角度呢?如果把分類層的權重歸一化,並且不考慮偏置的話,就得到了改進後的損失函式:

不難看出,對於特徵x_i,該損失函式優化的方向是使得其向該類別y_i中心靠近,並且遠離其他的類別中心。這個目標跟人臉識別目標是一致的,最小化類內距離並且最大化類間距離。然而為了保證人臉比對的正確性,還要保證最大類內距離還要小於最小類間距離。上面的損失函式並不能保證這一點。所以作者引入了margin的思想,這跟triples loss裡面引入margin alpha的思想是一致的。那麼作者是如何進一步改進上式,引入margin的呢?

上式紅框中是樣本特徵與類中心的餘弦值,我們的目標是縮小樣本特徵與類中心的角度,即增大這個值。換句話說,如果這個值越小,損失函式值越大,即我們對偏離優化目標的懲罰越大。即就能進一步的縮小類內距離和增大類間距離,達到我們的目標。基於這樣的思想最終的損失函式為如下:

原始的cos(θ)被換成了phi(θ),phi(θ)的最簡單形式其實是cos(mθ),之所以在原文中變得複雜,只是為了將定義域擴充套件到[0,2π]上,並保證在定義域內單調遞減。而這個m便是增加的margin係數。當m=1時,phi(θ)等於cos(θ),當m>1時,phi變小,損失變大。超參m控制著懲罰力度,m越大,懲罰力度越大。為計算方便,m一般設為整數。作者從數學上證明了,m>=3就能保證最大類內距離小於最小類間距離。實現的時候使用倍角公式。

另外:sphereface的訓練很tricky,關於其訓練細節,這篇文章並沒有提到,而是參考了作者前一篇文章[10]。有關訓練細節讀者也去作者github上去尋找,issues裡面有很多討論。

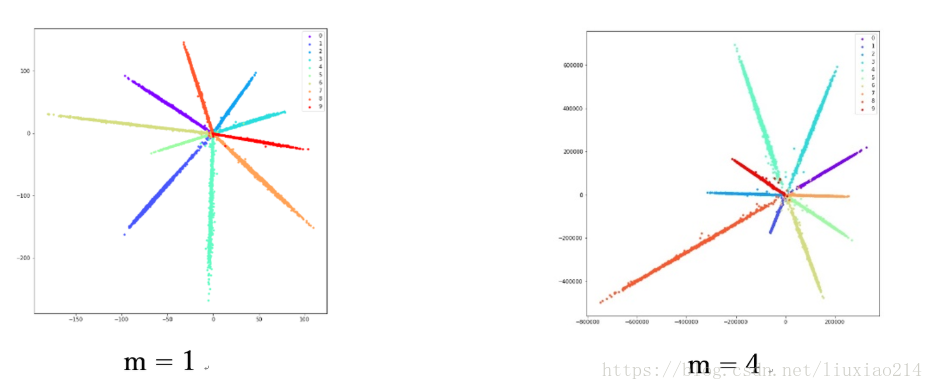

2.2.2 Normface

Sphereface效果很好,但是它不優美。在測試階段,sphereface通過特徵間的餘弦值來衡量相似性,即以角度為相似性的度量。但在訓練階段,不知道讀者有沒有注意到,其實sphereface的損失函式並不是在直接優化特徵與類中心的角度,而是優化特徵與類中心的角度在乘上一個特徵的長度。就是說,我在上文中關於sphereface損失函式優化方向的表述是不嚴謹的,其實優化的方向還有一部分是去增大特徵的長度去了。我在Mnist資料集上做過實驗,以下圖片分別為m=1和m=4時的特徵視覺化,注意座標的尺度,就能驗證上述觀點.

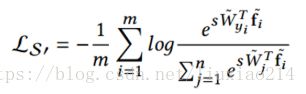

然而特徵的長度在我們使用模型的時候是沒有幫助的。這就造成了training跟test之間目標不一致,按照Normface作者原話說就是存在一個gap。於是Normface的核心思想就出來了:為何在訓練的時候不把特徵也做歸一化處理?相應的損失函式如下:

其中W是歸一化的權重,f_i是歸一化的特徵,兩個點積就是角度餘弦值。引數s的引入是因為數學上的性質,保證了梯度大小的合理性,原文中有比較直觀的解釋,這裡不是重點。如果沒有s訓練將無法收斂。關於s的設定,可以把它設為可學習的引數。但是作者更推薦把它當做超引數,其值根據分類類別多少有相應的推薦值,這部分原文appendix裡有公式。文章中還有指出一點,Facenet中歸一化特徵的歐式距離,和餘弦距離其實是統一的。還有關於權重與特徵的歸一化,這篇文章有很多有意思的探討,有興趣的讀者建議閱讀原文。

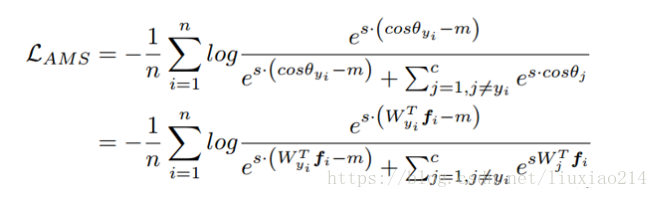

2.2.3 AM-softmax[11]/CosFace[12]

這兩篇文章是同一個東西。

Normface用特徵歸一化解決了sphereface訓練和測試不一致的問題。但是卻沒有了margin的意味。AM-softmax可以說是在Normface的基礎上引入了margin。直接上損失函式:

其中這裡的權重和特徵都是歸一化的。

直觀上來看,cos(θ)-m比cos(θ)更小,所以損失函式值比Normface裡的更大,因此有了margin的感覺。m是一個超引數,控制懲罰的力度,m越大,懲罰越強。作者推薦m=0.35。這裡引入margin的方式比Sphereface中的‘溫柔’,不僅容易復現,沒有很多調參的tricks,效果也很好。

2.2.4 ArcFace[13]

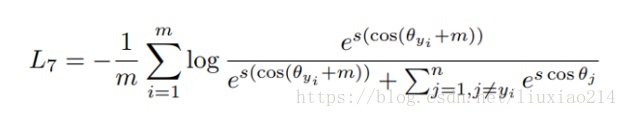

與AM-softmax相比,區別在於Arcface引入margin的方式不同,損失函式:

乍一看是不是和AM-softmax一樣?注意m是在餘弦裡面。文章指出基於上式優化得到的特徵間的boundary更為優越,具有更強的幾何解釋。

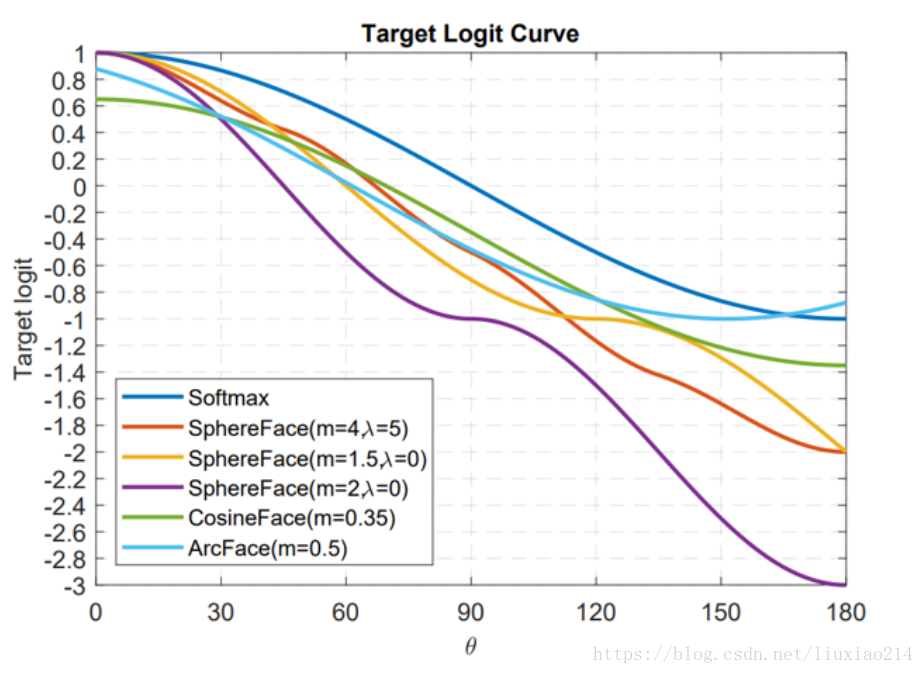

然而這樣引入margin是否會有問題?仔細想cos(θ+m)是否一定比cos(θ)小?最後我們用文章中的圖來解釋這個問題,並且也由此做一個本章margin-based classification部分的總結。

2.2.5 小結

這幅圖出自於Arcface,橫座標為θ為特徵與類中心的角度,縱座標為損失函式分子指數部分的值(不考慮s),其值越小損失函式越大。

看了這麼多基於分類的人臉識別論文,相信你也有種感覺,大家似乎都在損失函式上做文章,或者更具體一點,大家都是在討論如何設計上圖的Target logit-θ曲線。這個曲線意味著你要如何優化偏離目標的樣本,或者說,根據偏離目標的程度,要給予多大的懲罰。兩點總結:

- 太強的約束不容易泛化。例如Sphereface的損失函式在m=3或4的時候能滿足類內最大距離小於類間最小距離的要求。此時損失函式值很大,即target logits很小。但並不意味著能泛化到訓練集以外的樣本。施加太強的約束反而會降低模型效能,且訓練不易收斂。

- 選擇優化什麼樣的樣本很重要。Arcface文章中指出,給予θ∈[60° , 90°]的樣本過多懲罰可能會導致訓練不收斂。優化θ ∈ [30° , 60°]的樣本可能會提高模型準確率,而過分優化θ∈[0° , 30°]的樣本則不會帶來明顯提升。至於更大角度的樣本,偏離目標太遠,強行優化很有可能會降低模型效能。這也回答了上一節留下的疑問,上圖曲線Arcface後面是上升的,這無關緊要甚至還有好處。因為優化大角度的hard sample可能沒有好處。這和FaceNet中對於樣本選擇的semi-hard策略是一個道理。

2.2.6 Margin based classification延伸閱讀

1.A discriminative feature learning approach for deep face recognition[14],提出了center loss,加權整合進原始的softmax loss。通過維護一個歐式空間類中心,縮小類內距離,增強特徵的discriminative power。

2.Large-margin softmax loss for convolutional neural networks[10],Sphereface作者的前一篇文章,未歸一化權重,在softmax loss中引入了margin。裡面也涉及到Sphereface的訓練細節。

3、第三章

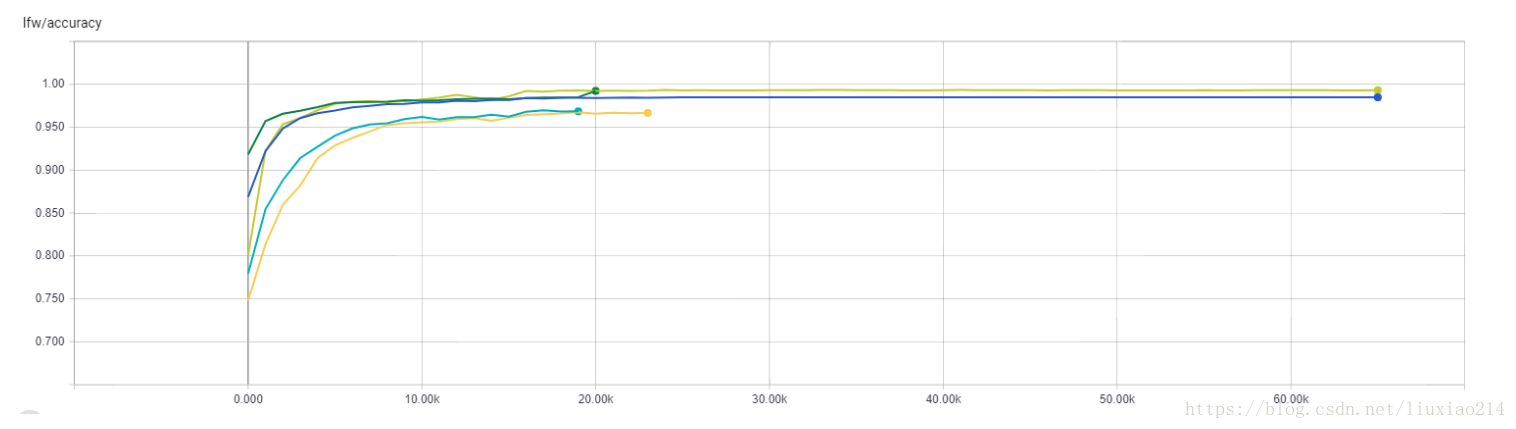

基於前兩章的知識,我在lfw上取得了99.47%的結果,這個結果訓練在Vggface2上,未與lfw去重,也沒經歷很痛苦的調參過程,算是AM-softmax損失函式直接帶來的收益吧!過程中踩了很多坑,這一章將把前段時間的實驗結果和心得做一個整理,此外也將回答絕大部分工程師在做人臉識別時最關心的一些問題。やりましょう!

專案github地址:https://github.com/Joker316701882/Additive-Margin-Softmax

包含程式碼可以復現所有實驗結果

一個標準的人臉識別系統包含這幾個環節:

人臉檢測及特徵點檢測->人臉對齊->人臉識別

3.1 人臉檢測及landmark檢測

目前最流行的人臉及landmark檢測是MTCNN[7],但是MTCNN一方面偶爾檢測不到face,一方面landmark檢測不夠精準。這兩點都會給後續的對齊和識別帶來不利影響。另外在coco loss[8]論文裡提到:好的檢測和對齊方法,僅用softmax就能達到99.75%,秒殺目前大多數最新論文的結果。coco loss的github issue裡提到了更多細節:https://github.com/sciencefans/coco_loss/issues/9 。此外,因為alignment演算法效能的區別,2017年及以後的論文更加註重相對實驗結果的比較,以排除alignment演算法引入的優劣勢,方便更直觀比較各家的人臉識別演算法,lfw上輕鬆能達到99%以上也是現在更傾向於採用相對結果的原因。

3.2 人臉對齊

人臉對齊做的是將檢測到的臉和landmark通過幾何變換,將5官變換到圖中相對固定的位置,提供較強的先驗。廣泛使用的對齊方法為similarity transformation。更多對其變換方法和實驗可以參考這篇知乎:https://zhuanlan.zhihu.com/p/29515986 。我在試驗中應用的對齊細節可以參考程式碼實現:https://github.com/Joker316701882/Additive-Margin-Softmax/blob/master/align/align_lfw.py 。值得探討的一個問題是:人臉檢測和對齊真的有必要嗎?現實應用中常出現人臉landmark無法檢測的情況,沒有landmark就無法使用similarity transoformation。針對這個問題也有相關研究,通過使用Spatial Transform Network[9]“讓網路自己學習alignment”,論文參考 End-to-End Spatial Transform Face Detection and Recognition。這方面的研究進展還不充分,所以實際系統中多數情況下還是使用了detection->alignment這套流程。

3.3 人臉識別

可以說人臉識別的專案中絕大部分問題都是人臉檢測和對齊的問題。識別模型之間的差距倒沒有那麼明顯。不過訓練AM-softmax過程中依然碰到了些值得注意的問題。Spheraface裡提出的Resface20(AM-softmax中也同樣使用,一模一樣復現情況下,lfw上只能達到94%。tensorflow中能擬合的情況為如下配置:

Adam, no weight decay, use batch normalization.

對應原文配置:

Momentum, weight decay, no batch normalization.

以及在實驗中發現的:

除了Adam以外的任何一個optimizer都達不到理想效果,這可能是不同框架底層實現有所區別的原因,Sphereface,、AM-softmax都是基於caffe,本文所有實驗全使用tensorflow,結論有區別也算正常。

另一點,sandberg Facenet中的resnet-inception-v1搬過來套用AM-softmax在lfw上的結果達不到97%,這是過程中不太理解的點。從其他論文裡看,如果loss選的沒問題,那諸如resnet-inception,不同深度的resnet,甚至Mobile-net, Squeezenet等結構的表現也不該有明顯差距(AM-softmax的情況下至少也該達到99%)。此外,直接套用Arcface也無法擬合,需要進一步實驗。

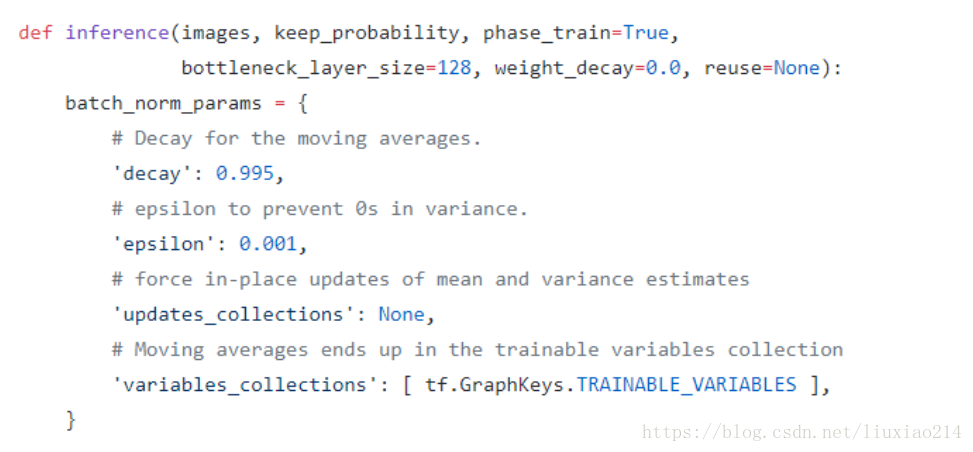

最後,關於Sandberg的code中一個值得關注的點,他將train_op定義在了facenet.train()函式裡,仔細閱讀這個函式會發現,Sandberg的程式碼中所有網路引數並不是採用每次更新梯度後的值,而是採用滑動平均值作為網路實際的引數值!也正是因為這個原因,解釋了sandberg在batch_norm的引數configuration中(見下圖,擷取自https://github.com/davidsandberg/facenet/blob/master/src/models/inception_resnet_v1.py ),甚至沒把”is_training”的值交給placeholder,而是預設train和test時都採用local statistics的模式。如果不是因為所有引數都用了滑動平均,那麼這種使用batch_norm的做法其實是錯誤的。Sandberg這樣實現的好壞只能交給實驗結果來評判了。如果想正常使用網路引數,和batch norm,而不是用滑動平均引數和全程開著”is_training”,只需要將facenet.train()函式替換成普通的Optimizer,然後將batch_norm的”is_training”交給placeholder處理,詳細可以參考我的AM-softmax實現。

感謝大家堅持閱讀到最後,以tensorboard的plot作為結尾吧!

Reference

[1] F. Schroff, D. Kalenichenko, and J. Philbin. Facenet: A unified embedding for face recognition and clustering. In Proc. CVPR, 2015.

[2] Y. Sun, X. Wang, and X. Tang. Deep learning face representation by joint identification-verification. CoRR, abs/1406.4773, 2014.

[3] O. M. Parkhi, A. Vedaldi, and A. Zisserman. Deep face recognition. In BMVC, 2015

[4] A. Hermans, L. Beyer, and B. Leibe. In defense of the triplet loss for person re-identification. arXiv preprint arXiv:1703.07737, 2017

[5] Wu, C. Manmatha, R. Smola, A. J. and Krahenb uhl, P. 2017. Sampling matters in deep embedding learning. arXiv preprint arXiv:1706.07567

[6] W. Liu, Y. Wen, Z. Yu, M. Li, B. Raj, and L. Song. Sphereface: Deep hypersphere embedding for face recognition. In Proceedings of the IEEE conference on computer vision and pattern recognition, 2017

[7] Zhang, K., Zhang, Z., Li, Z., Qiao, Y.: Joint face detection and alignment using multi-task cascaded convolutional networks. arXiv preprint, 2016

[8] Yu Liu, Hongyang Li, and Xiaogang Wang. 2017. Learning Deep Features via Congenerous Cosine Loss for Person Recognition. arXiv preprint arXiv:1702.06890, 2017

[9] M. Jaderberg, K. Simonyan, A. Zisserman, and K. Kavukcuoglu. Spatial transformer networks. In NIPS, 2015.

[10] W. Liu, Y. Wen, Z. Yu, and M. Yang. Large-margin softmax loss for convolutional neural networks. In ICML, 2016.

[11] F. Wang, W. Liu, H. Liu, and J. Cheng. Additive margin softmax for face verification. In arXiv:1801.05599, 2018.

[12] CosFace: Large Margin Cosine Loss for Deep Face Recognition

[13] Deng, J., Guo, J., Zafeiriou, S.: Arcface: Additive angular margin loss for deep face recognition. In: Arxiv preprint. 2018

[14] Y. Wen, K. Zhang, Z. Li, and Y. Qiao. A discriminative feature learning approach for deep face recognition. In ECCV, 2016.

[15] Y. Liu, H. Li, and X. Wang. Rethinking feature discrimination and polymerization for large-scale recognition. arXiv:1710.00870, 2017.