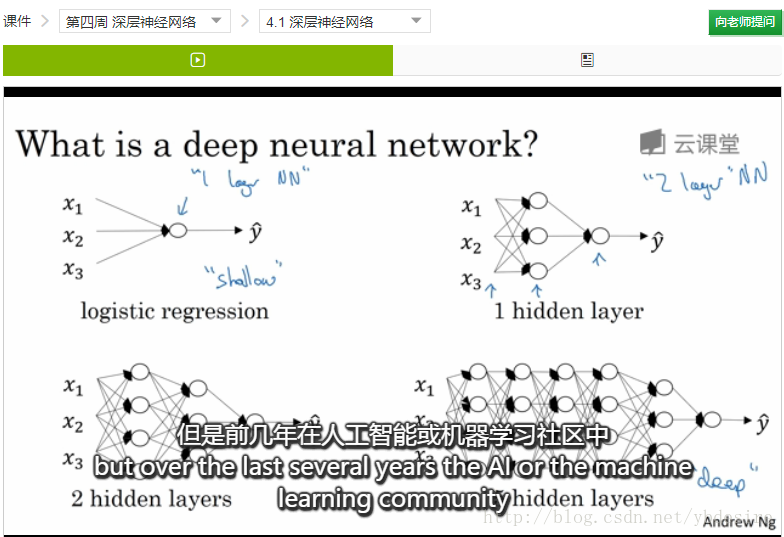

深層神經網路與淺層神經網路的區別

熟悉神經網路的可能知道,Hornik在1989年,就證明了一個定理:

- 只需一個包含足夠多神經元的隱層,多層前饋神經網路就能以任意精度逼近任意複雜的連續函式

那大家可能就會有疑問:既然一個隱層就夠了,我們為什麼還需要多層神經網路呢?

我們可以從這個定理中找到可能思考方式:

- (1)足夠多神經元,你在實踐中能保證麼?

- (2)如果你要擬合的模型並不是連續函式,單個隱層夠嗎?

顯然,這兩個問題的回答都是否定的。

如果覺得我這個解釋過於粗糙,可以看Andrew Ng在新課程”Deep Learning”中的解釋。

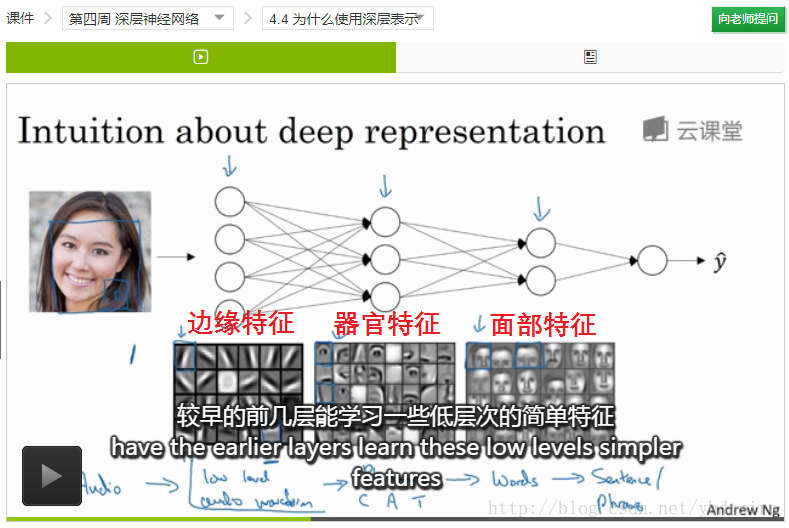

下面這個圖,我們也能看到:

- 第一層,提取低層次的簡單特徵(邊緣特徵)

- 第二層,將簡單特徵組合成複雜一點的特徵(器官)

- 第三層,將第二層的特徵組合起來

Andrew Ng還提到,神經科學家們覺得,人的打到也是先探測簡單的東西,然後組合起來才能看到整體。

相關推薦

深層神經網路與淺層神經網路的區別

熟悉神經網路的可能知道,Hornik在1989年,就證明了一個定理: 只需一個包含足夠多神經元的隱層,多層前饋神經網路就能以任意精度逼近任意複雜的連續函式 那大家可能就會有疑問:既然一個隱層就夠了,我們為什麼還需要多層神經網路呢? 我們可以從這個定理中

吳恩達.深度學習系列-C1神經網路與深度學習-W3淺層神經網路

詞彙 justification n. 理由;辯護;認為有理,認為正當;釋罪 prime n.角分號(g’(z)) shallow 淺層 學習目標 Understand hidden units and hidden layers

深度學習筆記(四)——神經網路和深度學習(淺層神經網路)

1.神經網路概覽 神經網路的結構與邏輯迴歸類似,只是神經網路的層數比邏輯迴歸多一層,多出來的中間那層稱為隱藏層或中間層。從計算上來說,神經網路的正向傳播和反向傳播過程只是比邏輯迴歸多了一次重複的計算。正向傳播過程分成兩層,第一層是輸入層到隱藏層,用上標[1]來表示;第二層是隱藏層到輸出層,用上標

淺層神經網路

1、神經網路概述: dW[L]=(1/m)*dZ[L]A[L-1].T db[L]=(1/m)*np.sum(dZ[L],axis=1,keepdims=True) dZ[L-1]=W[L].T dZ[L]*g'(Z[L-1]) 2. 啟用函式: &nbs

吳恩達深度學習筆記(15-21)總結-淺層神經網路總結

恩達老師的這一週的淺層神經網路總結,還是簡單的架構說明,但是還是要仔細讀哦! 架構分為四部分: 神經網路表示 計算神經網路輸出 啟用函式 神經網路的梯度下降 第一和第二部分: 神經網路表示和計算神經網路輸出部分,由於本部分講的是淺層的網路輸出,所以就是隻有一個隱藏層的神經網路,你也

吳恩達 deep learning 第三週 淺層神經網路

文章目錄 神經網路概覽 神經網路的表示 計算神經網路的輸出 多個例子中的向量化 啟用函式 為什麼需要非線性啟用函式 啟用函式的導數 神經網路的梯度下降

Tensorflow MNIST淺層神經網路的解釋和答覆

看到之前的一篇博文:深入MNIST code測試,接連有讀者發問,關於其中的一些細節問題,這裡進行簡單的答覆。 Tensorflow中提供的示例中MNIST網路結構比較簡單,屬於淺層的神經網路,只有兩個卷積層和全連線層,我按照Caffe的網路結構繪製一

吳恩達Coursera深度學習課程 DeepLearning.ai 提煉筆記(1-3)-- 淺層神經網路

以下為在Coursera上吳恩達老師的DeepLearning.ai課程專案中,第一部分《神經網路和深度學習》第三週課程“淺層神經網路”部分關鍵點的筆記。筆記並不包含全部小視訊課程的記錄,如需學習筆記中捨棄的內容請至Coursera 或者 網易雲課堂

Deep learning-全連線層神經網路與卷積神經網路

全連線層神經網路與卷積神經網路 全連線層神經網路相比於卷積神經網路存在的問題:因為全連線,所以當相互連線的節點個數增加時,節點之間的邊個數會很多,而一條邊對應著一個引數,所以全連線層在神經網路節點個數多的時候會存在引數很多的情況。而對於神經網路引數過多帶來的影響有在計算上的,也有在模型的擬合程度

吳恩達深度學習筆記3-Course1-Week3【淺層神經網路】

淺層神經網路: 一、淺層神經網路的表示 本文中的淺層神經網路指的是 two layer nn 即 one input layer + one hidden layer + one output layer。通常計算神經網路的層數不包括 input l

python實現淺層神經網路預測貓狗

吳恩達深度學習第三週程式設計題匯入模組# Package imports import numpy as np import matplotlib.pyplot as plt from testCases_v2 import * import sklearn import s

吳恩達神經網路與深度學習——神經網路基礎習題1

python numpy 基礎 1.使用iPython Notebooks 2.使用numpy 函式 and numpy矩陣或向量操作 3.理解"broadcasting" 4.向量化程式碼 用numpy建立一個基礎函式 sigmoid 函式 math庫

吳恩達神經網路與深度學習——神經網路基礎習題2

神經網路思維的邏輯迴歸 1.初始化引數 2.計算代價函式及其導數 3.使用梯度下降 判斷影象上是否有貓 影象預處理 問題敘述 你得到了一個數據集(“data.h5”),包含: -標記為cat ( y = 1 )或非cat ( y = 0 )的m個訓練集 -標

深度學習筆記—什麼是神經網路與TensorFlow實現神經網路?

學習目錄: (python自然語言處理實戰-核心技術與演算法書籍《塗銘 劉詳 劉樹春》)—推薦 (吳恩達-深度學習)[http://mooc.study.163.com/smartSpec/detail/1001319001.htm]—推薦 (莫煩系列-深度學習與機

在tensorflow下構建二層神經網路和三層神經網路解決10分類任務對比

繼剛才的邏輯迴歸解決的十分類任務意猶未盡,分別設計了二層和三層的神經網路對比解決這個10分類問題下面畫一個草圖代表三層神經網路的計算圖:import numpy as np import tensorflow as tf import matplotlib.pyplot as

吳恩達 深度學習 神經網路與深度學習 神經網路基礎 課程作業

Part 1:Python Basics with Numpy (optional assignment) 1 - Building basic functions with numpy Numpy is the main package for scientific c

感測器網路與無線自組網的區別

轉自:http://blog.csdn.net/candyice/article/details/4453227 無線自組網(ad hoc network)是一個由幾十到上百個節點組成的、採用無線通訊方式的、動態組網的多跳的移動性對等網路。其目的地是通過動態路

計算機網路:傳輸層和網路層

傳輸層介紹 傳輸層是客戶程式和伺服器程式之間的聯絡人,是一個程序之間的連線。 傳輸層服務 首先了解一下傳輸層所提供的服務。 程序到程序通訊 TCP/IP協議簇的5層模型: 其中,網路層負責計算機層次的通訊(主機到主機通訊),網路層協議只把

計算機網路:傳輸層和網路層(3)

傳輸層介紹 傳輸層是客戶程式和伺服器程式之間的聯絡人,是一個程序之間的連線。 傳輸層服務 首先了解一下傳輸層所提供的服務。 程序到程序通訊 TCP/IP協議簇的5層模型: 其中,網路層負責計算機層次的通訊(主機到主機通訊),網路層協議只把報文傳遞到目的

四層負載均衡與七層負載均衡區別

三方 分類 udp 鏈接 問題: cal 這也 安全性 mac地址 四層負載均衡:僅僅建立一次TCP連接 七層負載均衡:負載均衡器與客戶端及後端的服務器會分別建立一個TCP連接。即兩次TCP連接。 (一) 簡單理解四層和七層負載均衡: ① 所謂四層就是基於IP+端口