CS231n物體定位和檢測

一般流程參考

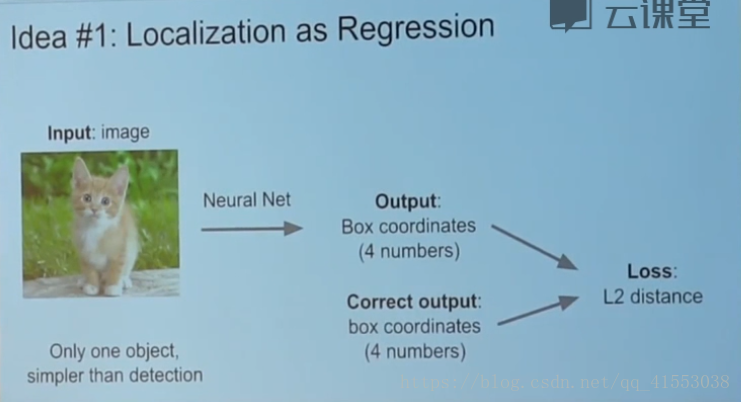

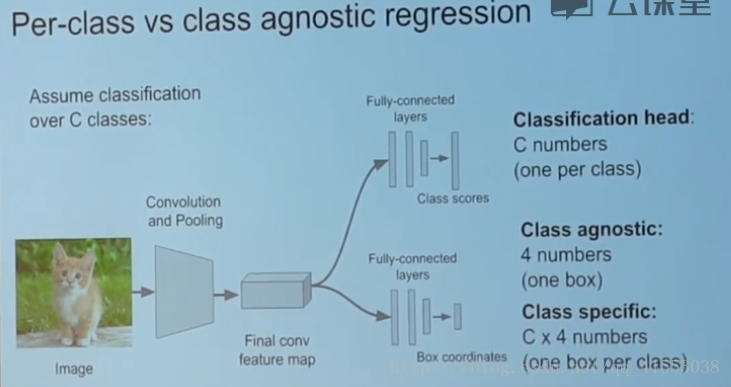

方法一:把定位作為迴歸問題(很實用可以這樣考慮)

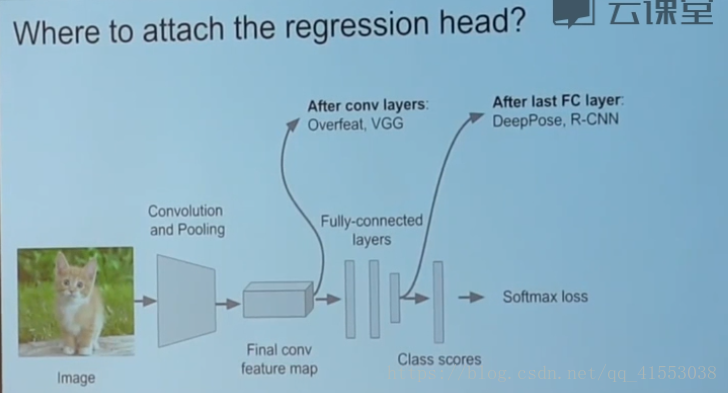

選擇防止迴歸曾的位置,都可以

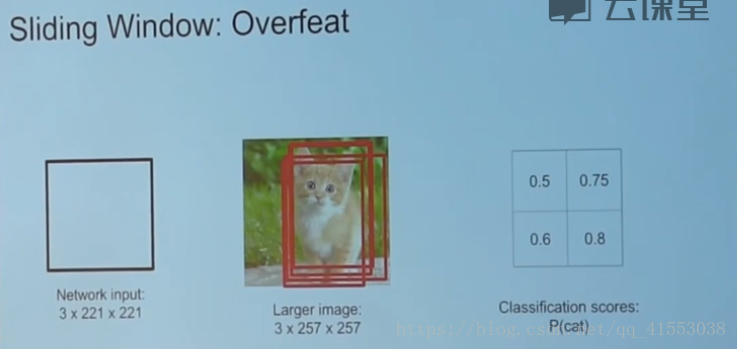

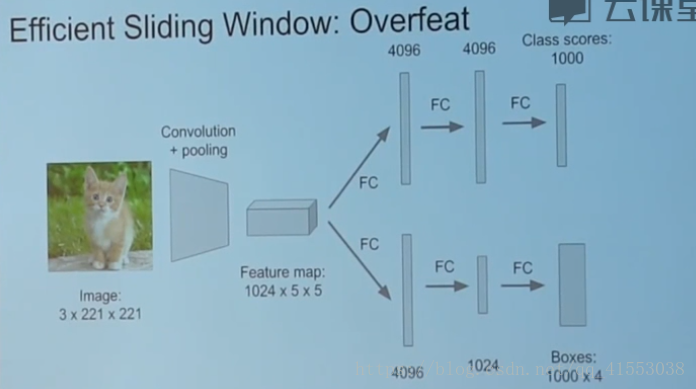

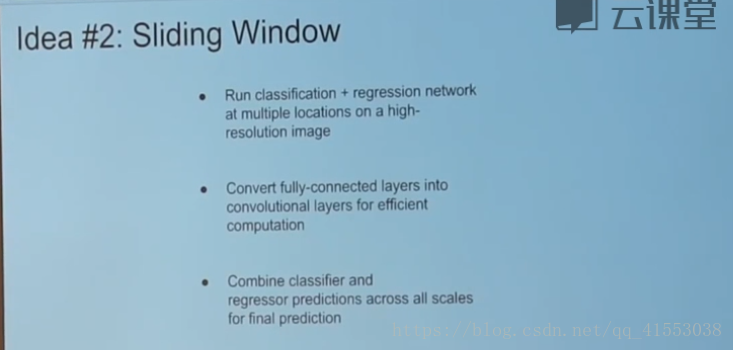

法二:滑動窗法,如overfeat網路

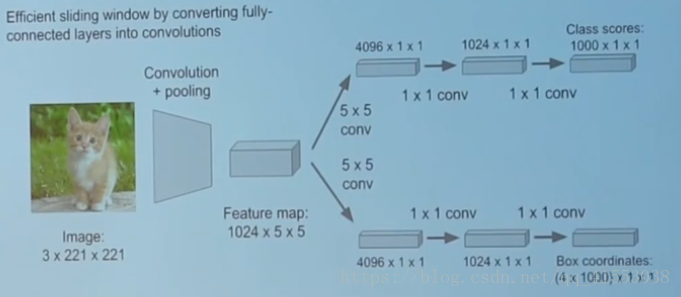

加速(高效)視窗法:不把4096看作向量,而是看作feature map特徵對映,

那麼只剩下卷積和池化操作

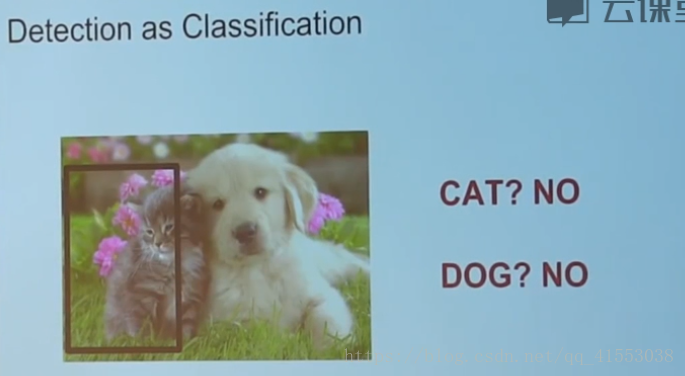

(分類方法)的目標檢測

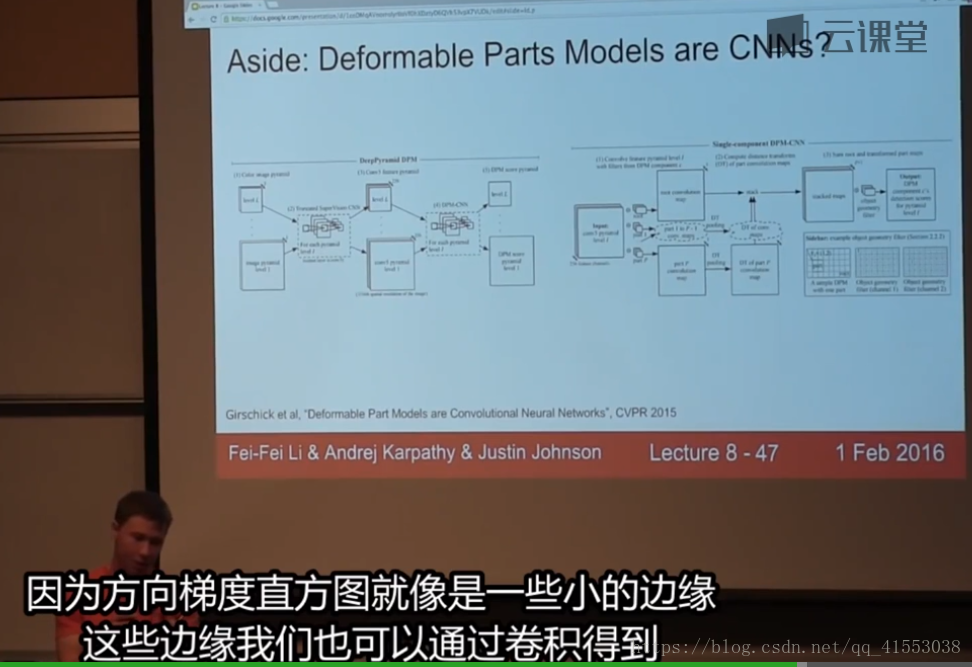

之前的方法有(histogram of oriented gradients)方向梯度直方圖HOG目標檢測,Deformable Parts Model(DPM深度學習前身,對任何尺度,任何長寬比,任何位置進行預處理,速度很快)

dfm也是一種深度學習

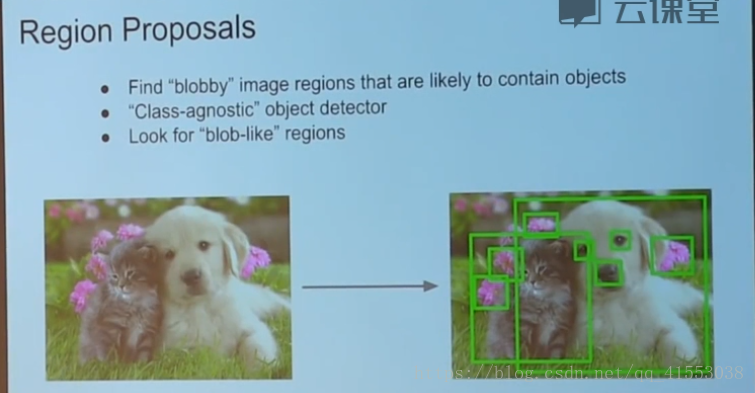

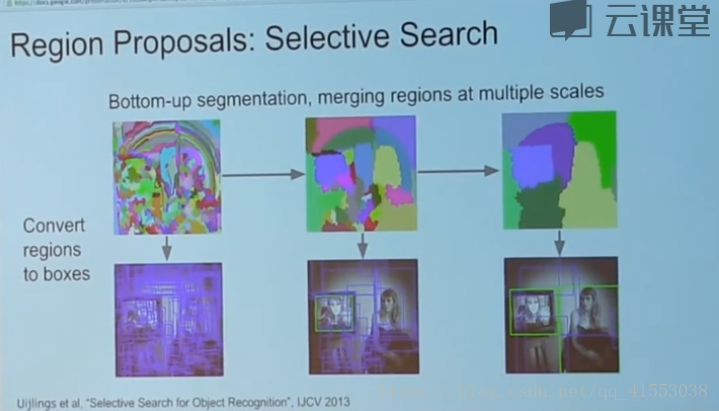

Region proposals區域物件目標檢測器

如ssd

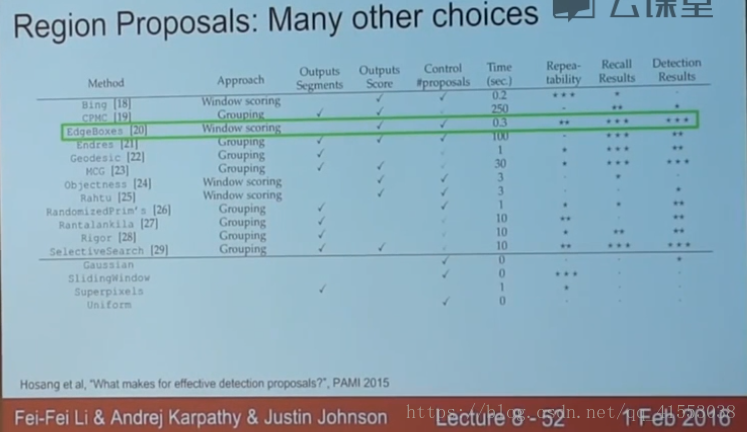

其他檢測方法EDGEBOXES就很好

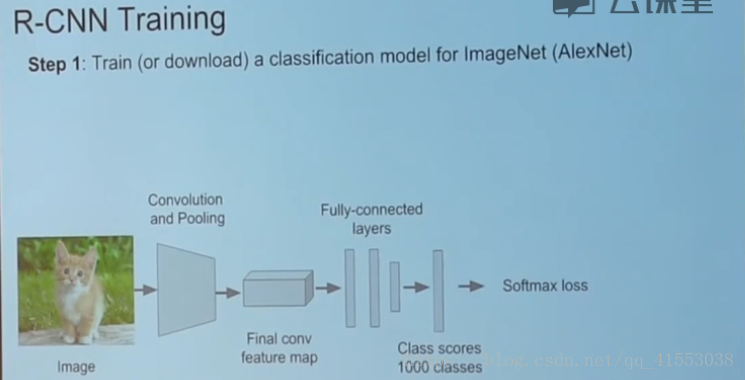

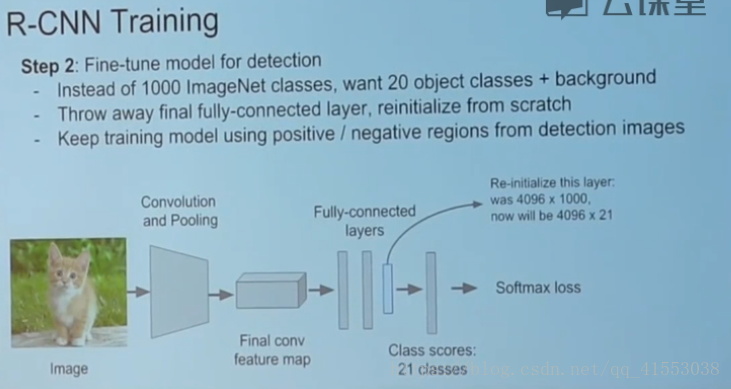

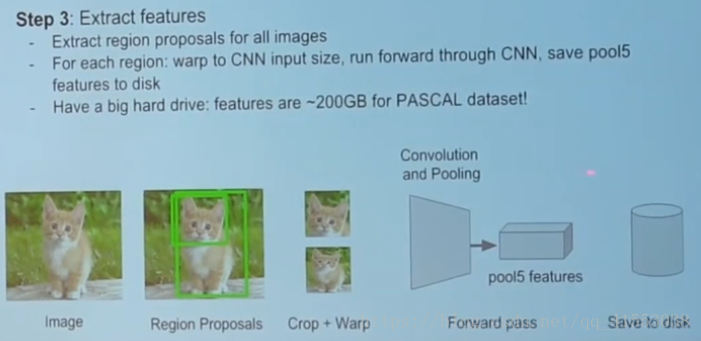

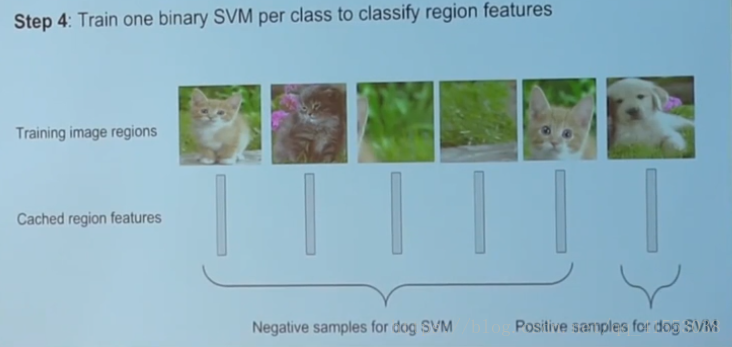

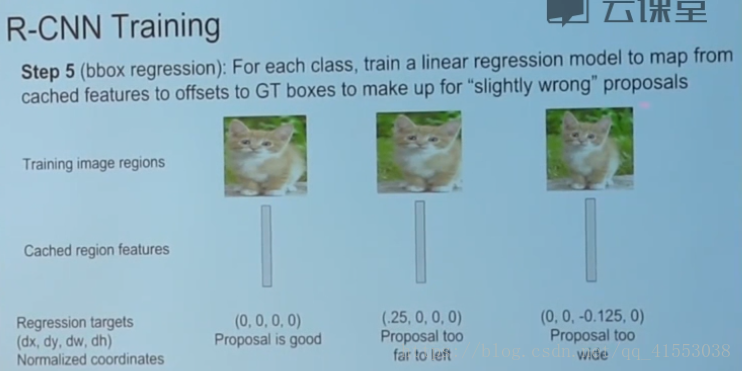

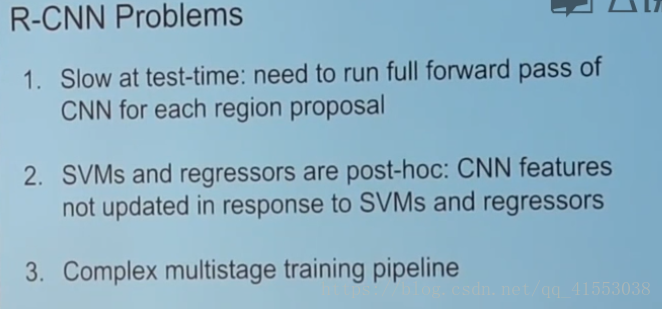

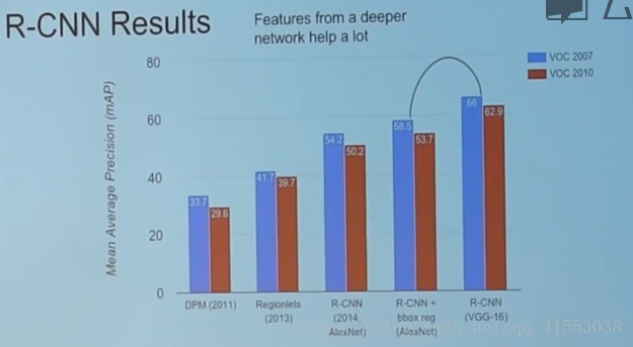

R-CNN

訓練過程

針對你的物件類別,在最後加幾層

硬碟需求量很大

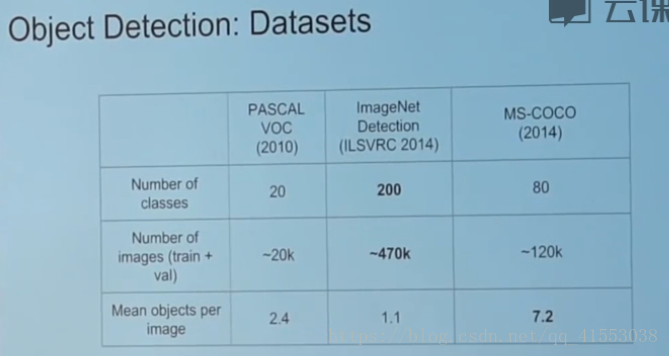

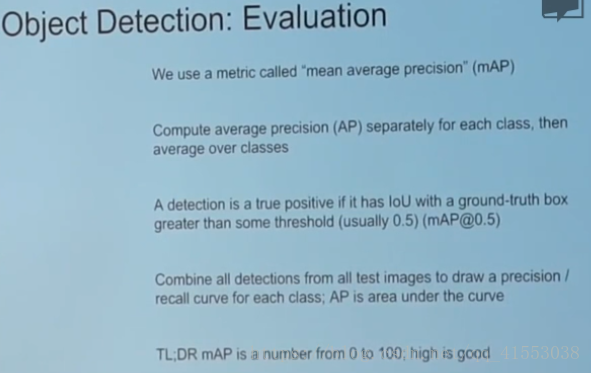

mAP評估

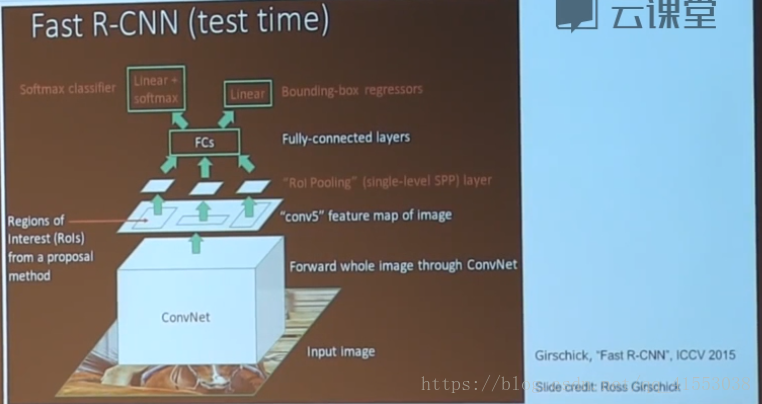

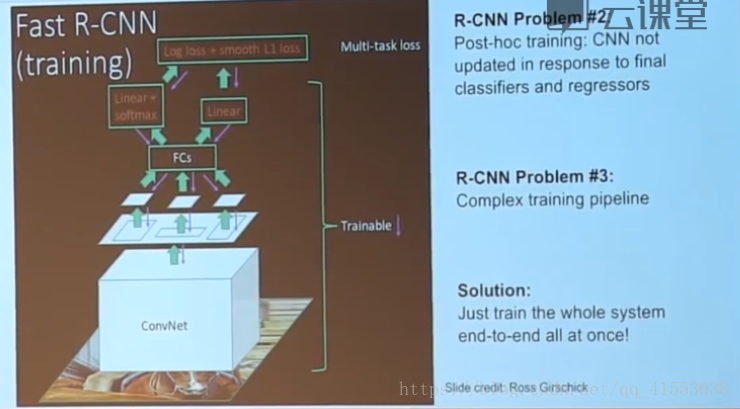

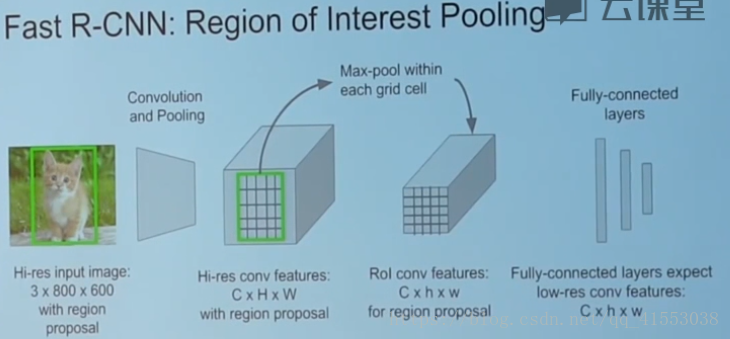

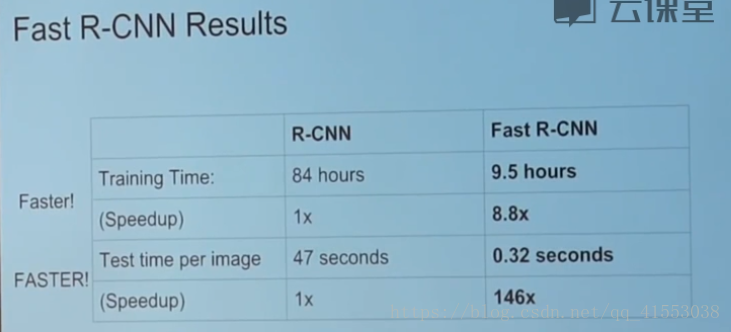

Fast RCNN

共享不同目標框的卷積特徵的計算解決了這個問題

同時訓練所有部分

max pooling用BP演算法

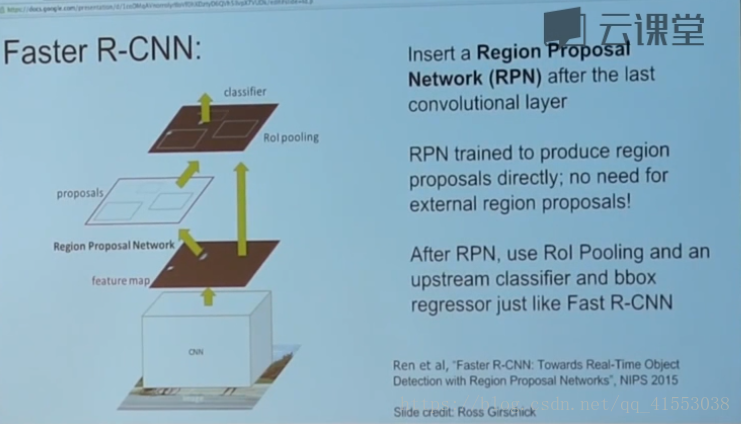

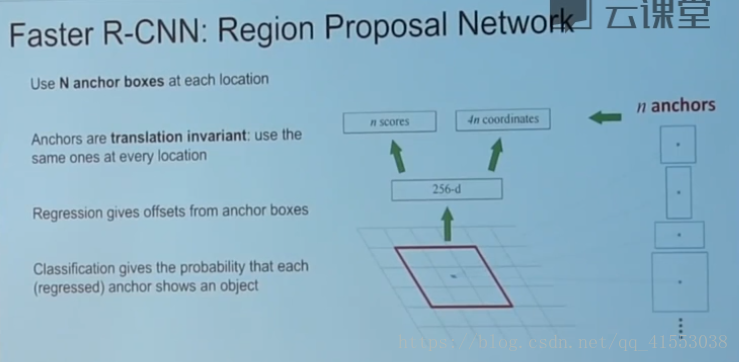

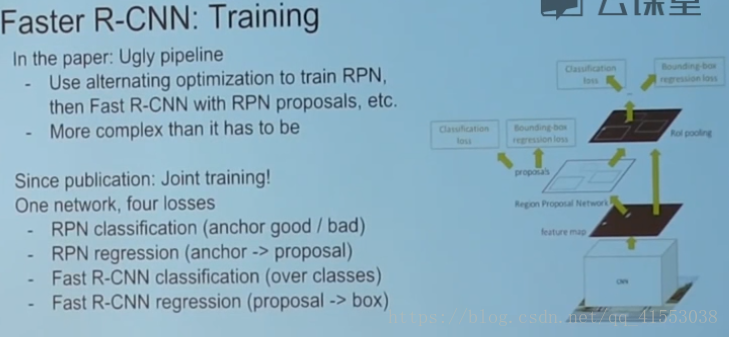

faster RCNN使用RPN區域推薦網路

空間變換神經網路(可參考文獻)

不同於ROI池化,我們做雙線性插值

瞭解名詞:深度殘差網路

把檢測問題當作迴歸問題

相關推薦

CS231n物體定位和檢測

一般流程參考 方法一:把定位作為迴歸問題(很實用可以這樣考慮) 選擇防止迴歸曾的位置,都可以 法二:滑動窗法,如overfeat網路 加速(高效)視窗法:不把4096看作向量,而是看作feature map特徵對映, 那麼只剩下卷積和池化操作 (分類方

目標定位和檢測系列中IOU的含義

本文轉自:https://blog.csdn.net/sinat_34474705/article/details/80045294 交併比(Intersection over Union)和非極大值抑制是(Non-Maximum Suppression)是目標檢測任務中非常重要的兩個概念。例如

目標定位和檢測系列:交併比(IOU)和非極大值抑制(NMS)的python與C/C++實現

Python實現 交併比(Intersection over Union)和非極大值抑制是(Non-Maximum Suppression)是目標檢測任務中非常重要的兩個概念。例如在用訓練好的模型進行測試時,網路會預測出一系列的候選框。這時候我們會用NMS來移除一些多餘的候選框。即移除一些IOU

目標定位和檢測系列(3):交併比(IOU)和非極大值抑制(NMS)的python實現

交併比(Intersection over Union)和非極大值抑制是(Non-Maximum Suppression)是目標檢測任務中非常重要的兩個概念。例如在用訓練好的模型進行測試時,網路會預測出一系列的候選框。這時候我們會用NMS來移除一些多餘的候選框。

目標定位和檢測系列(1):一些基本概念

最近開始學習深度學習中的定位和檢測任務。本來打算直接看論文,卻發現文章中的的很多基本概念都搞不清楚,於是就自己先梳理了一些定位和檢測任務的基本概念。(內容主要來自斯坦福大學的CS231課程、吳恩達的deeplearning.ai卷積部分,這兩門課程都可以在網易雲

嘗試用OpenCV的模板匹配來定位和檢測

1.OpenCV的模板匹配函式: CV_EXPORTS_W void matchTemplate( InputArray image, InputArray templ, OutputArray result, int method ); 模板匹配的工作方式

【Machine Learning】【Python】三、PSO + PCA優化SVM引數C和gamma ---- 《SVM物體分類和定位檢測》

---------------------【6.27 更新libsvm使用方法】-------------------------------------------------------------

【Machine Learning】【Python】一、HoG + SVM 物體分類 ---- 《SVM物體分類和定位檢測》

----------【2018.09.07更新】--- 如果你看到了這篇文章,並且從github下載了程式碼想走一遍整個流程。我強烈建議你把《SVM物體分類和定位檢測》這一系列的6篇文章都仔細看一遍。內容不多,但會對你理解演算法和程式碼有很大的幫助。 ----------

【Machine Learning】【Python】五、Sliding Window + SVM + NMS for Localization ---- 《SVM物體分類和定位檢測》

建議用後面EdgeBoxes做邊框預測,比SW快一點準一點。如果大家感興趣,也建議用faster rcnn SPN層中的anchor技術。--------------------------------

【計算機視覺必讀乾貨】影象分類、定位、檢測,語義分割和例項分割方法梳理

文章來源:新智元 作者:張皓 【導讀】本文作者來自南京大學計算機系機器學習與資料探勘所(LAMDA),本文直觀系統地梳理了深度學習在計算機視覺領域四大基本任務中的應用,包括影象分類、定位、檢測、語義分割和例項分割。 本文旨在介紹深度學習在計算機視覺領域四大基本任務中的應用,包括分類(圖

SSD目標檢測(1):圖片+視訊內的物體定位(附原始碼)

一、SSD用於圖片物體的定位與檢測 SSD原理介紹這一篇部落格對我的幫助比較大,很詳細的介紹了SSD原理,送給大家做了解 1、下載SSD框架原始碼 1.1

CVPR 2018 | 曠視科技Face++新方法——通過角點定位和區域分割檢測場景文字

全球計算機視覺頂會 CVPR 2018 (Conference on Computer Vision and Pattern Recognition,即IEEE國際計算機視覺與模式識別會議)將於6月18日至22日在美國鹽湖城舉行。作為大會鑽石贊助商,曠視科技Face++研究院

記憶體洩漏的檢測、定位和解決經驗總結

局端MCU專案中CSS(Conference Schedule System)、NMS(NetWork Management System)模組自2.03版本起就有記憶體洩露的問題,開發 NGN版本時也花過大量的精力來爭取解決這個問題,雖然也修正了一些記憶體洩漏,但最終檢測工具表面現象顯示剩下的記憶體洩露都是

影象物體分類和物體檢測演算法的概括

參考資料《影象物體分類與檢測演算法綜述》--黃凱奇 計算機學報 1.研究問題: 物體分類:要解決是否這張圖片中包含某類物體 物體檢測:物體出現在圖中的什麼地方,需要給出物體外接矩形 物體分類與檢測演算法的主流方法:基於表達學習和結構學習 2.研究任務 物體分類任務:一張影

IOS 檢測使用者是否開啟定位 和 利用URL Scheme跳轉到系統設定Settings

開發中經常會碰到檢測 使用者是否開啟定位許可權 和 獲取圖片許可權 開啟系統通知 等 有時檢測到使用者系統級關閉,需要去設定裡去開啟。 通過URL Scheme的方式開啟內建的Settings,程式碼如下: 以下是內建的Settings的URL Scheme: Abou

初識視覺SLAM:用相機解決定位和建圖問題

視覺slam引言:視覺SLAM 是指用相機解決定位和建圖問題。本文以一個小機器人為例形象地介紹了視覺SLAM的功能及特點。本文選自《視覺SLAM十四講:從理論到實踐》。 SLAM 是Simultaneous Localization and Mapping 的縮寫,中文譯作“同時定位與地圖構建”。它是指搭載

css中絕對定位和相對定位,文檔流的理解

css 定位 相關鏈接:http://blog.csdn.net/libertea/article/details/11662661 今天在這裏看到了關於一個定位的博客,感覺講的挺好的,在這裏分享一下鏈接。css中絕對定位和相對定位,文檔流的理解

4-SIFT特征提取和檢測的基本步驟

str 識別 賦值 操作 高斯 特征 搜索 擬合 尺度 1- 有4個主要步驟 尺度空間的極值檢測 搜索所有尺度空間上的圖像,通過高斯微分函數來識別潛在的對尺度和選擇不變的興趣點。 特征點定位 在每個候選的位置上,通過一個擬合精細模型來確定位置尺度,關鍵點的選取依據他們的穩

iOS定位和獲取當前天氣

cat ide 獲取 data device targe user urn fig 這裏是定義了一個類,用來當app 啟動的時候,在後臺獲取當前和位置,並根據位置獲取當前天氣信息,當點擊底部的 tabbar 顯示我的控制器的時候,在頁面上顯示當前位置和當前的天氣狀況,天

絕對定位和固定定位

auto osi doctype box order z-index itl 其它 右下角 <!doctype html><html lang="en"> <head> <meta charset="UTF-8"> <