線性迴歸和邏輯迴歸的正則化regularization

線性迴歸

介紹

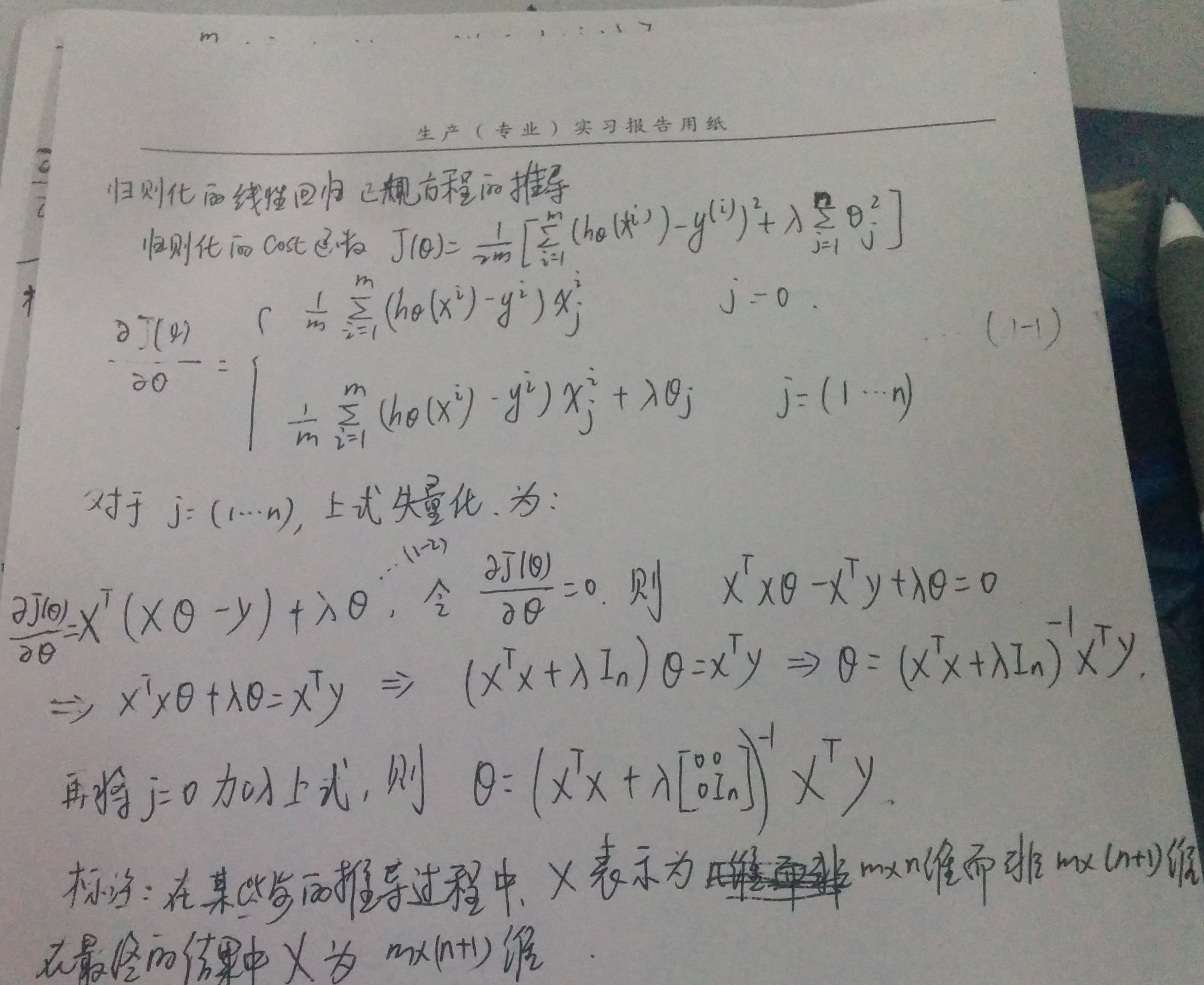

為了防止過度擬合,正則化是一種不錯的思路。能夠使得獲得的邊界函式更加平滑。更好的模擬現實資料,而非訓練樣本。方法

可以說,regularization是新增懲罰,使得引數

邏輯迴歸

同樣的,邏輯迴歸同樣需要加入懲罰項。 則邏輯迴歸的代價函式為令

matlab實現

邏輯迴歸部分matlab實現見網盤http://pan.baidu.com/s/1kT1Tvqn

相關推薦

線性迴歸和邏輯迴歸的正則化regularization

線性迴歸 介紹 為了防止過度擬合,正則化是一種不錯的思路。能夠使得獲得的邊界函式更加平滑。更好的模擬現實資料,而非訓練樣本。 方法 可以說,regularization是新增懲罰,使得引數接近於零,

迴歸問題總結(梯度下降、線性迴歸、邏輯迴歸、原始碼、正則化)

原文地址:http://blog.csdn.net/gumpeng/article/details/51191376 最近,應妹子要求,對迴歸問題進行了總結。 網上相關資料很多,主要是針對Andrew Ng的線上課程寫的筆記, 但大部分都講得不清晰。這篇部落格不能

【番外】線性迴歸和邏輯迴歸的 MLE 視角

線性迴歸 令 z = w

tensorflow實現線性迴歸和邏輯迴歸

關於線性迴歸和邏輯迴歸的原理和python實現,請左轉:邏輯迴歸、線性迴歸。 這裡就直接貼程式碼了。 線性迴歸: # -*- coding: utf-8 -*- """ Created on Thu Aug 30 09:40:50 2018 @author: 96jie """ im

線性迴歸和邏輯迴歸區別

線性迴歸和邏輯迴歸 線性:y=a*x 是一次方的變化 迴歸:迴歸到平均值 線性迴歸用作迴歸預測 邏輯迴歸用作二分類,也可以做多分類 從資料上來講,線性迴歸的樣本的輸出,都是連續值 邏輯迴歸中y只能取0或者1。 從擬合函式講,線性迴歸: 邏輯迴歸: 邏輯迴歸實際上就是在多元線性迴歸

線性迴歸和邏輯迴歸的區別

迴歸問題的條件/前提: 1) 收集的資料 2) 假設的模型,即一個函式,這個函式裡含有未知的引數,通過學習,可以估計出引數。然後利用這個模型去預測/分類新的資料。 1. 線性迴歸 假設 特徵 和 結果 都滿足線性。即不大於一次方。這個是針對 收集的資料而言。 收集的資料中,每一個分量,就

線性迴歸和邏輯迴歸介紹

概述 線性迴歸和邏輯迴歸是機器學習中最基本的兩個模型,線性迴歸一般用來解決預測問題,邏輯迴歸一般解決分類問題,線性迴歸模型和邏輯迴歸模型之間既有區別又有關聯。 線性迴歸模型 假定訓練資料集為

機器學習演算法總結--線性迴歸和邏輯迴歸

1. 線性迴歸 簡述 在統計學中,線性迴歸(Linear Regression)是利用稱為線性迴歸方程的最小平方函式對一個或多個自變數和因變數之間關係進行建模的一種迴歸分析。這種函式是一個或多個稱為迴歸係數的模型引數的線性組合(自變數都是一次方)。只有一

Python實現線性迴歸和邏輯迴歸演算法

本文使用python實現了線性迴歸和邏輯迴歸演算法,並使用邏輯迴歸在實際的資料集上預測疝氣病症病馬的死亡率(當然這裡我們的線性迴歸和邏輯迴歸實現是原生的演算法,並沒有考慮正則化係數問題,後期會將其補充完整)。 一、線性迴歸 1.模型表示 2.損失函式

線性迴歸和邏輯迴歸損失函式的區別

首先說什麼是凸函式。對區間[a,b]上定義的函式f,若它對區間中任意兩點x1和x2,均有f((x1+x2)/2)<=(f(x1)+f(x2))/2,則稱f為區間[a,b]上的凸函式。對實數集上的函

機器學習 -- 線性迴歸和邏輯迴歸的區別

迴歸演算法是一種通過最小化預測值與實際結果值之間的差距,而得到輸入特徵之間的最佳組合方式的一類演算法。對於連續值預測有線性迴歸等,而對於離散值/類別預測,我們也可以把邏輯迴歸等也視作迴歸演算法的一種。 線性迴歸與邏輯迴歸是機器學習中比較基礎又很常用的內容。線性迴歸主

【演算法原理】從模型假設看線性迴歸和邏輯迴歸

摘要 本文從演算法的模型假設方面,對線性迴歸、邏輯迴歸和感知器做一下簡要對比,說明了它們之間的聯絡。 符號約定 1)樣本集合: (xi,yi)(1⩽i⩽m)(xi,yi)(1⩽i⩽m),其中ii表示一共mm個樣本中的第ii個 2)xi=(xi0,xi

線性迴歸和邏輯迴歸的比較

線性迴歸 用一組變數的(特徵)的線性組合,來建立與結果之間的關係。 模型表達:y(x,w)=w0+w1x1+...+wnxny(x,w)=w0+w1x1+...+wnxn 邏輯迴歸 邏輯迴歸用於分類,而不是迴歸。 線上性迴歸模型中,輸出一般是連續的

資料探勘從入門到放棄(一):線性迴歸和邏輯迴歸

“ 資料探勘演算法基於線性代數、概率論、資訊理論推導,深入進去還是很有意思的,能夠理解數學家、統計學家、計算機學家的智慧,這個專欄從比較簡單的常用演算法入手,後續研究基於TensorFlow的高階演算法,最好能夠參與到人臉識別和NLP的實際專案中,做出來一定的效果。” 一、理解線性迴歸

深度學習中的歸一化(normalization)和正則化(regularization)

機器學習的學習過程基於概率和統計學,學習到的知識能用於其它資料的一個基本假設是獨立同分布(IID),因此把資料變成同分布是很有必要的。 A.權重歸一化: WN 不歸一化特徵,而是歸一化權重。 B.特徵歸一化: BN、LN、IN、GN、SN 歸一化操作 BN、LN、IN、GN這

深度學習基礎--正則化與norm--正則化(Regularization)

正則化(Regularization) 一種防止過擬合,提高泛化能力的技巧,因此演算法正則化的研究成為機器學習中主要的研究主題。此外,正則化還是訓練引數數量大於訓練資料集的深度學習模型的關鍵步驟。 正則化可以避免演算法過擬合,過擬合通常發生在演算法學習的輸入資料無法反應真實的分佈

CS229 5.用正則化(Regularization)來解決過擬合

1 過擬合 過擬合就是訓練模型的過程中,模型過度擬合訓練資料,而不能很好的泛化到測試資料集上。出現over-fitting的原因是多方面的: 1) 訓練資料過少,資料量與資料噪聲是成反比的,少量資料導致噪聲很大 2 )特徵數目過多導致模型過於複雜,如下面的圖所示: 看上圖中的多項式迴歸(Polyn

訓練過程--正則化(regularization)技巧(包括L2正則化、dropout,資料增廣,早停)

正則化(regularization) 正則化是解決高方差問題的重要方案之一,也是Reducing Overfiltering(克服過擬合)的方法。 過擬合一直是DeepLearning的大敵,它會導致訓練集的error rate非常小,而測試集的error rate大部分時候很

NG機器學習總結-(五)正則化 Regularization

一、過擬合問題 在解釋什麼是過擬合問題之前,首先還是以房價預測為例。假設這裡我們用三種不同的模型去擬合數據集,如下圖三種情況: 從第一張圖看,我們發現我們是用一條直線去擬合數據,但是這樣的擬合效果並不好。從資料中,很明顯隨著房子面積的增大,房價的變化趨於穩定或者說越往

(五)用正則化(Regularization)來解決過擬合

1 過擬合 過擬合就是訓練模型的過程中,模型過度擬合訓練資料,而不能很好的泛化到測試資料集上。出現over-fitting的原因是多方面的: 1) 訓練資料過少,資料量與資料噪聲是成反比的,少量資料導致噪聲很大 2 )特徵數目過多導致模型過於複雜,如下面的圖所示: 看上圖中的多