決策樹(decision tree)——缺失值處理

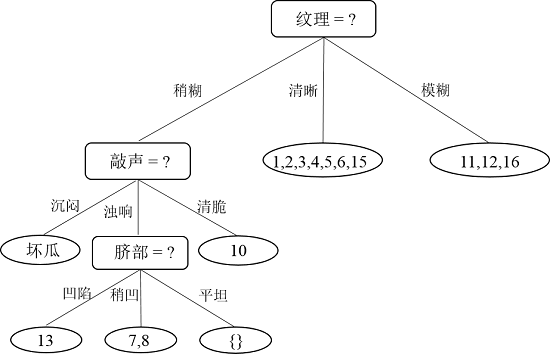

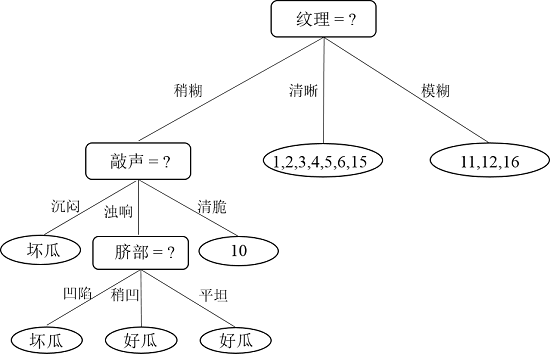

接下來,繼續,對於結點{13},因為就一個樣本了,直接把該結點標記為葉結點,類別為“壞瓜”;遞迴到結點{7,8},因為樣本類別相同,所以也標記為葉結點,類別為“好瓜”;遞迴到結點“臍部=平坦”,因為這個結點不包含任何樣本為空集,因此,把該結點標記為葉結點,類別設定為父節點中多數類的類別,即為“好瓜”。因此“紋理=稍糊”這顆子樹構造完畢,如下圖所示:

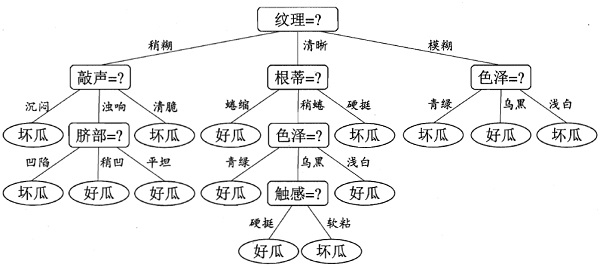

接下來,只需遞迴的重複上述過程即可,即能訓練出一顆完整的決策樹,最終的決策樹如下圖所示(該圖片來自西瓜書):

關於決策樹中的缺失值處理就介紹到,歡迎大家留言交流。

相關推薦

決策樹(decision tree)——缺失值處理

接下來,繼續,對於結點{13},因為就一個樣本了,直接把該結點標記為葉結點,類別為“壞瓜”;遞迴到結點{7,8},因為樣本類別相同,所以也標記為葉結點,類別為“好瓜”;遞迴到結點“臍部=平坦”,因為這個結點不包含任何樣本為空集,因此,把該結點標記為葉結點,類別設定為父節點中多數類的類別,即為“好瓜”。因此“紋

決策樹(Decision Tree)SkLearn

true predict mat ray int lec pytho next() action #!/usr/bin/env python # -*- coding: utf-8 -*- from sklearn.feature_extraction import Di

決策樹(decision tree)

方法 生成算法 ogr np完全 信息熵 cti 標記 ges 樹形 決策樹是一種基本的分類和回歸方法。本章主要討論用於分類的決策樹,決策樹模型呈樹形結構,在分類問題中,表示基於特征對實例進行分類的過程,它可以認為是if-then規則的集合,也可以認為是定義在特征空間與類空

決策樹(Decision Tree)原理

範圍 思想 選擇 規則 是我 概念 而是 tree 個人 決策樹的思想在生活中很常見,其實就是根據條件去做決定,選擇最符合我們自己東西,例如買房子,我們要考慮的有城市/地段/是否有地鐵/開發商/戶型等等這些因數,這些因數在我們決策樹中就叫做特征,我們就是根據這些特

1.決策樹(decision tree)演算法(ID3)

0.機器學習中分類和預測演算法的評估: 準確率 速度 強壯性 可規模性 可解釋性 1.什麼是決策樹/判定樹(decision tree)? 1.1.判定書是一個類似於流程圖的樹結構:其中,每個內部結點表示在一個屬性上的測試,每個分支代表一個屬

機器學習-決策樹(decision tree)

機器學習中分類和預測演算法的評估: 準確率 速度 強壯性(演算法中當有噪音和某些值缺失時,演算法能否依然很好) 可規模性 可解釋性(能否很好的解釋模型) 一、什麼是決策樹? 1、判定樹(決策樹)是一個類似於流程圖的樹結構,其中,每個內部節點表示在一個屬性上的

決策樹(decision tree)演算法

*機器學習中分類和預測演算法的評估: 準確率 速度 強壯性 可規模性 可解釋性 1.什麼是決策樹/判定樹(decision tree)? 判定樹是一個類似於流程圖的樹結:其中,每個內部節點表示在一個屬性上的測試,每個分支代表一個屬性輸出,而每個樹葉節

機器學習之:決策樹(Decision Tree)

Decision Tree 1. 決策樹 決策樹是機器學習中最接近人類思考問題的過程的一種演算法。通過若干個節點,對特徵進行提問並分類(可以是二分類也可以使多分類),直至最後生成

機器學習經典演算法詳解及Python實現--決策樹(Decision Tree)

(一)認識決策樹 1,決策樹分類原理 決策樹是通過一系列規則對資料進行分類的過程。它提供一種在什麼條件下會得到什麼值的類似規則的方法。決策樹分為分類樹和迴歸樹兩種,分類樹對離散變數做決策樹,迴歸樹對連續變數做決策樹。 近來的調查表明決策樹也是最經常使用的資料探勘演算法,它

機器學習 之 決策樹(Decision Tree)文字演算法的精確率

目錄 背景 效果圖 整體流程 這裡用詞向量,而不是TF-IDF預處理後的向量 原始碼 背景 最近的專案中,用到了很多機器學習的演算法,每個機器學習的演算法在不同的樣本下的精準率是不同的。為了驗證每個演算法在每種不同樣本數

機器學習: 決策樹(Decision Tree)

1. 理論 概述: 決策樹的內部節點表示一個特徵或屬性,葉子節點表示一個類別。輸入一個新樣本,從根節點開始按照節點說示的特徵劃分,直到劃分到葉子節點,該葉子節點即為類別。 關於熵的基礎知識 熵:

【Machine learning】決策樹(decision tree )

三個問題: 怎樣選擇根節點 怎樣選擇後繼節點 什麼時候停止 (一顆決策樹=》一個分類準則=》一個模型) 基本的演算法: 對一開始提出來的三個問題進行解答: 1.選擇最優屬性 ID3: 最優屬性選擇資訊增益最大的屬性來作為最優屬性 設D為用

機器學習之決策樹(Decision Tree)及其Python程式碼實現

決策樹是一個預測模型;他代表的是物件屬性與物件值之間的一種對映關係。樹中每個節點表示某個物件,而每個分叉路徑則代表的某個可能的屬性值,而每個葉結點則對應從根節點到該葉節點所經歷的路徑所表示的物

機器學習:決策樹(Decision Tree)

本部落格參考鄒博機器學習課件以及李航的《統計學習方法》,僅用於督促自己學習使用,如有錯誤,歡迎大家提出更正 決策樹(decision tree)是一種基本的分類與迴歸方法。在分類問題中,它可以認為是if-then規則的集合,也可以認為是定義在特徵空間與

機器學習教程之13-決策樹(decision tree)的sklearn實現

0.概述 決策樹(decision tree)是一種基本的分類與迴歸方法。 主要優點:模型具有可讀性,分類速度快。 決策樹學習通常包括3個步驟:特徵選擇、決策樹的生成和決策樹的修剪。 1.決策樹模型與學習 節點:根節點、子節點;內部節點(inter

決策樹(decision tree)

from ase size eat for pan ted count import 代碼還好懂,但是後面選擇更好的劃分數據集的方法,有點不知道為什麽那樣選。 還要好好理解推導。 from math import log #計算香農熵 def calcShannonEnt

【Spark MLlib速成寶典】模型篇05決策樹【Decision Tree】(Python版)

back filter oms sse mlu eval ffffff size red 目錄 決策樹原理 決策樹代碼(Spark Python) 決策樹原理 詳見博文:http://www.cnblogs.com/itmorn/p/79

機器學習與深度學習系列連載: 第一部分 機器學習(十一)決策樹2(Decision Tree)

決策樹2 決策樹很容易出現過擬合問題,針對過擬合問題,我們採用以下幾種方法 劃分選擇 vs 剪枝 剪枝 (pruning) 是決策樹對付“過擬合”的 主要手段! 基本策略: 預剪枝 (pre-pruning): 提前終止某些分支的生長 後剪枝 (post-pr

分類算法:決策樹(C4.5)(轉)

clas 依賴 1.5 -s clip win pan 定義 衡量 C4.5是機器學習算法中的另一個分類決策樹算法,它是基於ID3算法進行改進後的一種重要算法,相比於ID3算法,改進有如下幾個要點: 1)用信息增益率來選擇屬性。ID3選擇屬性用的是子樹的信息增益,這裏可

決策樹(理論篇)

傳輸 ner normal fin 朋友 關於 經典算法 公式推導 就會 定義 由一個決策圖和可能的結果(包括資源成本和風險組成),用來創建到達目的的規劃。——維基百科 通俗理解 給定一個輸入值,從樹節點不斷往下走,直至走到葉