線性迴歸與邏輯迴歸、softmax迴歸

1.線性迴歸

預測函式:

hθ(x)=θ0+θ1x

1.1 梯度下降法

損失函式(均方差損失函式):

minJ(θ)=2m1i=1∑m(hθ(xi)−yi)2

求偏導:

∂θ0∂J=m1i=1∑m(hθ(xi)−yi)

∂θ1∂J=m1i=1∑m(hθ(xi)−yi)xi

重複進行直到收斂{

同步更新:

θj:=θj−α∂θj∂J

}

1.2 正則方程法

適用於特徵數n較小時

Xθ=y

→θ=(XTX)−1XTy

注意:XTX須為列滿秩矩陣,方可求逆,出現不可逆的情況:

- 冗餘特徵,線性相關

- 特徵數太多n>>m ,應刪減特徵或使用正則化

2.邏輯迴歸

線性迴歸上加啟用函式(sigmoid函式):

g(z)=1+e−z1

Q:為什麼要使用sigmoid函式?

從對數線性模型推導而來的,發生的概率,比上不發生的概率,取log,等於y,反推出來就sigmoid函式。

y=ln(1−pp)

→p=sigmoid(y)=1+eyey=1+e−y1

預測函式:

hθ(x)=g(θTX)=1+e−θTX1

hθ(x)表示結果取1的概率:

- P(y=1∣x;θ)=hθ(x) 結果取1的概率越大越好

- P(y=0∣x;θ)=1−hθ(x) 結果取0的概率越大越好

- 總之就是希望結果越肯定越好

- 邏輯迴歸的本質–極大似然估計:max∑i=1mlogP(yi∣x;θ)

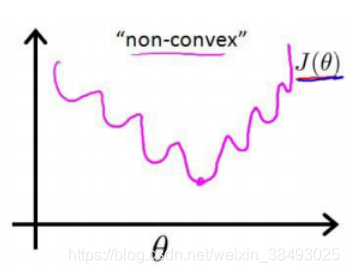

Q:邏輯迴歸損失函式為什麼使用最大似然而不用最小二乘?

用最小二乘的話損失函式是非凸函式,很容易陷入區域性最優解。

損失函式(交叉熵損失函式):

minJ(θ)=−m1i=1∑m[yiloghθ(xi)+(1−yi)log(1−hθ(xi))]

- 當yi=1時中括號前半部分奏效,logP(yi∣x;θ)=logP(yi=1∣x;θ)=loghθ(xi)

- 當yi=0時中括號後半部分奏效。logP(yi∣x;θ)=logP(yi=0∣x;θ)=log(1−hθ(xi))

求偏導:

∂θj∂J=m1i=1∑m(hθ(xi)−yi)xij

注意到上式同線性迴歸求偏導的公式完全一樣!!!

推導過程參考:https://www.cnblogs.com/zhongmiaozhimen/p/6155093.html

利用到sigmoid函式的性質:

g′(z)=g(z)(1−g(z))

3.softmax迴歸

softmax迴歸是邏輯迴歸的多分類情況。

1.線性迴歸

預測函式:

hθ(x)=θ0+θ1xh_\theta(x)=\theta_0+\theta_1xhθ(x)=θ0+θ1x

1.1 梯度下降法

損失函式(均方差損失函式):

minJ(θ)=12m∑i=1m(hθ(xi)−yi)2\min J

線性迴歸和邏輯迴歸在機器學習上是一種監督式學習。在預測類問題上,我們希望能通過一個對映關係 ,當給定變數 ,能得到一個較為滿意的預測結果 ,迴歸方法旨在找到能表示樣本空間分佈的對映關係。

一、線性迴歸的基本形式

線性迴歸

以經典的預測房價為例,

假設樣本為(X,yiX, y_iX,yi),其中X是多維變數(X=(x1,x2...xn)X = (x_1, x_2...x_n)X=(x1,x2...xn))

在瞭解了Pytorch的一些機制後,當然要進行一些例項的學習,畢竟實踐出真知嘛。

對於所有的機器學習愛好者來說,第一個要學的模型無疑是線性迴歸

所謂線性迴歸,指的就是用對輸入資料的每個維度進行線性組合擬合Label-y。最簡單的線性迴歸即是二維平面內的直線擬

1. 線性迴歸

線性迴歸是利用數理統計中迴歸分析,來確定兩種或兩種以上變數間相互依賴的定量關係的一種統計分析方法。

直觀地說,在二維情況下,已知一些點的X,Y座標,統計條件X與結果Y的關係,畫一條直線,讓直線離所有點都儘量地近(距離之和最小),用直線抽象地表達這些點,然後對新的X預測新的Y。具體實現一般

logistics本質是線性迴歸,只不過特徵到結果加了一層對映。即先把特徵線性求和,在用Sigmoid函式將結果對映到 [0,1]

如果隨機變數X只取0和1兩個值,並且相應的概率為:

則稱隨機變數X服從引數為p的伯努利分佈,若令q=1一p,則X的概率函式可寫

為:

也可以配合這篇文章(CS229學習筆記)進行學習。

目錄

1 迴歸問題

2 虛擬變數

3 迴歸診斷

1 迴歸問題

分類:一元線性迴歸;多元線性(用曲面擬合);廣義線性迴歸(用線性迴歸方法處理非線性迴歸問題);非線性迴歸

線性迴歸和邏輯斯提回歸都是線性模型,雖然邏輯斯提回歸是加了sigmoid函式,引入了非線性,但是它本質上還是隻能解決非線性問題的。

兩者的區別本質上,線性迴歸是做迴歸的,迴歸出y=wx+b的w,b。l

1. 前言–線性迴歸與邏輯迴歸介紹

tensorflow一般入門都至少會講兩種例子,一個是線型迴歸,一個是邏輯迴歸。(或者也可以說,迴歸演算法 & 分類演算法) 線性迴歸用來做迴歸預測,邏輯迴歸用於做二分類,一個是解決迴歸問題,一個用於解決分類問題。兩者區別:

擬合函式

一、Logistic迴歸

Logistic迴歸為概率型非線性迴歸模型,是研究二分類結果與一些影響因素之間關係的一種多變數分析方法。通常是用來研究某些因素條件下某個結果是否發生。

在講解Logistic迴歸理論之前,我們先從LR分類器說起。LR分類器,即Logistic Regression Classifi Classification

It's not a good idea to use linear regression for classification problem.

We can use logistic regression algorism, which is a classificati

本專欄將推出一系列深度學習與影象處理相關的教程文章。注重原理精講和程式碼實現。實現框架將重點選擇Tensorflow或Pytorch。本講從邏輯斯第迴歸入手,然後講解softmax分類器,最後講解多層感知器。文末提供註釋詳盡的Tensorflow程式碼實現。

1. 簡介

邏輯迴歸和Softmax迴歸是兩個基礎的分類模型,前者主要處理二分類問題,而後者處理多分類問題,但事實上Softmax迴歸就是邏輯迴歸的一般形式。

2.邏輯迴歸模型

sigmoid

想了解Logistic迴歸,我們必須先看一看

邏輯迴歸與線性迴歸求解過程:

總體來說,迴歸過程都分三步:

1、Model

2、Loss Fuction

3、Gradient Decent

分析:

1、Model:線性迴歸中,模型為線性方程,取值範圍無窮大;邏輯迴歸中,通過sigmod函式函式將線性方程z轉化成概率(

import numpy as np

import pandas as pd

import matplotlib.pyplot as plt

import os

path = "data"+os.sep+"creditcard.csv";

pdData =

本文適合已經對機器學習、人工智慧有過一定了解,但是還沒有自己寫過程式碼,或者一直在使用現有框架的同學。不用框架自己寫一次程式碼的過程還是很有必要的,能讓你真正地理解原理與機器學習中各個步驟的實現過程,而不是停留在“好像懂了”、只會調庫的階段。

目錄

邏輯迴歸

對邏輯迴歸的理解:對線性迴歸的假設函式的 f(x) 又套上了一層sigmoid函式,即g(f(x)).

然後sigmoid函式是長這樣的:

它的影象長這樣:

對於線性迴歸得到的結果,再經過一層sigmoid函式,以x=0為界限,左邊為0,右邊為1,邏輯迴歸就是這樣一個二分類

原文為:http://blog.csdn.net/viewcode/article/details/8794401

迴歸問題的條件/前提:

1) 收集的資料

2) 假設的模型,即一個函式,這個函式裡含有未知的引數,通過學習,可以估計出引數。然後利用這個模型去預測/分

對於所有的模型和演算法,都有一個目標方程,比較理想的目標方程應該有兩部分構成:損失函式和正則項,一個用來衡量模型的擬合效果,一個用來儘可能保證模型的簡單和穩定:

Obj(Θ)=L(Θ)+Ω(Θ)(2)(2)Obj(Θ)=L(Θ)+Ω(Θ)

損失函式:

平方

2、從‘廣義線性模型(GLM:generalized linear models)’和‘指數族’說起:

(1)指數族(the exponential family)

伯努利分佈:

高斯分佈:

(2)GLM

3、為什麼sigma函式可以代表概率?

設y只取0,1

4、邏輯迴歸

啟用函式(softmax函式):

g(z)=∑j=1kej

相關推薦

線性迴歸與邏輯迴歸、softmax迴歸

機器學習 --- 線性迴歸與邏輯迴歸

線性迴歸與邏輯迴歸的區別

Pytorch學習筆記(三)線性迴歸與邏輯迴歸

機器學習_最小二乘法,線性迴歸與邏輯迴歸

線性迴歸與邏輯迴歸的區別與聯絡

線性迴歸與邏輯迴歸

線性迴歸與邏輯斯提回歸的區別

tensorflow example 入門例子(線型迴歸與邏輯迴歸)

Logistic迴歸、softmax迴歸以及tensorflow實現MNIST識別

Machine Learning--week3 邏輯迴歸函式(分類)、決策邊界、邏輯迴歸代價函式、多分類與(邏輯迴歸和線性迴歸的)正則化

邏輯斯第迴歸、softmax分類與多層感知器

機器學習--邏輯迴歸與softmax

機器學習4:邏輯迴歸與線性迴歸

機器學習筆記《四》:線性迴歸,邏輯迴歸案例與重點細節問題分析

機器學習(一)邏輯迴歸與softmax迴歸及程式碼示例

機器學習筆記之七——邏輯迴歸簡單推導、softmax簡單理解以及sklearn中邏輯迴歸常用引數解釋

對線性迴歸、邏輯迴歸、各種迴歸的概念學習

線性迴歸、嶺迴歸、Lasso迴歸、邏輯迴歸的總結

各種迴歸全解:傳統迴歸、邏輯迴歸、加權迴歸/核迴歸、嶺迴歸、廣義線性模型/指數族