8.大資料學習之旅——hadoop-Hadoop完全分散式配置

阿新 • • 發佈:2019-01-12

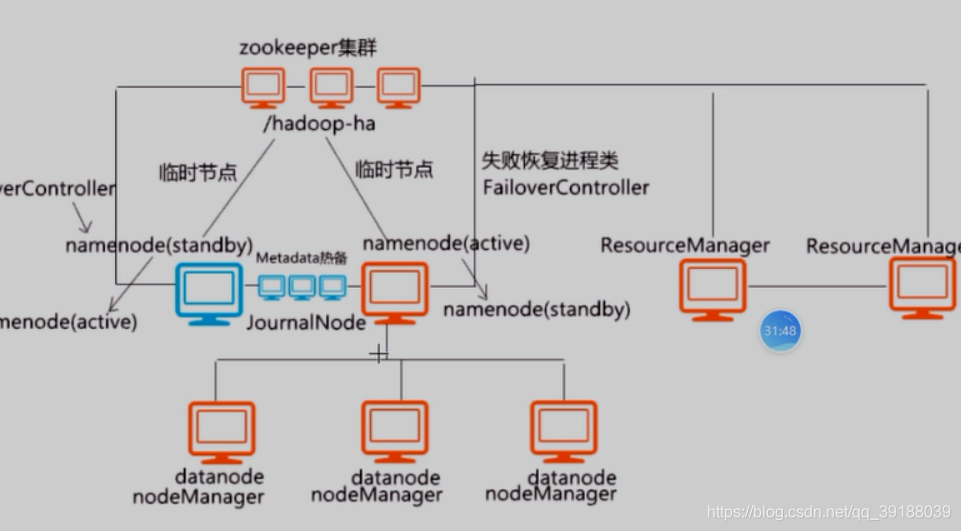

Hadoop完全分散式配置

- 關閉防火牆

- 修改主機名

- 配置hosts檔案。將需要搭建叢集的主機全部配置到hosts檔案中

192.168.32.138 hadoop01

192.168.32.139 hadoop02

192.168.32.140 hadoop03

- 配置免密登入

- 安裝jdk

- 安裝zk

- 配置Hadoop

- 編輯hadoop-env.sh,並且重新生效

- 編輯core-site.xml

<!--指定hdfs的nameservice,為整個叢集起一個別名--> - 編輯hdfs-site.xml

<!--執行hdfs的nameservice為ns,注意要和core-site.xml中的名稱保持一致-->

<property>

<name>dfs.nameservices</name>

<value - 編輯mapred-site.xml

<property>

<name>mapreduce.framework.name</name>

<value>yarn</value>

</property>

- 編輯yarn-site.xml

<!--配置yarn的高可用-->

<property>

<name>yarn.resourcemanager.ha.enabled</name>

<value>true</value>

</property>

<!--指定兩個resourcemaneger的名稱-->

<property>

<name>yarn.resourcemanager.ha.rm-ids</name>

<value>rm1,rm2</value>

</property>

<!--配置rm1的主機-->

<property>

<name>yarn.resourcemanager.hostname.rm1</name>

<value>hadoop01</value>

</property>

<!--配置rm2的主機-->

<property>

<name>yarn.resourcemanager.hostname.rm2</name>

<value>hadoop03</value>

</property>

<!--開啟yarn恢復機制-->

<property>

<name>yarn.resourcemanager.recovery.enabled</name>

<value>true</value>

</property>

<!--執行rm恢復機制實現類-->

<property>

<name>yarn.resourcemanager.store.class</name>

<value>org.apache.hadoop.yarn.server.resourcemanager.recovery.ZKRMStateStore</

value>

</property>

<!--配置zookeeper的地址-->

<property>

<name>yarn.resourcemanager.zk-address</name>

<value>hadoop01:2181,hadoop02:2181,hadoop03:2181</value>

</property>

<!--執行yarn叢集的別名-->

<property>

<name>yarn.resourcemanager.cluster-id</name>

<value>ns-yarn</value>

</property>

<!-- 指定nodemanager啟動時載入server的方式為shuffle server -->

<property>

<name>yarn.nodemanager.aux-services</name>

<value>mapreduce_shuffle</value>

</property>

<!-- 指定resourcemanager地址 -->

<property>

<name>yarn.resourcemanager.hostname</name>

<value>hadoop03</value>

</property>

- 編輯slaves

hadoop01

hadoop02

hadoop03

- 拷貝到其他節點上

- 啟動zookeeper

- 格式化zookeeper

hdfs zkfc -formatZK

- 啟動journalnode

hadoop-daemon.sh start journalnode

- 在第一臺節點上格式化並啟動namenode

hadoop namenode -format

hadoop-daemon.sh start namenode

- 在第二個節點上格式化啟動namenode

hdfs namenode -bootstrapStandby

hadoop-daemon.sh start namenode

- 三臺節點啟動datanode

hadoop-daemon.sh start datanode

- 在第一臺節點和第二節點上啟動zkfc(FailoverController)

hadoop-daemon.sh start zkfc

- 在第一個節點上啟動yarn

start-yarn.sh

- 在第三個節點上啟動resourcemanager

yarn-daemon.sh start resourcemanager

需要hadoop叢集的請在部落格中搜索

Hadoop叢集中需要編輯的檔案.part1.rar

Hadoop叢集中需要編輯的檔案.part2.rar

兩部分壓縮包,然後解壓