嶺回歸、LASSO與LAR的幾何意義

https://blog.csdn.net/u013524655/article/details/40922303

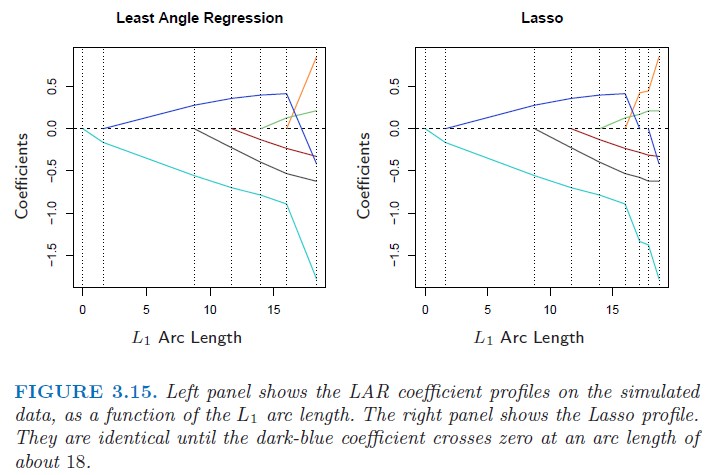

http://f.dataguru.cn/thread-598486-1-1.html

http://www.360doc.com/content/11/0520/00/4910_118025769.shtml

|

|

|

- 上一篇

嶺回歸、LASSO與LAR的幾何意義

相關推薦

嶺回歸、LASSO與LAR的幾何意義

img mes bcg doc PV data tracking tail OS https://blog.csdn.net/u013524655/article/details/40922303 http://f.dataguru.cn/thread-598486-1-

吳裕雄 數據挖掘與分析案例實戰(7)——嶺回歸與LASSO回歸模型

Y軸 otl error 處理 回歸 models 關系 err idg # 導入第三方模塊import pandas as pdimport numpy as npimport matplotlib.pyplot as pltfrom sklearn import mod

通俗易懂--嶺回歸(L2)、lasso回歸(L1)、ElasticNet講解(算法+案例)

imageview 第一次 任務 代碼實現 發現 和數 輸入 1.2 通過 1.L2正則化(嶺回歸) 1.1問題 想要理解什麽是正則化,首先我們先來了解上圖的方程式。當訓練的特征和數據很少時,往往會造成欠擬合的情況,對應的是左邊的坐標;而我們想要達到的目的往往是中間的坐標

機器學習--Lasso回歸和嶺回歸

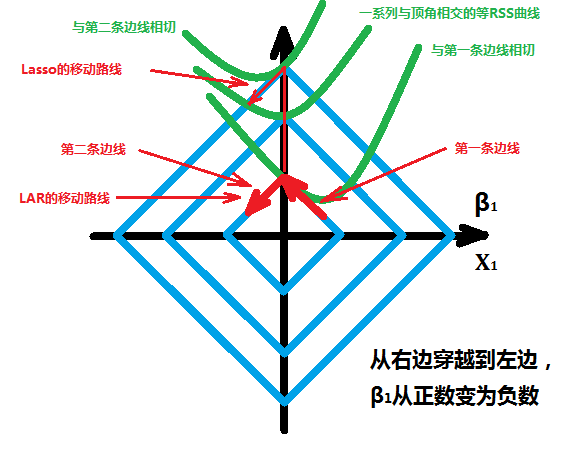

最小二乘 改變 篩選 bsp 相交 二維 block 大於 主成分分析 之前我們介紹了多元線性回歸的原理, 又通過一個案例對多元線性回歸模型進一步了解, 其中談到自變量之間存在高度相關, 容易產生多重共線性問題, 對於多重共線性問題的解決方法有: 刪除自變量, 改變數據形式

R語言統計分析技術研究——嶺回歸技術的原理和應用

gts 根據 誤差 med 分享 jce not -c rt4 嶺回歸技術的原理和應用

嶺回歸技術原理應用

方程 及其 時長 原理 cnblogs 自己 文獻 其中 clas 嶺回歸技術原理應用 作者:馬文敏 嶺回歸分析及其SPSS實現方法 嶺回歸分析(RidgeRegression)是一種改良的最小二乘估計方法,它是用於解決在線性回歸分析中自變量

python Ridge 回歸(嶺回歸)的原理及應用

原理 blog 得到 one 技術 設置 fun src print 嶺回歸的原理: 首先要了解最小二乘法的回歸原理 設有多重線性回歸模型 y=Xβ+ε ,參數β的最小二乘估計為 當自變量間存在多重共線性,|X‘X|≈0時,設想|X‘X|給加上一個正常數矩陣(k>

線性回歸、多項式回歸

數學模型 梯度 數值 簡化 數據 .html 屬於 技術分享 模型 前言 以下內容是個人學習之後的感悟,如果有錯誤之處,還請多多包涵~ 簡介 回歸屬於有監督學習中的一種方法。該方法的核心思想是從連續型統計數據中得到數學模型,然後將該數學模型

ng機器學習視頻筆記(一)——線性回歸、代價函數、梯度下降基礎

info 而且 wid esc 二維 radi pan 圖形 clas ng機器學習視頻筆記(一) ——線性回歸、代價函數、梯度下降基礎 (轉載請附上本文鏈接——linhxx) 一、線性回歸 線性回歸是監督學習中的重要算法,其主要目的在於用一個函數表

機器學習(三)—線性回歸、邏輯回歸、Softmax回歸 的區別

樣本 自變量 進行 方便 線性回歸 https 參數 常用方法 等價 1、什麽是回歸? 是一種監督學習方式,用於預測輸入變量和輸出變量之間的關系,等價於函數擬合,選擇一條函數曲線使其更好的擬合已知數據且更好的預測未知數據。 2、線性回歸 代價函數(平方誤差代價函

《機器學習》學習筆記(一):線性回歸、邏輯回歸

ros XA andrew ID learn 給定 編程練習 size func 《機器學習》學習筆記(一):線性回歸、邏輯回歸 本筆記主要記錄學習《機器學習》的總結體會。如有理解不到位的地方,歡迎大家指出,我會努力改正。 在學習《機器學習》時,我主要是

sklearn help之嶺回歸 ridge regression

reg 圖片 img Go wax .com In AR logs ridge regression: 在最小二乘的基礎上添加一個系數為α的懲罰項,懲罰項為參數向量2範數的平方,可以通過控制α來調節數據集的過擬合問題 擬合方法,參數調用與線性回歸相同 嶺回歸優點:可以應用

MNIST手寫數字圖片識別(線性回歸、CNN方法的手工及框架實現)(未完待續)

shape 初始化 result rect not found pro res edi ise 0-Background 作為Deep Learning中的Hello World 項目無論如何都要做一遍的。 代碼地址:Github 練習過程中將持續更新blog及代碼。 第一

嶺回歸——減少過擬合問題

axis ear git 分享 根據 cal app 訓練 lin 什麽是過擬合? 在訓練假設函數模型h時,為了讓假設函數總能很好的擬合樣本特征對應的真實值y,從而使得我們所訓練的假設函數缺乏泛化到新數據樣本能力。 怎樣解決過擬合 過擬合會在變量過多同時過少的訓練時發生

Python之嶺回歸

ict port randn mod alpha near python .com auth 實現:# -*- coding: UTF-8 -*-import numpy as npfrom sklearn.linear_model import Ridge__author

通俗易懂--嶺迴歸(L2)、lasso迴歸(L1)、ElasticNet講解(演算法+案例)

1.L2正則化(嶺迴歸) 1.1問題 想要理解什麼是正則化,首先我們先來了解上圖的方程式。當訓練的特徵和資料很少時,往往會造成欠擬合的情況,對應的是左邊的座標;而我們想要達到的目的往往是中間的座標,適當的特徵和資料用來訓練;但往往現實生活中影響結果的因素是很多的,也就是說會有很多個特徵值,所以訓練模型

向量、矩陣乘法的幾何意義(二) 矩陣乘法(Matrix Multiplication)

一、旋轉(rotation) 1、矩陣與向量相乘 由向量內積(兩個向量相乘)出發,考慮矩陣與向量相乘的情況。以二維平面空間為例,設X=(x1, x2, …, xn), xi=(xi1,xi2)T, i=1, 2, …,n為樣本矩陣,w=(w1,w2)T為向量(二維平面中的一個

機器學習之線性代數基礎一 矩陣乘法、秩、特徵值、特徵向量的幾何意義

寫篇文章把自己對矩陣的理解記錄一下,有不對的地方歡迎指正。為簡單、直觀、視覺化起見,我們只以簡單的二維和三維空間為例。高維空間也是同樣的道理,只是不能視覺化,只能通過數學公式來證明。 1. 矩陣乘法 矩陣乘法來源於線性方程組的求解,為了方便起見,

極大既然估計和高斯分布推導最小二乘、LASSO、Ridge回歸

baidu 器) ridge 連續概率 重要 eal 函數 應用 map 最小二乘法可以從Cost/Loss function角度去想,這是統計(機器)學習裏面一個重要概念,一般建立模型就是讓loss function最小,而最小二乘法可以認為是 loss function

先驗概率、後驗概率、似然函數與機器學習中概率模型(如邏輯回歸)的關系理解

集中 並且 結果 概率論 但我 evidence logs 硬幣 之前 看了好多書籍和博客,講先驗後驗、貝葉斯公式、兩大學派、概率模型、或是邏輯回歸,講的一個比一個清楚 ,但是聯系起來卻理解不能 基本概念如下 先驗概率:一個事件發生的概率 \[P(y)\] 後驗概