多標籤分類的結果評估---macro-average和micro-average介紹

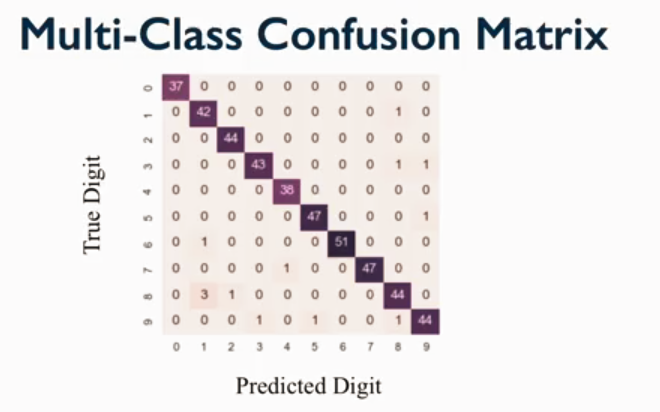

一,多分類的混淆矩陣

多分類混淆矩陣是二分類混淆矩陣的擴充套件

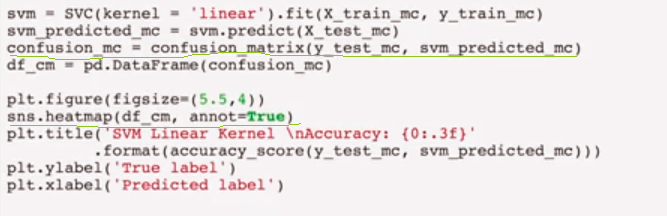

祭出程式碼,畫線的那兩行就是關鍵啦:

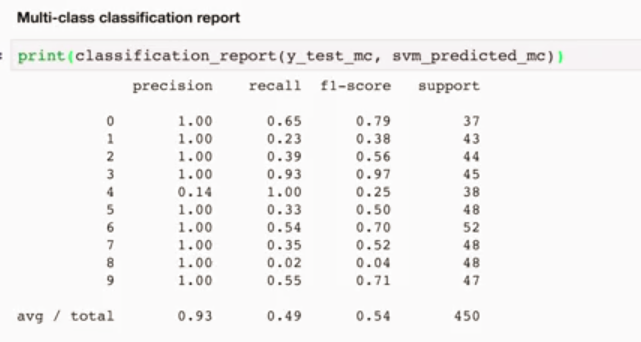

二,檢視多分類的評估報告

祭出程式碼,使用了classicfication_report()

三,巨集平均與微平均

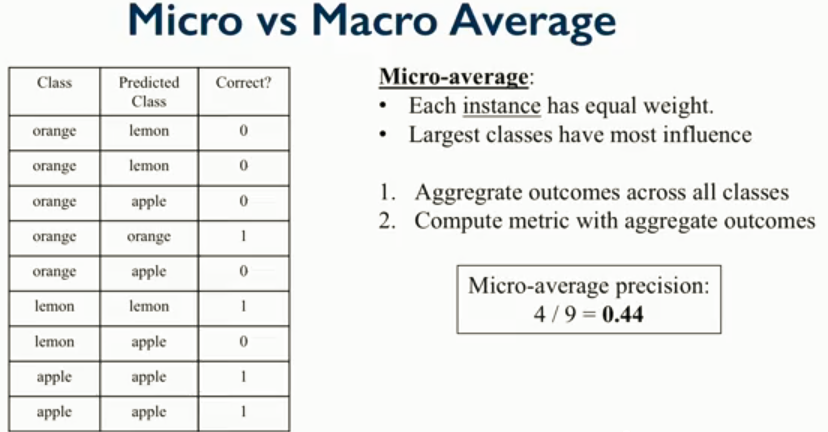

公式是神看的,我是學弱...直接看例子,沒有複雜的公式:

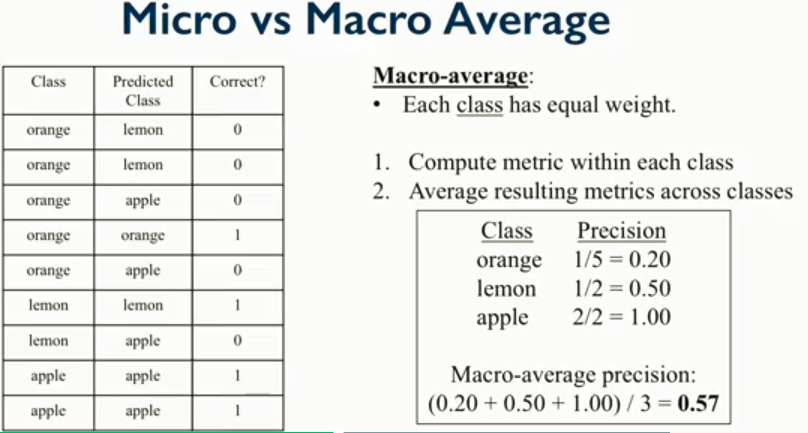

巨集平均

微平均

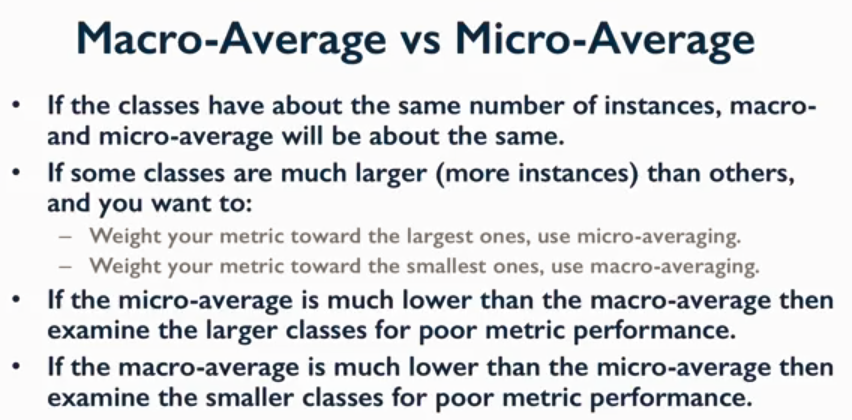

巨集平均和微平均的對比

- 如果每個class的樣本數量差不多,那麼巨集平均和微平均沒有太大差異

- 如果每個class的樣本數量差異很大,而且你想:

- 更注重樣本量多的class:使用巨集平均

- 更注重樣本量少的class:使用微平均

- 如果微平均大大低於巨集平均,檢查樣本量多的class

- 如果巨集平均大大低於微平均,檢查樣本量少的class

程式碼如何實現微平均和巨集平均

傳引數指定即可..sklearn真的很強大.

相關推薦

多標籤分類的結果評估---macro-average和micro-average介紹

一,多分類的混淆矩陣 多分類混淆矩陣是二分類混淆矩陣的擴充套件 祭出程式碼,畫線的那兩行就是關鍵啦: 二,檢視多分類的評估報告 祭出程式碼,使用了classicfication_report() 三,巨集平均與微平均 公式是神看的,我是學弱...直接看例子,沒有複雜的公

基於keras實現多標籤分類(multi-label classification)

首先討論多標籤分類資料集(以及如何快速構建自己的資料集)。 之後簡要討論SmallerVGGNet,我們將實現的Keras神經網路架構,並用於多標籤分類。 然後我們將實施SmallerVGGNet並使用我們的多標籤分類資料集對其進行訓練。 最後,我們將通過在示例影象上測試我

多標籤分類(multi-label classification)

意義 網路新聞往往含有豐富的語義,一篇文章既可以屬於“經濟”也可以屬於“文化”。給網路新聞打多標籤可以更好地反應文章的真實意義,方便日後的分類和使用。 難點 (1)類標數量不確定,有些樣本可能只有一個類標,有些樣本的類標可能高達幾十甚至上百個。

2.CNN圖片多標籤分類(基於TensorFlow實現驗證碼識別OCR)

上一篇實現了圖片CNN單標籤分類(貓狗圖片分類任務) 地址:juejin.im/post/5c0739… 預告:下一篇用LSTM+CTC實現不定長文字的OCR,本質上是一種不固定標籤個數的多標籤分類問題 本文所用到的10w驗證碼資料集百度網盤下載地址(也可使用下文程式碼自行生成): pan.baidu

針對科技文章的多標籤分類

0. 起 最近沒有更新。暑假之後學的東西也比較雜,看了一下基於DL的智慧美顏,感覺入了個大坑。前前後後看了傳統的輪廓提取演算法和FCN等等,調程式碼巴拉巴拉幾個星期就這麼過了。前幾天看ACM的best paper也覺得很有意思,兩個步驟:1)給圖片打標題,屬於多媒體計算和NLP的結合 2)由標題生成詩歌

caffe實現多標籤分類

最近在參加一個識別的競賽,專案裡涉及了許多類別的分類,原本打算一個大的類別訓練一個分類模型,但是這樣會比較麻煩,對於同一圖片的分類會重複計算分類網路中的卷積層,浪費計算時間和效率。後來發現現在深度學習中的多工學習可以實現多標籤分類,所有的類別只需要訓練一個分類模型就行,其不同屬性的類別之間是共享卷積層的。我

Extjs多標籤關閉,支援關閉左側和右側標籤。

基於官方給出標籤關閉方法修改,首先先上效果圖。 效果圖 /** * Plugin for adding a close context menu to tabs. Note that the menu respects * the closable confi

解決多標籤分類問題(包括案例研究)

由於某些原因,迴歸和分類問題總會引起機器學習領域的大部分關注。多標籤分類在資料科學中是一個比較令人頭疼的問題。在這篇文章中,我將給你一個直觀的解釋,說明什麼是多標籤分類,以及如何解決這個問題。 1.多標籤分類是什麼? 讓我們來看看下面的圖片。 如果我問你這幅圖中有一

來自語義資訊理論的多標籤分類方法——有簡單方法幹嘛要用複雜的?

流行的多標籤分類方法大多把多分類化為多個二分類。流行的有One-to-Rest方法和Binary Relevance方法。 One-to-Rest方法的問題是, 圍繞一個標籤y1分類, 把一個沒有y的例子當成y1的反例, 這時不對的。 比如兩個例子(25歲, “年輕人”)和

多標籤分類之改進的神經網路方法

Improved Multilabel Classification with Neural Networks 2008 International Conference on Parallel Problem Solving from Nature Rafa

keras 自定義ImageDataGenerator用於多標籤分類

感想 keras提供了flow_from_directory用於單個標籤分類,但是對圖片的多標籤分類沒有支援,這就需要我們自己動手實現ImageDataGenerator,我這裡把我實現的用於多標籤分類的自定義DataGenerator分享出來,讀者可以根據自己的情況來進行修改。 資料集

多標籤分類(multilabel classification )

為了區分多分類,先從基本的概念上開始: 二分類:投擲硬幣,結果是正面或者反面,可以選擇的類別只有兩個,並且確切的結果只能有一個,類別互斥,即一枚硬幣的投擲結果要麼是正面要麼是反面,不同同時出現 多分

keras解決多標籤分類問題

multi-class classification problem: 多分類問題是相對於二分類問題(典型的0-1分類)來說的,意思是類別總數超過兩個的分類問題,比如手寫數字識別mnist的label總數有10個,每一個樣本的標籤在這10箇中取一個。 mult

基於ML-KNN的多標籤分類演算法

最近有一個專案需要用多標籤分類思想來建模,之前對這塊不是太瞭解,查了一些論文,發現目前主流的演算法包括ML-KNN、ML-DT、Rank-SVM、CML等,其中ML-KNN演算法思想最簡單,結合原始論文,本文大概介紹下演算法思想和程式碼實現。 ML-KNN

Caffe 實現多標籤分類 支援Multi-Label的LMDB資料格式輸入

Caffe自帶的影象轉LMDB介面只支援單label,對於多label的任務,可以使用HDF5的格式,也可以通過修改caffe程式碼來實現, 我的文章Caffe 實現多標籤分類 裡介紹了怎麼通過修改ImageDataLayer來實現Multilabel的任務, 本篇文章介紹

Caffe 實現多標籤分類

最近在用Caffe做驗證碼識別時,發現沒有用Tensorflow簡單(tensorflow中可以用one-hot, 參考我的另一篇blog: http://blog.csdn.net/sushiqian/article/details/78305340 ),需要修改Caf

NLP文字多標籤分類---HierarchicalAttentionNetwork

最近一直在做多標籤分類任務,學習了一種層次注意力模型,基本結構如下: 簡單說,就是兩層attention機制,一層基於詞,一層基於句。 首先是詞層面: 輸入採用word2vec形成基本語料向量後,採用雙向GRU抽特徵: 一句話中的詞對於當前分類的重要性不同,採用attention機制實現如下:

TensorFlow 之基於Inception V3的多標籤分類 retrain

一、準備訓練資料 1.下載資料集 本文采用南京大學開源的資料集(點選下載:http://lamda.nju.edu.cn/files/miml-image-data.rar) 資料集中含有2000張影象,5個類,分別為 desert, mounta

關於Multi-label Classification 多標籤分類的問題

多分類: 訓練集中每個樣本只有一個標籤,該標籤來自於一個不重合的標籤集合L,|L| > 1。 當|L|=2 時,這是一個二分類問題。當|L| > 2 時,這是一個多分類問題。 單標籤與多標籤: 多標籤: 令為訓練樣本集,為標籤集合,給定一組形式為

caffe多工學習之多標籤分類

最近在參加一個識別的競賽,專案裡涉及了許多類別的分類,原本打算一個大的類別訓練一個分類模型,但是這樣會比較麻煩,對於同一圖片的分類會重複計算分類網路中的卷積層,浪費計算時間和效率。後來發現現在深度學習中的多工學習可以實現