用basicTrendline畫一元線性迴歸直線的置信區間

感慨統計學都還給老師了。。惡補!

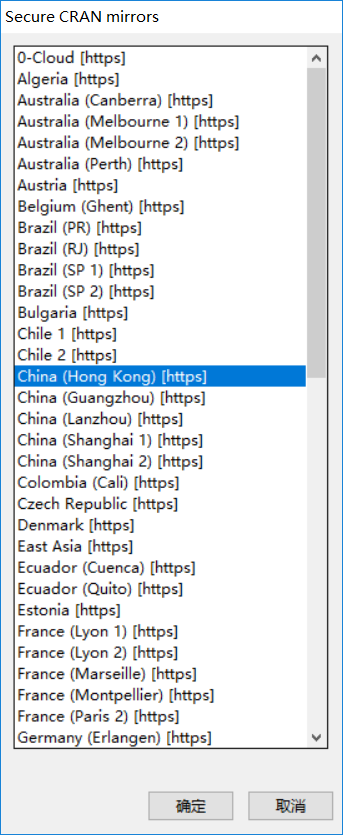

R安裝包的時候貌似需要用管理員許可權啟動,否則安裝不了,國內映象卡得渣渣,還是國外映象真香~選擇hongkong就好了。

install.packages("basicTrendline")

library(basicTrendline)

x1<-c(XXXXXXX)

y1<-c(XXXXXXX)

trendline(x1, y1, model="line2P", ePos.x = "topleft", summary=TRUE, eDigit=5)

相關推薦

用basicTrendline畫一元線性迴歸直線的置信區間

感慨統計學都還給老師了。。惡補! R安裝包的時候貌似需要用管理員許可權啟動,否則安裝不了,國內映象卡得渣渣,還是國外映象真香~選擇hongkong就好了。 install.packages("basicTrendline") library(basicTrendline) x1&l

機器學習之一元線性迴歸

概述 線性迴歸是利用數理統計中迴歸分析,來確定兩種或兩種以上變數間相互依賴的定量關係的一種統計分析方法,運用十分廣泛。其表達形式為y = w'x+e,e為誤差服從均值為0的正態分佈。 迴歸分析中,只包括一個自變數和一個因變數,且二者的關係可用一條直線近似表示,這種迴歸分析稱為一元線性迴歸分析。 如果迴歸分析

一元線性迴歸-python

思路: 1、從0~10,生成等間距20個數作為x, 2、利用迴歸公式 y=5 + 2x + 3、計算y值 4、對資料進行估計 #生成從0到10之間選20個等間距的數 import numpy as np import matplotlib.pyplot as pl

Python_一元線性迴歸及迴歸顯著性

1、資料準備 資料來源自《應用迴歸分析》(第四版) ## 火災損失表 ### 距離消防站km x = [3.4, 1.8, 4.6, 2.3, 3.1, 5.5, 0.7, 3.0, 2.6, 4.

【機器學習筆記01】最小二乘法(一元線性迴歸模型)

【參考資料】 【1】《概率論與數理統計》 【2】 http://scikit-learn.org /stable/auto_examples/ linear_model/ plot_ols.html # sphx-glr-auto-examples-

機器學習--線性迴歸1(一元線性迴歸、多元線性迴歸,誤差性質)

前面幾節都是監督學習方面的演算法,監督學習是指有目標變數或預測目標的機器學習方法,迴歸與分類的不同,就在於其目標變數是連續數值型,而分類的目標變數是標稱型資料,其實前面的Logistic迴歸就是迴歸的一種,他們的處理方法大同小異,在這裡系統的講解一下回歸的來龍去脈,理解影響迴

一元線性迴歸VS多元線性迴歸

一元線性迴歸和多元線性迴歸表面意思容易理解,但是結合實際的資料集,會混亂。這也是在編寫線性迴歸博文的時候梳理知識點發現自己的不足,同時記錄下來,讓有疑問的同學也可以得到答案,撥開烏雲。 1

一元線性迴歸模型與最小二乘法及其C++實現

監督學習中,如果預測的變數是離散的,我們稱其為分類(如決策樹,支援向量機等),如果預測的變數是連續的,我們稱其為迴歸。迴歸分析中,如果只包括一個自變數和一個因變數,且二者的關係可用一條直線近似表示,這種迴歸分析稱為一元線性迴歸分析。如果迴歸分

python實現一元線性迴歸

最近在看中長期水文預報,打算使用python語言實現課本的模型並進行例項的計算結果的檢驗,為了監督自己和整理記錄自己實現的模型程式碼,打算寫部落格記錄自己的程式碼實現和部分思路。首先,自己不使用現成的模組實現的是一元線性迴歸模型,然後和模組實現對比,學習模組的呼叫。接下來是直接編寫的程式檔案,並計算

機器學習公開課筆記(1):機器學習簡介及一元線性迴歸

初步介紹 監督式學習: 給定資料集並且知道其正確的輸出應該是怎麼樣的,即有反饋(feedback),分為 迴歸 (Regressioin): map輸入到連續的輸出值。 分類 (Classification):map輸出到離散的輸出值。 非監督式學習: 給定資料集,並不知道其正確的輸出是什麼,

Tensorflow實現簡單的一元線性迴歸並儲存和載入模型

簡介:本文章以tensorflow為平臺建立了一個簡單的線性迴歸模型,並得到了不錯的效果。同時實現了模型的儲存與載入,當一個模型的訓練時間非常長的時候,利用模型的載入可以實現開啟程式時接著上次訓練。 平臺:Python 3.6 IDE:Pycharm 一、

[Python] 一元線性迴歸分析例項

本文通過一個簡單的例子:預測房價,來探討怎麼用python做一元線性迴歸分析。 1. 預測房價 房價是一個很火的話題,現在我們拿到一組資料,是房子的大小(平方英尺)和房價(美元)之間的對應關係,如下(csv資料檔案): No,square_feet,p

一元線性迴歸(原理)

前言: 一元線性迴歸是資料探勘的基礎模型,其中包含了非常重要的數學回歸的概念,是學習多元迴歸,廣義線性迴歸的基礎。本文主要講解1)基礎原理2)數學推導3)R語言演示,來介紹一元線性迴歸。 關鍵詞:一元線性迴歸基礎原理、最小二乘法、數學推導、R語言 整體思路: 根據已知點求一

用R進行多元線性迴歸分析建模

概念:多元迴歸分析預測法,是指通過對兩個或兩個以上的自變數與一個因變數的相關分析,建立預測模型進行預測的方法。當自變數與因變數之間存在線性關係時,稱為多元線性迴歸分析。 下面我就舉幾個例子來說明一下

一元線性迴歸的詳解及其Spss和Java的實現 之 理論說明

不要過於教條地對待研究的結果,尤其當資料的質量受到懷疑時。 本文主要對統計學中最常見的一元線性迴歸內容進行系統全面的講解,以及相應案例的Excel Spss 和Java的相關實現。 準備知識 : 對概率中隨機變數的期望、方差、協方差、和相關係數的定義、性質和

梯度下降法及一元線性迴歸的python實現

梯度下降法及一元線性迴歸的python實現 一、梯度下降法形象解釋 設想我們處在一座山的半山腰的位置,現在我們需要找到一條最快的下山路徑,請問應該怎麼走?根據生活經驗,我們會用一種十分貪心的策略,即在現在所處的位置上找到一個能夠保證我們下山最快的方向,然後向著該方向行走;每到一個新位置,重複地應用上述貪心

[ch04-03] 用神經網路解決線性迴歸問題

系列部落格,原文在筆者所維護的github上:https://aka.ms/beginnerAI, 點選star加星不要吝嗇,星越多筆者越努力。 4.3 神經網路法 在梯度下降法中,我們簡單講述了一下神經網路做線性擬合的原理,即: 初始化權重值 根據權重值放出一個解 根據均方差函式求誤差 誤差反向傳播給線性

機器學習3- 一元線性迴歸+Python實現

[toc] # 1. 線性模型 給定 $d$ 個屬性描述的示例 $\boldsymbol{x} = (x_1; x_2; ...; x_d)$,其中 $x_i$ 為 $\boldsymbol{x}$ 在第 $i$ 個屬性上的取值,**線性模型**(*linear model*)試圖學得一個通過屬性的線性組合

pytorch和tensorflow的愛恨情仇之一元線性迴歸例子(keras插足啦)

直接看程式碼: 一、tensorflow #tensorflow import tensorflow as tf import random import numpy as np x_data = np.random.randn(100).astype(np.float32) y_data = x_dat

《用Python玩轉資料》專案—線性迴歸分析入門之波士頓房價預測(二)

接上一部分,此篇將用tensorflow建立神經網路,對波士頓房價資料進行簡單建模預測。 二、使用tensorflow擬合boston房價datasets 1、資料處理依然利用sklearn來分訓練集和測試集。 2、使用一層隱藏層的簡單網路,試下來用當前這組超引數收斂較快,準確率也可以。 3、啟用函式