線性模型,線性迴歸,對數機率迴歸(Logistic regression)的理解與推導(深度學習前戲( ╯□╰ ))

對數機率迴歸(logistic regression),有時候會譯為邏輯迴歸(音譯),其實是我們把迴歸模型應用到分類問題時,線性迴歸的一種變形,主要是針對二分類提出的。既然是線性迴歸的一種變形,那麼在理解對數機率迴歸時,我們先來了解一下什麼是線性迴歸。

1.線性迴歸

1. 1線性方程

形如

我們稱為線性方程,即任何變數都是一次冪的函式,向量形式一般寫成:

不難看到如果我們將其中的

與

學習得到之後,我們就得到了一個固定的線性模型,這個模型對應了某些量之間的一種對映,可以拿來作為預測。線性模型形式簡單但是卻蘊含著機器學習中一些重要的基本思想。許多功能更為強大的非線性模型都是從線性模型的基礎上通過引入層級結構或者高維對映得到的。此外,如果我們仔細分析的話,可以發現

其實是每個變數對這個模型重要程度(即權重)的集合,使得線性模型有很好的可解釋性。

1. 2線性迴歸

線性迴歸本質就是預測一個連續的輸出,即根據我們手頭上擁有的資料集

其中

學習到一組w與b,使得這個模型能夠儘可能準確地預測實值輸出標記。

那麼如何準確的去學習出這組

與

呢?

我們先考慮一種最簡單的情況那就是隻有一個輸入

,所以學習的結果其實就是使

,我們知道均方誤差使迴歸任務中最常用的效能度量,因此我們只要找到使得兩者均方誤差最小的那組

與

,我們就得到了相對預測最準確的模型。

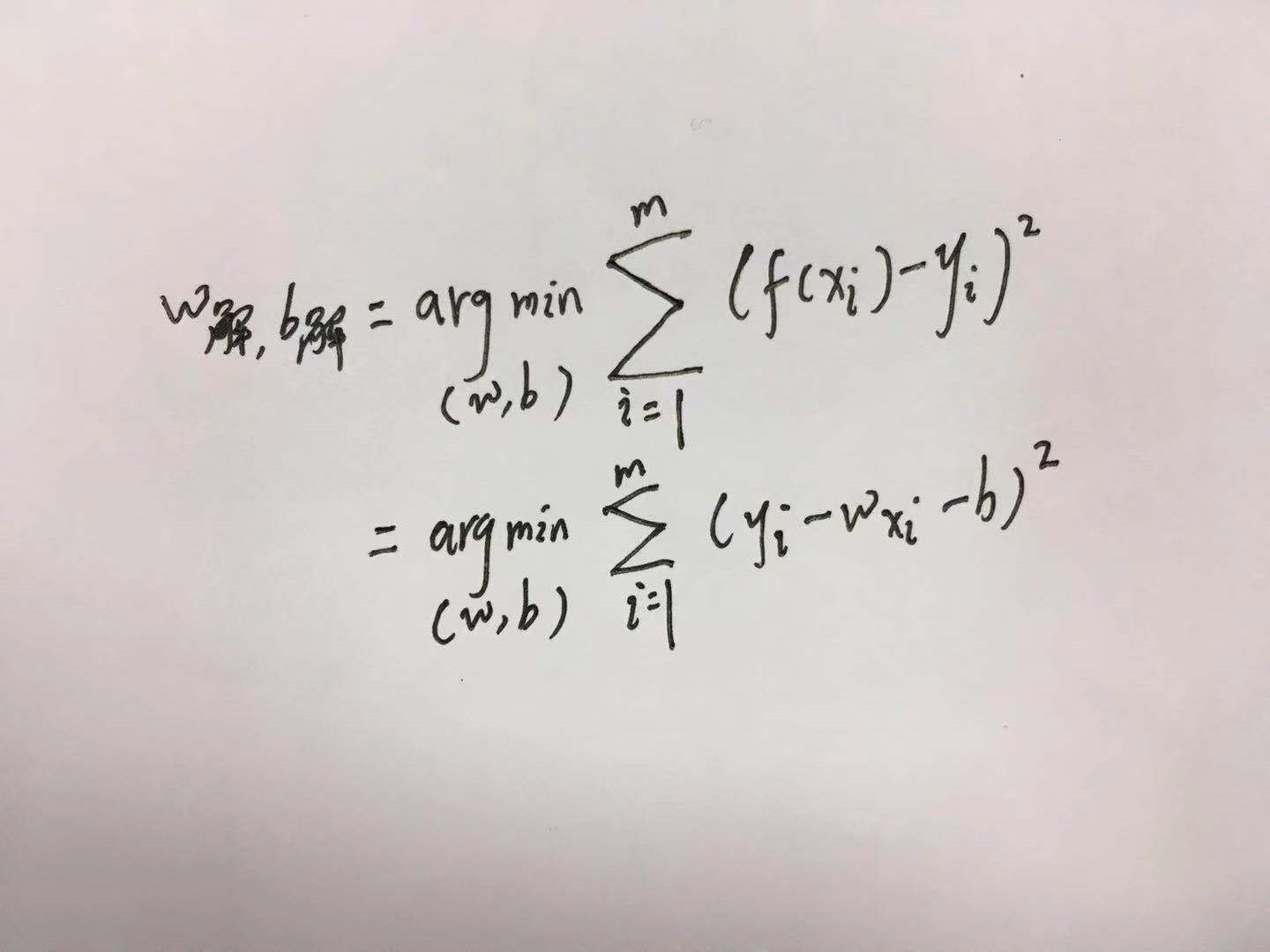

均方誤差最小,即:

這種基於均方誤差最小化來進行線性模型求解的方法稱為”最小二乘法”(least square method),線性迴歸中最小二乘法就是找到一條直線,使得所有樣本到直線上的歐氏距離最小。

這個求解過程也被稱為線性迴歸的最小二乘引數估計。

我們知道形如

函式通常是凸函式,且極值點在導數為0時取得。

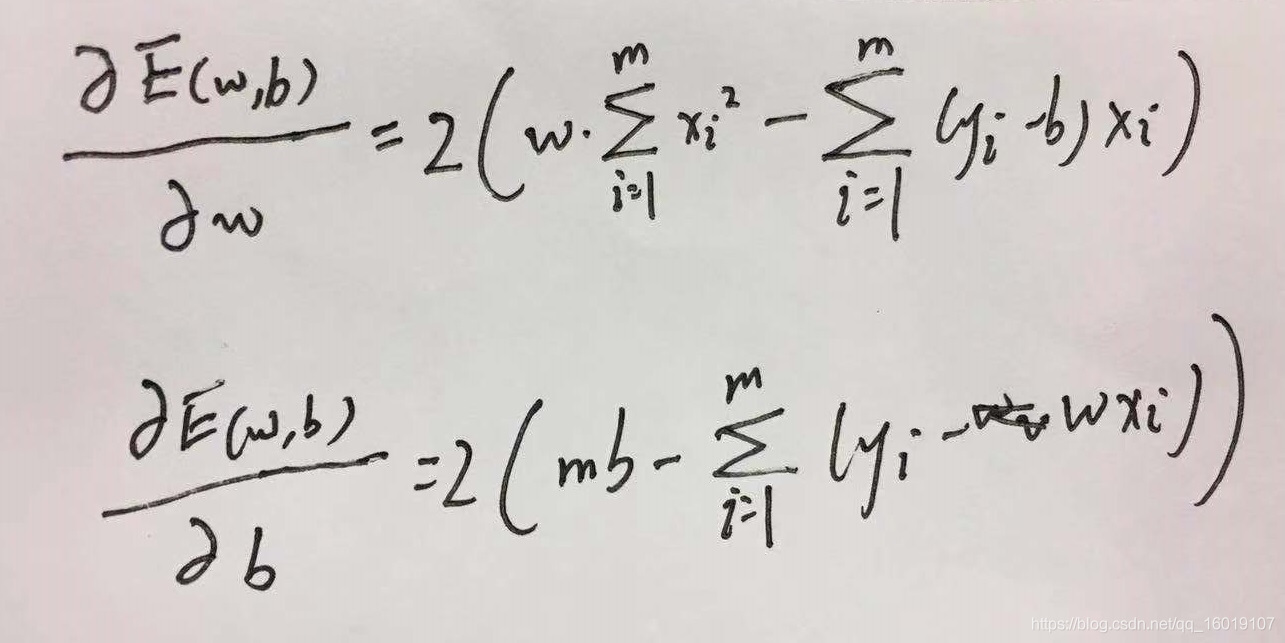

於是我們分別對

與

求導得到:

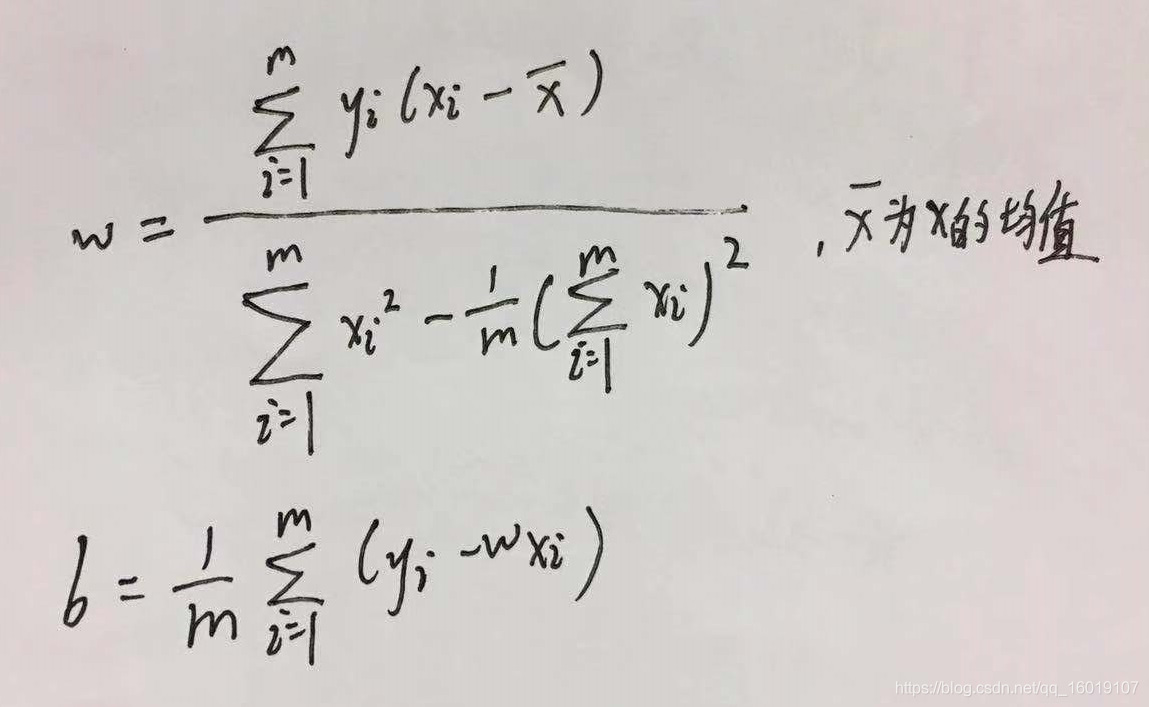

令二式均為0就可以得到w與b最優解的閉式解:

這裡可以提一下什麼是閉式解,閉式解其實就是解析解,與數值解相對應,最籠統的解釋解析解就是嚴格按照公式推匯出來的解,而數值解是按照特定條件近似計算得到的基本滿足的數值,逼近解析解,但是正確性沒有解析解來的好。

那麼當我們的輸入是多個變數的時候該怎麼辦呢。

其實就是把

與

向量化,即我們試圖學得

,使得

,這就是多元線性迴歸

我們同樣利用最小二乘法對

與

進行估計。我們將