PoseTrack: Joint Multi-Person Pose Estimation and Tracking

阿新 • • 發佈:2018-12-02

介紹

文章指出現有的方法不能直接解決posetrack問題,因為這個問題包括兩個問題,一個pose估計,一個是track

本文提出一個新穎的方法和一個數據集劍指同時解決這個兩個子問題,方法有幾個關鍵點

- 用一個時空graph,表達視訊中姿態估計

- 通過求解一個整數線性規劃問題(integer linear program)去把這個圖分割成子圖,每個子圖僅含有單個人的pose時空軌跡

- 這個問題還沒有定量的評價資料集,這文章提出一個PoseTrackDataset 資料集,這個資料集包含一個無約束的評價協議(沒有任何的,大小,尺寸,定位或者人數量的先驗假設,都是任意的)

方法

上圖可視化了本文的主要思路(bottom-up):

- 第一行是檢測到的候選關節點,使用的是Deepcut(ECCV16 pose估計,後面會去看這文章,看完加連線)

- 第二行是所建立的圖,圖有兩種邊:一種是同一幀中不同種關節點的聯絡,分割結果是單幀中每個子圖中的節點都屬於同一個人;另外一種是兩幀之間同一種關節點的聯絡,分割結果是一個子圖僅包含視訊中同一個人的同一個關節點

- 圖分割結果

圖的邊權還有如何分割就不關注了,只能說為了讓邊權反映分割目標,設計非常複雜,填了一些坑(可能是看結果出現的一些分割規律,根據規律調整邊權設計,發現越多,調整的越多,顯得越複雜),下面只關注效果如何

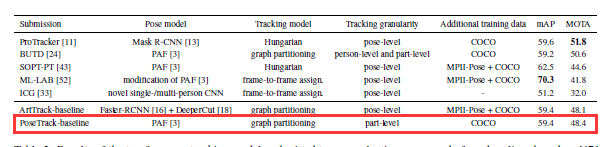

結果比較可以參考PoseTrackDataset 文章中的結果

dataset文章出來時,這文章的結果已經不是state-of-art了,部分工作比它稍好一點點,現在(18年底)的話有微軟的Simple Baselines for Human Pose Estimation and Tracking,還有別的工作,取得的mAP和MOTA都比這個優秀很多

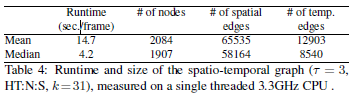

時效性,主要分析這個graph cut,因為圖割是序列程式,無法用gpu加速,測試用3.3GHz CPU: