邏輯迴歸損失函式

阿新 • • 發佈:2018-12-07

二分類

眾所周知,二分類問題的損失函式為:

其中y代表標籤值(0,1);h(θ,x)代表通過假設假設函式(sigmoid 函式)計算出的函式值(概率),sigmoid 函式的取值區間為(0,1)

當標籤值為1時,h(θ,x)的值為預測y為1的概率,這個值越靠近0,logh(θ,x)的值就會越大,從而對loss值的懲罰也就越大;反之當標籤值為0時,1-h(θ,x)的值為預測y為0的概率,這個值越靠近0,log(1-h(θ,x))的值就會越大。

二分類問題的決策函式為:

![]()

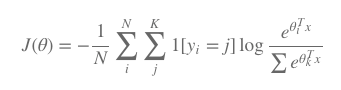

多分類(softmax)

二分類問題也可以看做是多分類問題的特例,由此,K分類問題的loss函式表示式也可以延伸為:

多分類問題(softmax)的決策函式為:

![]()

(與二分類函式的決策函式比較,二分類函式的決策函式依然可以視為K分類問題的特例)

總結

由此不難看出,在keras裡面activation選擇sigmoid的時候,與之對應的loss為binary_crossentropy;同理,activation選擇softmax的時候,與之對應的loss為categorical_crossentropy

參考資料