Logistic迴歸拓展到多分類

Logistic多分類

轉載註明出處:https://blog.csdn.net/ouyangfushu/article/details/84797493

作者:SyGoing

QQ: 244679942

1、概率模型

邏輯斯蒂迴歸本來是用於多分類,改變其概率模型函式則可將其拓展到多分類(class num>2)問題。原始邏輯斯蒂迴歸模型如下(來源為之前的邏輯斯蒂迴歸模型文章):

![]()

其中,

![]()

邏輯斯蒂多分類則改寫為:

![]()

![]()

公式中可以看出,現在要對K個類別進行分類,若K=2則變為二分類問題的公式。K>2則為多分類, 前K-1個類別表示式為式1表示式,最後一類則為1-式1所得。需要學習的權值向量總共有k-1個。不禁讓人想起softmax,但觀察可知多項邏輯斯蒂迴歸模型和softmax還是有區別的,softmax需要的學習的權值向量個數與類別數目相等。

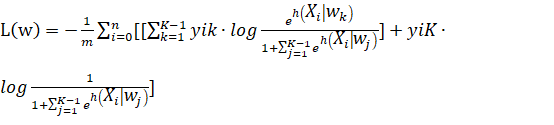

2、損失函式推導

多項邏輯斯蒂迴歸模型的推導,同樣可以採用極大似然估計進行建模,標籤需要進行one-hot編碼。寫出樣本集的似然函式:

將概率模型帶入似然函式並取對數:

其中上標i表示第i個樣本,yik表示樣本i在第k類的標籤,如果樣本不屬於該類則yik=0,否則yik=1;![]() 表示樣本i屬於k類的概率。

表示樣本i屬於k類的概率。

優化要求極大似然函式最大,等式右邊取負號則變成最小化目標函式。假設其最小值為極值,則對損失函式求偏導,並令其等於零則可求得權值的梯度值。

PS:這公式不忍直視,但是不覺得噁心的時候就能耐心的推導完畢