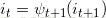

HMM維特比演算法

阿新 • • 發佈:2018-12-13

維特比演算法

利用動態規劃求解概率最大的路徑,一條路徑一個狀態序列。

動態規劃求解最優路徑專責:如果最優路徑在某時刻t 通過節點i,那麼這條路徑從節點 i 到終點的部分路徑,在節點 i 到終點的路徑中,必須是最優的。

通過這種原理就可以從t=1時刻開始,不斷向後遞推到下一個狀態的路徑的最大概率,直到在最後到達最終的最優路徑終點,然後依據終點回溯到起始點,這樣就能得到最優路徑。

具體過程:(《李航統計學習》)

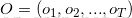

輸入:模型引數λ和觀測序列

輸出:最優的隱狀態路徑

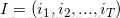

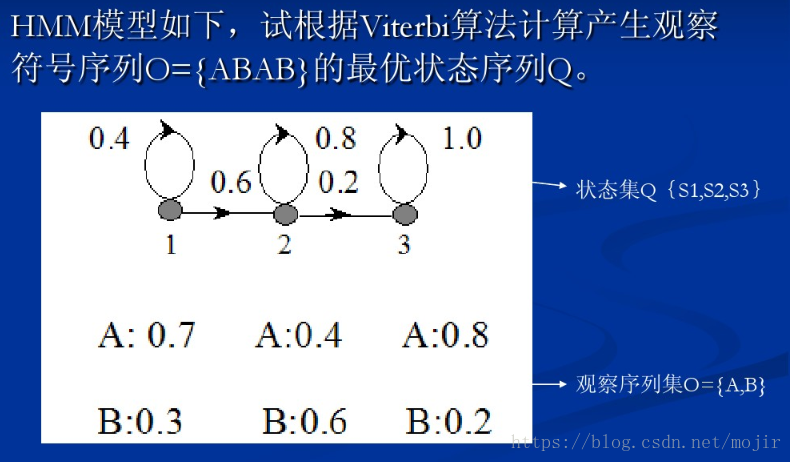

(1) 第一層所有的N中狀態概率

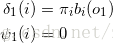

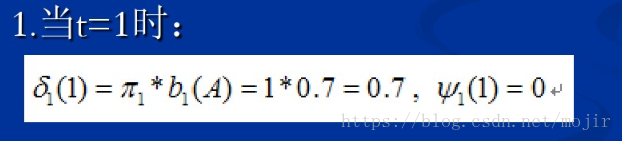

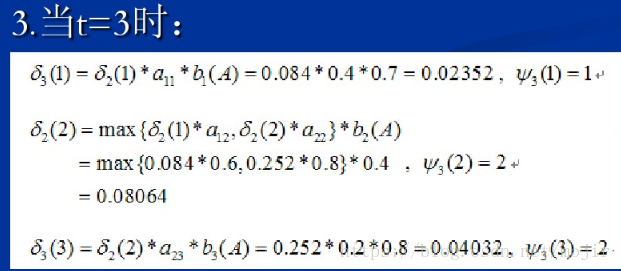

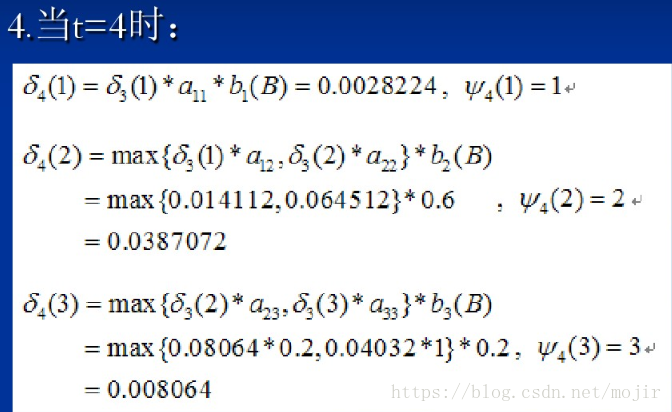

(2) 逐漸遞推到t=2,3,...,.T

第一個式子是記錄遞推到 t 時刻時候,最優路徑經過的所有結點的聯合概率。

第二個式子是記錄到底到達的是哪個節點,即 t 時刻的哪個隱狀態

其實這一步說白了計算時間和前向計算差不多,只不過把前向計算的狀態加和換成了取max值

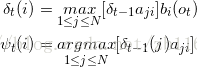

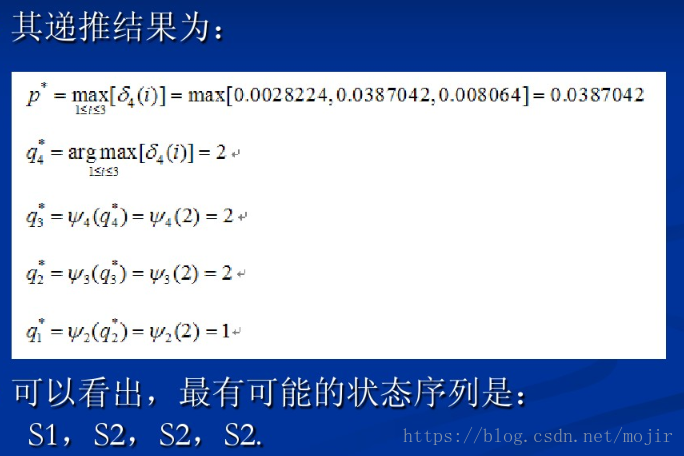

(3) 終止

(4) 回溯最優路徑,t= T-1,T-2,...,1

舉個栗子

解題過程:

原文有修改,原文點選:https://blog.csdn.net/zb1165048017/article/details/48578183?utm_source=copy