構建深度學習網路的實用技巧

作者| Matt H/Daniel R

譯者| 婉清

編輯| Jane

出品| AI 科技大本營

【導讀】在經歷成千上萬個小時機器學習訓練時間後,計算機並不是唯一學到很多東西的角色,作為開發者和訓練者的我們也犯了很多錯誤,修復了許多錯誤,從而積累了很多經驗。在本文中,作者基於自己的經驗(主要基於 TensorFlow)提出了一些訓練神經網路的建議,還結合了案例,可以說是過來人的實踐技巧了。

通用技巧

有些技巧對你來說可能就是明擺著的事,但在某些時候可能卻並非如此,也可能存在不適用的情況,甚至對你的特定任務來說,可能不是一個好的技巧,所以使用時需要務必要謹慎!

▌使用 ADAM 優化器

確實很有效。與更傳統的優化器相比,如 Vanilla 梯度下降法,我們更喜歡用ADAM優化器。用 TensorFlow 時要注意:如果儲存和恢復模型權重,請記住在設定完AdamOptimizer 後設置 Saver,因為 ADAM 也有需要恢復的狀態(即每個權重的學習率)。

▌ReLU 是最好的非線性(啟用函式)

就好比 Sublime 是最好的文字編輯器一樣。ReLU 快速、簡單,而且,令人驚訝的是,它們工作時,不會發生梯度遞減的情況。雖然 sigmoid 是常見的啟用函式之一,但它並不能很好地在 DNN 進行傳播梯度。

▌不要在輸出層使用啟用函式

這應該是顯而易見的道理,但如果使用共享函式構建每個層,那就很容易犯這樣的錯誤:所以請確保在輸出層不要使用啟用函式。

▌請在每一個層新增一個偏差

這是 ML 的入門知識了:偏差本質上就是將平面轉換到最佳擬合位置。在 y=mx+b 中,b 是偏差,允許曲線上下移動到“最佳擬合”位置。

▌使用方差縮放(variance-scaled)初始化

在 Tensorflow 中,這看起來像tf.reemaner.variance_scaling_initializer()。根據我們的經驗,這比常規的高斯函式、截尾正態分佈(truncated normal)和 Xavier 能更好地泛化/縮放。

粗略地說,方差縮放初始化器根據每層的輸入或輸出數量(TensorFlow中的預設值是輸入數量)調整初始隨機權重的方差,從而有助於訊號更深入地傳播到網路中,而無須額外的裁剪或批量歸一化(batch normalization)。Xavier 與此相似,只是各層的方差幾乎相同;但是不同層形狀變化很大的網路(在卷積網路中很常見)可能不能很好地處理每層中的相同方差。

▌歸一化輸入資料

對於訓練,減去資料集的均值,然後除以它的標準差。在每個方向的權重越少,你的網路就越容易學習。保持輸入資料以均值為中心且方差恆定有助於實現這一點。你還必須對每個測試輸入執行相同的規範化,因此請確保你的訓練集與真實資料相似。

以合理保留其動態範圍的方式縮放輸入資料。這與歸一化有關,但應該在歸一化之前就進行。例如,真實世界範圍為 [0,140000000] 的資料 x 通常可以用 tanh(x) 或 tanh(x/C) 來控制,其中 C 是一些常數,它可以拉伸曲線,以適應 tanh 函式緩坡部分的動態範圍內的更多輸入範圍。特別是在輸入資料在一端或兩端可能不受限制的情況下,神經網路將在(0,1)之間學習得更好。

▌一般不用學習率衰減

學習率衰減在 SGD 中更為常見,但 ADAM 很自然地處理了這個問題。如果你真的想把每一分表現都擠出去:在訓練結束時短時間內降低學習率;你可能會看到突然的、非常小的誤差下降,然後它會再次變平。

如果你的卷積層有 64 或 128 個過濾器,那就足夠了。特別是一個對於深度網路而言。比如,128 個真的就已經很多了。如果你已經有了大量的過濾器,那麼再新增更多的過濾器未必會進一步提高效能。

▌池化用於平移不變性

池化本質上就是讓網路學習影象“那部分”的“總體思路”。例如,最大池化可以幫助卷積網路對影象中的特徵的平移、旋轉和縮放變得更加健壯。

除錯神經網路

如果你的網路沒能很好地進行學習(指在訓練過程中損失/準確率沒有收斂,或者沒有得到預期的結果),那麼可以試試以下的技巧:

▌過擬合

如果你的網路沒有學習,那麼首先要做的第一件事就是對訓練點進行過擬合。準確率基本上應為 100% 或 99.99%,或誤差接近 0。如果你的神經網路不能對單個數據點進行過擬合,那麼體系架構就可能有嚴重的問題,但這可能是微妙的。如果你可以對一個數據點進行過擬合,但是對較大的集合進行訓練仍然無法收斂,請嘗試以下建議:

▌降低學習率

你的網路學習就會變得更慢一些,但是它可能會找到以前無法進入的最小化的方式,因為它的步長太大了。

▌提高學習率

這樣做將會加快訓練,有助於收緊反饋,這意味著無論你的網路是否正常工作,你都會很快地知道你的網路是否有效。雖然網路應該更快地收斂,但其結果可能不會很好,而且“收斂”實際上可能會跳來跳去。(對於 ADAM 優化器,我們發現在很多經歷中,學習率大約為 0.001 時,表現很不錯。)

▌減少批量處理規模

將批處理大小減小到 1,可以為你提供與權重更新相關的更細粒度的反饋,你應該使用TensorBoard(或其他一些除錯/視覺化工具)展示出來。

▌刪除批歸一化層

隨著批處理大小減少到 1,這樣做會暴露出梯度消失或梯度爆炸的問題。我們曾有過一個網路,在好幾周都沒有收斂,當我們刪除了批歸一化層之後,我們才意識到第二次迭代時輸出都是 NaN。就像是創可貼上的吸水墊,它也有它可以發揮效果的地方,但前提是你知道網路沒有 Bug。

▌增加批量處理的規模

一個更大的批處理規模,如果可以的話,整個訓練集減少梯度更新中的方差,使每個迭代更準確。換句話說,權重更新將朝著正確的方向發展。但是!它的可用性和實體記憶體限制都有一個有效的上限。通常,我們發現這個建議不如上述兩個建議有用,可以將批處理規模減少到1並刪除批歸一化層。

▌檢查你的重構

大幅度的矩陣重構(如改變影象的X、Y 維度)會破壞空間區域性性,使網路更難學習,因為它也必須學會重塑。(自然特徵變得支離破碎。事實上,自然特徵在空間上呈區域性性,也是為什麼卷積神經網路能如此有效的原因!)如果使用多個影象/通道進行重塑,請特別小心;使用 numpi.stack()進行適當的對齊操作。

▌仔細檢查你的損失函式

如果使用一個複雜的函式,請嘗試將其簡化為 L1 或 L2。我們發現L1對異常值不那麼敏感,在發出噪聲的批或訓練點時,不會做出太大的調整。

如果可以的話,仔細檢查你的視覺化。你的視覺化庫(matplotlib、OpenCV等)是調整值的比例呢,還是它們進行裁剪?可考慮使用一種視覺上均勻的配色方案。

實戰分析

為了使上面所描述的過程更容易讓讀者理解,我們這兒有一些用於描述我們構建的卷積神經網路的真實迴歸實驗的損失圖(通過TesnorBoard)。

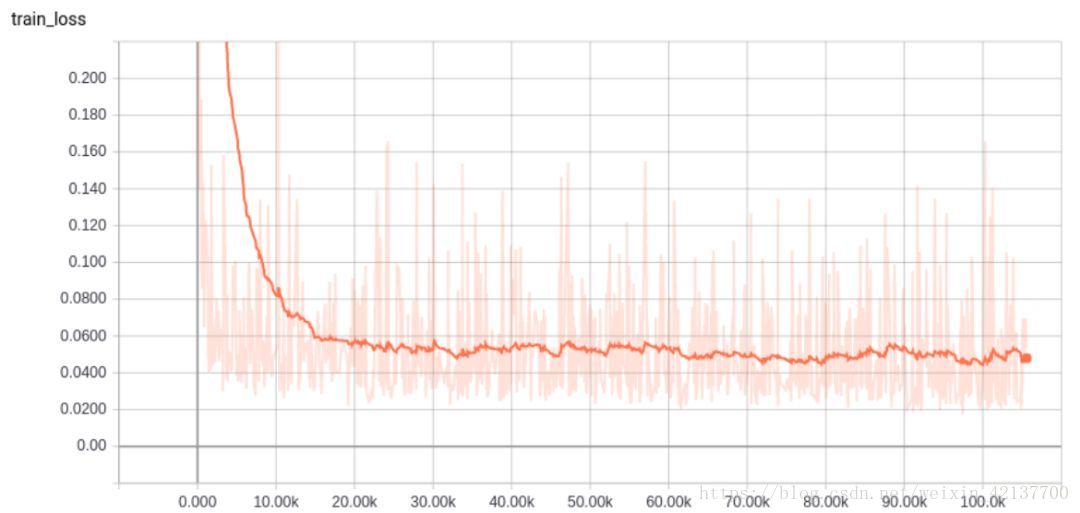

起初,這個網路根本沒有學習:

我們試圖裁剪這些值,以防止它們超出界限:

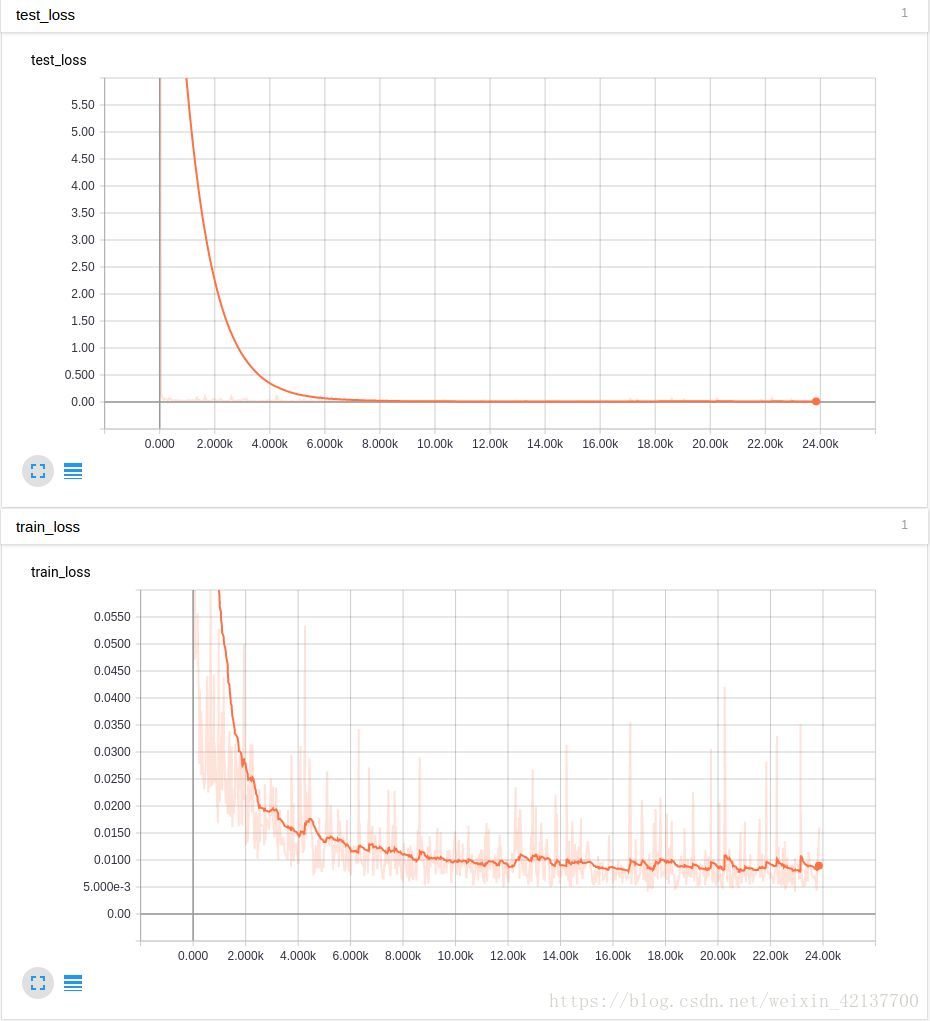

嗯。看看不平滑的值有多瘋狂啊!學習率是不是太高了?我們試著在一個輸入資料上降低學習率並進行訓練:

你可以看到學習率的前幾個變化發生的位置(大約在 300 步和 3000 步)。顯然,我們衰減得太快了。所以,給它更多的衰減時間,它表現得會更好:

你可以看到我們在 2000 步和 5000 步的時候衰減了。這樣更好一些了,但還不夠好,因為它沒有趨於 0。

然後我們禁用了 LR 衰減,並嘗試將值移動到更窄的範圍內,而不是通過 tanh 輸入。雖然這顯然使誤差值小於 1,但我們仍然不能對訓練集進行過擬合:

這裡我們發現,通過刪除批歸一化層,網路在一到兩次迭代之後迅速輸出 NaN。我們禁用了批歸一化,並將初始化更改為方差縮放。這些改變了一切!我們能夠對只有一兩個輸入的測試集進行過擬合了。當底部的圖示裁剪Y軸時,初始誤差值遠高於 5,表明誤差減少了近 4 個數量級:

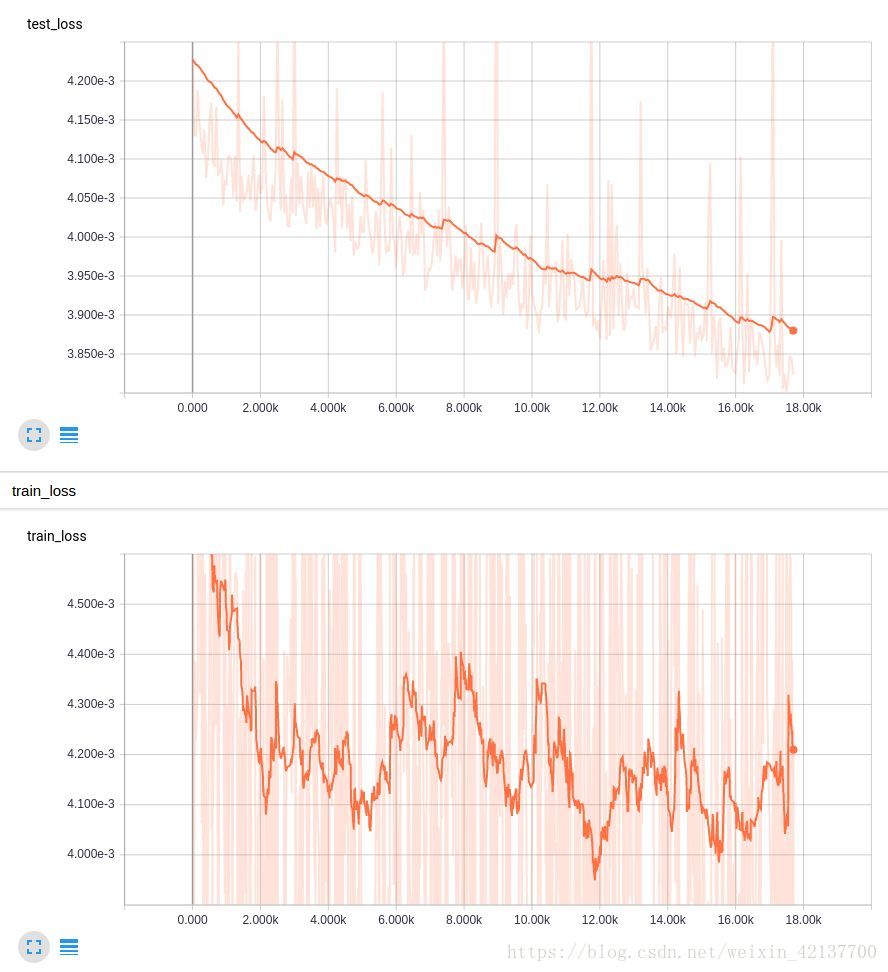

上面的圖表是非常平滑的,但是你可以看到它非常快地擬合了測試輸入,隨著時間的推移,整個訓練集的損失降低到了 0.01 以下。這沒有降低學習速度。然後我們將學習速率降低一個數量級後繼續訓練,得到更好的結果:

這些結果好得多了!但是,如果我們以幾何方式降低學習率,而不是將訓練分成兩部分,會發生什麼樣的結果呢?

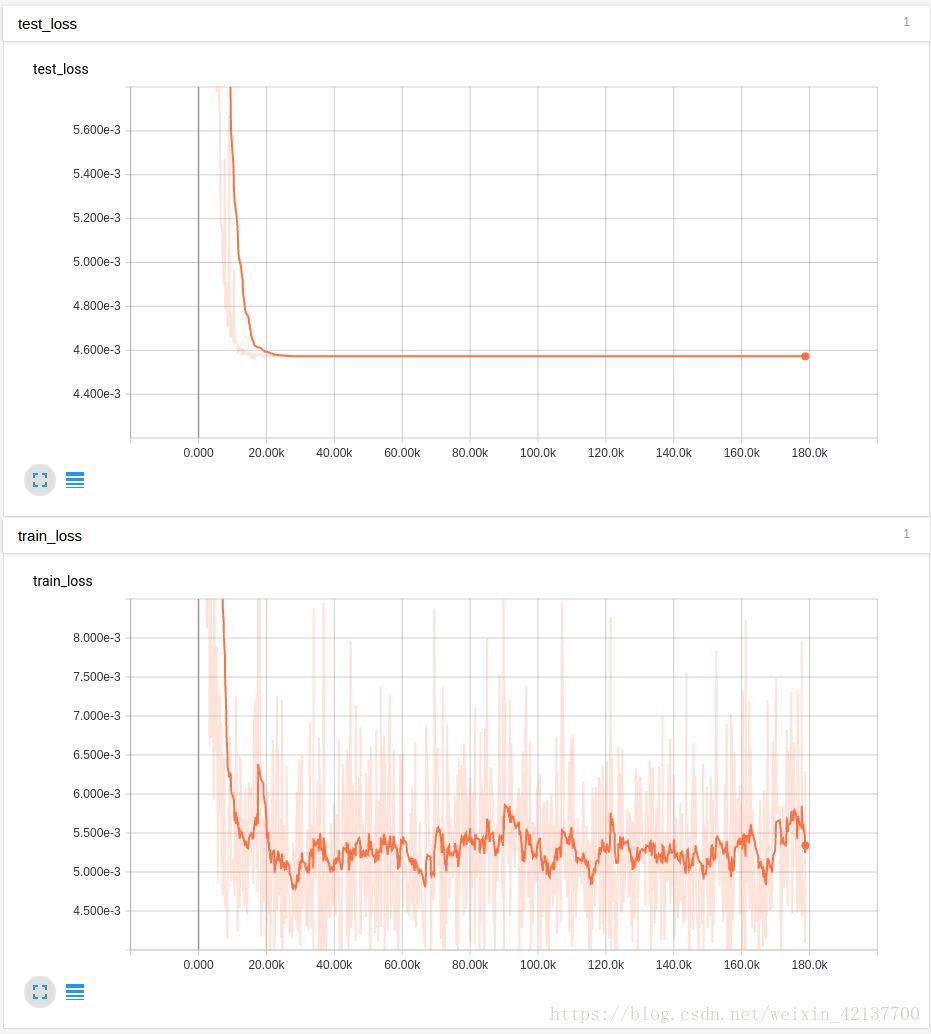

通過在每一步將學習率乘以 0.9995,結果就不那麼好了:

大概是因為學習率衰減太快了吧。乘數為 0.999995 會表現的更好,但結果幾乎相當於完全沒有衰減。我們從這個特定的實驗序列中得出結論,批歸一化隱藏了由槽糕的初始化引起的爆炸梯度,並且 ADAM 優化器對學習率的衰減並沒有什麼特別的幫助,與批歸一化一樣,裁剪值只是掩蓋了真正的問題。我們還通過 tanh 來控制高方差輸入值。