有關機器學習的梯度下降演算法

梯度下降演算法是一個一階最優化演算法,通常也稱為最速下降演算法。

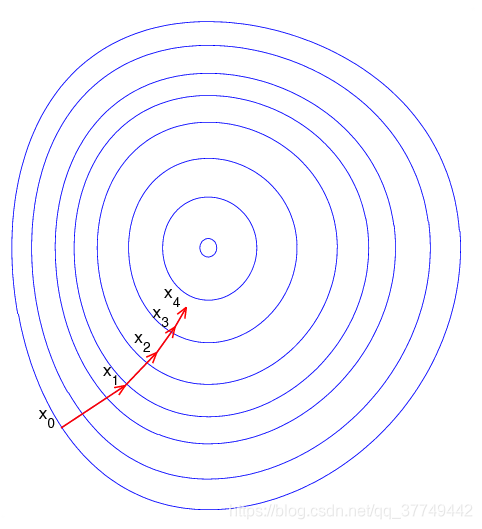

要使用梯度下降演算法尋找區域性最小值,必須向函式上當前點對應梯度的反方向進行迭代搜尋。相反地向函式正方向迭代搜尋,則會接近函式的區域性最大值,這個過程被稱為梯度上升法。 梯度下降演算法基於以下的觀察:如果實值函式F(x)在點a處可微且有定義,那麼函式F(x)在點a沿著梯度相反地方向-∇F(a)下降最快。

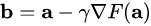

因而,如果

梯度下降演算法基於以下的觀察:如果實值函式F(x)在點a處可微且有定義,那麼函式F(x)在點a沿著梯度相反地方向-∇F(a)下降最快。

因而,如果

對於r>0為一個夠小數值時成立,那麼F(a)≥F(b)。

對於r>0為一個夠小數值時成立,那麼F(a)≥F(b)。

相關推薦

機器學習——梯度下降演算法

對機器學習感興趣,上網易公開課聽吳恩達得機器學習課程,第二堂課得梯度下降就不是特別懂 度娘一下,發現一篇部落格,閱之,毛瑟頓開,整理如下、 原博地址http://www.cnblogs.com/LeftNotEasy/archive/2010/12/05/mathmatic

[機器學習]—梯度下降法

隨機 如果 des 遞歸 數據 span .html aik 影響 機器學習中往往需要刻畫模型與真實值之間的誤差,即損失函數,通過最小化損失函數來獲得最優模型。這個最優化過程常使用梯度下降法完成。在求解損失函數的最小值時,可以通過梯度下降法來一步步的叠代求解,得到最小化的損

監督學習-梯度下降演算法

公式不太好上傳,所以就截圖了,效果不太好,大家想看原件,請下載:https://download.csdn.net/download/qq_24369689/10811686 監督學習-梯度下降演算法 如果你還沒有接觸過梯度下降演算法,你在看下面內容之前可以先看一下,吳恩達的梯度下降的視訊:

機器學習/梯度下降算法

valid 優點 這一 常量 路線 個數 分支 科學 component 當在現實生活中的遇到問題時,我們總是希望找到最佳的解決方案。制造軟件產品也是一樣的道理,最優化的程序才是最理想的產品。 最優化意味著獲得最佳輸出。它既是一個數學的重要分支,也在現實生活中有著重要的作

有關機器學習的梯度下降演算法

梯度下降演算法是一個一階最優化演算法,通常也稱為最速下降演算法。 要使用梯度下降演算法尋找區域性最小值,必須向函式上當前點對應梯度的反方向進行迭代搜尋。相反地向函式正方向迭代搜尋,則會接近函式的區域性最大值,這個過程被稱為梯度上升法。 梯度下降演算法基於以下的觀

斯坦福CS229機器學習課程筆記一:線性迴歸與梯度下降演算法

機器學習三要素 機器學習的三要素為:模型、策略、演算法。 模型:就是所要學習的條件概率分佈或決策函式。線性迴歸模型 策略:按照什麼樣的準則學習或選擇最優的模型。最小化均方誤差,即所謂的 least-squares(在spss裡線性迴歸對應的模組就叫OLS即Ordinary Least Squares):

吳恩達機器學習課程筆記02——處理房價預測問題(梯度下降演算法詳解)

建議記住的實用符號 符號 含義 m 樣本數目 x 輸入變數 y 輸出變數/目標變數

機器學習之--梯度下降演算法

貌似機器學習最繞不過去的演算法,是梯度下降演算法。這裡專門捋一下。 1. 什麼是梯度 有知乎大神已經解釋的很不錯,這裡轉載並稍作修改,加上自己的看法。先給出連結,畢竟轉載要說明出處嘛。為什麼梯度反方向是函式值區域性下降最快的方向? 因為高等數學都忘光了,先從導數/偏倒數/方向

從零開始機器學習002-梯度下降演算法

老師的課程 1.從零開始進行機器學習 2.機器學習數學基礎(根據學生需求不斷更新) 3.機器學習Python基礎 4.最適合程式設計師的方式學習TensorFlow 上節課講完線性迴歸的數學推導,我們這節課說下如何用機器學習的思想把最合適的權重引數求解出來呢?這

機器學習3 邏輯斯提回歸和梯度下降演算法

引言 上節我們介紹了很多線性迴歸模型,如何用線性模型做分類任務呢?是不是可以將線性迴歸模型的預測值和到分類任務的標記聯絡起來呢? 邏輯斯提回歸 對於一個二分類任務,輸出標記y為{0,1},而線性迴歸模型產生的預測值z為全體實數,我們想把z轉換成0/1值。我們首先想到是“單位階躍函式”。

機器學習之梯度下降演算法Gradient Descent

梯度下降演算法: 機器學習實現關鍵在於對引數的磨合,其中最關鍵的兩個數:代價函式J(θ),代價函式對θ的求導∂J/∂θj。 如果知道這兩個數,就能對引數進行磨合了:其中 α 為每步調整的幅度。 其中代價函式公式J(θ): 代價函式對θ的求導∂J/∂θj:

【機器學習】梯度下降演算法分析與簡述

梯度下降演算法分析與簡述 梯度下降(gradient descent)是一種最優化演算法,基於爬山法的搜尋策略,其原理簡單易懂,廣泛應用於機器學習和各種神經網路模型中。在吳恩達的神經網路課程中,梯度下降演算法是最先拿來教學的基礎演算法。 梯度下降演算法的

機器學習演算法篇:從為什麼梯度方向是函式變化率最快方向詳談梯度下降演算法

梯度下降法是機器學習中常用的引數優化演算法,使用起來也是十分方便!很多人都知道梯度方向便是函式值變化最快的方向,但是有認真的思考過梯度方向是什麼方向,梯度方向為什麼是函式值變化最快的方向這些問題嘛,本文便以解釋為什麼梯度方向是函式值變化最快方向為引子引出對梯度

機器學習金典演算法(二)--梯度下降法(2)

機器學習金典演算法(二)–梯度下降法 本人上篇博文梯度下降法(1)解釋了梯度下降法在機器學習中位置及思想,本文將繼續討論梯度下降法,梯度下降法存在的問題及改進思路,以及現有的幾種流行的變種梯度下降法。 目錄

機器學習筆記(一):梯度下降演算法,隨機梯度下降,正規方程

一、符號解釋 M 訓練樣本的數量 x 輸入變數,又稱特徵 y 輸出變數,又稱目標 (x, y) 訓練樣本,對應監督學習的輸入和輸出 表示第i組的x 表示第i組的y h(x)表示對應演算法的函式 是

python3__機器學習__神經網路基礎演算法__梯度下降演算法

1.概述 【說明】 梯度下降演算法(Gradient Descent Optimization)是神經網路模型訓練最常用的優化演算法(n緯問題求最優解,梯度下降是最常用的方法);對於深度學習模型,基本都是採用梯度下降演算法來進行優化訓練。 【場景假設】 一人被困山上

吳恩達機器學習 學習筆記 之 二 :代價函式和梯度下降演算法

二、 2-1 Model Representation 我們學習的第一個演算法是線性迴歸,接下來會講什麼樣的模型更重要,監督學習的過程是什麼樣子。 首先舉一個需要做預測的例子:住房價格上漲,預測房價,我們擁有某一城市的住房價格資料。基於這些資料,繪製圖形。 在已有房價資

【機器學習】梯度下降演算法及梯度優化演算法

用於評估機器學習模型的就是損失函式,我們訓練的目的基本上都是最小化損失,這個最小化的方式就要用優化演算法了,機器學習中最常用的就是梯度下降演算法。 導數、方向導數和梯度 要了解梯度下降演算法是什麼首要知道梯度是什麼,導數和方向導數又是瞭解梯度的前提。

《機器學習實戰》學習筆記(四)之Logistic(上)基礎理論及演算法推導、線性迴歸,梯度下降演算法

轉載請註明作者和出處:http://blog.csdn.net/john_bh/ 執行平臺: Windows Python版本: Python3.6 IDE: Sublime text3 一、概述 Logistic迴歸是統計學習中的經典

斯坦福-機器學習第一講(梯度下降演算法回顧總結)

在此將斯坦福-機器學習第一講(梯度下降演算法)做個詳細總結: 1.Linear regression(線性迴歸) 2.Gradient descent(梯度下降) 3.Ordinary Least Square(傳統的最小二乘法) 4.Normal equation(正規