Self-Supervised Learning for Stereo Matching with Self-Improving Ability

首先呢,這是一個非監督演算法,因此它約束的方式就是左右一致性檢測,用warp來處理左右圖,詳見3.1。作者聲情並茂的講述自己就是不要gt。。

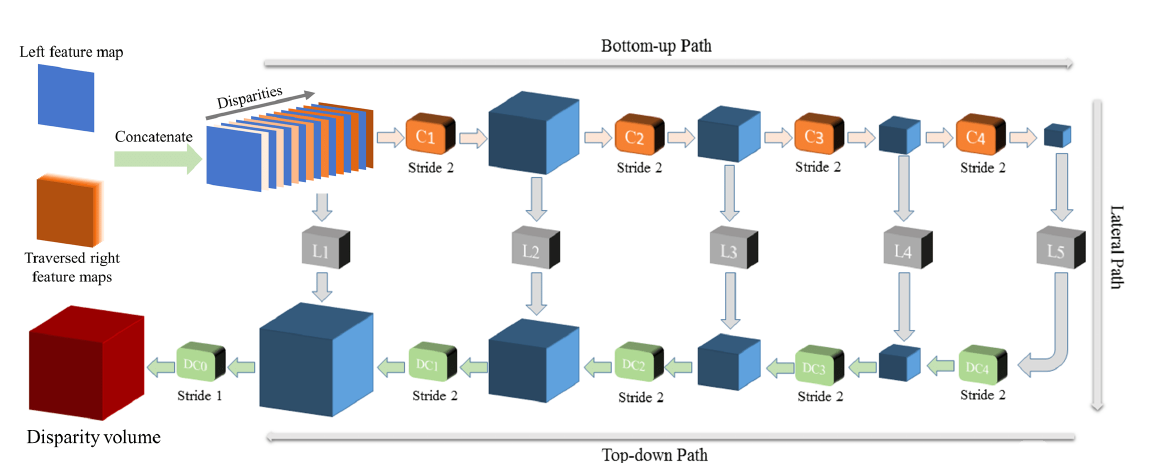

網路結構

五部分組成 特徵提取 交叉特徵向量融合 3D特徵匹配 soft-argmin 最後通過影象warp來做約束。

特徵提取

有了特徵提取,就可以不虛那些複雜區域啦。以往傳統的方法相當於是取畫素域的原始特徵,而深度學習取得特徵則是自己去學的

具體特徵怎麼取的呢,是跟GC-Net一樣的。

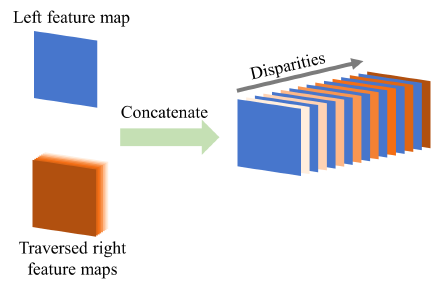

構建特徵向量

通過學習的特徵來構建匹配代價空間,需要先對視差範圍做一個確定,然後將左右特徵圖片concated起來,從而生成最終的特徵向量

左圖複製D份,右圖平移D。然後相間的concat。

對3D特徵進行regularization

3D卷積反捲積

所以這篇文章就是非監督的GC-Net

簡直一模一樣~~~

真的是醉了

浪費了時間讀這篇文章。。

相關推薦

Self-Supervised Learning for Stereo Matching with Self-Improving Ability

首先呢,這是一個非監督演算法,因此它約束的方式就是左右一致性檢測,用warp來處理左右圖,詳見3.1。作者聲情並茂的講述自己就是不要gt。。 網路結構 五部分組成 特徵提取 交叉特徵向量融合 3D特徵匹配 soft-argmin 最後通過影象warp來做約束。 特徵提取

論文閱讀《ActiveStereoNet:End-to-End Self-Supervised Learning for Active Stereo Systems》

最好 ati 計算 最重要的 non-rigid ssi local 模糊 trac 本文出自谷歌與普林斯頓大學研究人員之手並發表於計算機視覺頂會ECCV2018。本文首次提出了應用於主動雙目立體視覺的深度學習解決方案,並引入了一種新的重構誤差,采用自監督的方法來解決缺少g

深度學習:論文self-trainsfer learning for weakly supervised lesion localization

self-training learning: 自我訓練學習 weakly supervised :弱監督學習 主要關注三種弱監督型別: 第一種是不完全監督,即只有訓練資料集的一個(通常很小的)子集有標籤,其它資料則沒有標籤。 第二種是不確切監督,即只有粗粒度的標籤。又以影象

Python計算機視覺深度學習三合一Deep learning for computer vision with Python高清pdf

Deep Learning for Computer Vision with Python Starter Bundle pdf Deep Learning for Computer Vision with Python Practitioner Bundle pdf Deep Learning for

立體匹配之(三): A Deep Visual Correspondence Embedding Model for Stereo Matching Costs

摘要 也是基於patches的匹配 加入亮度資訊 最後基於全域性優化 可惜沒有公開程式碼,在KITTI2012資料集上排在16,沒有在2015上排。 1 Introduction This deep embedding model leverages

Cross-Scale Cost Aggregation for Stereo Matching立體匹配演算法介紹

最近,研究了下CVPR2014上的一篇基於多尺度代價聚合的立體匹配演算法,這個作者提供了原始碼,運行了下,發現效果真心不錯,不開後端處理的話,時間在0.4s左右。這個演算法比較牛逼的有兩點: 1:結合多尺度思想,對原始影象進行下采樣,然後在每層影象上計算匹配代

[CVPR2015] Is object localization for free? – Weakly-supervised learning with convolutional neural networks論文筆記

sed pooling was 技術分享 sco 評測 5.0 ict highest p.p1 { margin: 0.0px 0.0px 0.0px 0.0px; font: 15.0px "Helvetica Neue"; color: #323333 } p.p2

Unsupervised Single Image Deraining with Self-supervised Constraints論文閱讀

原文連結:https://arxiv.org/pdf/1811.08575.pdf 文中提到以往的無監督方法因為沒有對應的ground truth來計算mse約束生成影象,因此會產生一些artifacts,還有就是以往的影象轉換任務都是one to one 的transform,而雨的不確定性太

MIT 深度學習與自動駕駛公開課 Deep Learning for Self-Driving Cars 講義梗概

MIT今年的深度學習與自動駕駛課,課程比較短,只有五節課,是比較基礎的概述。 提綱整理如下: Introduction to Deep Learning and Self-Driving Cars Deep Reinforcement Learning

深度強化學習入門-05DQN實現高速超車(復現 deeptraffic:MIT 6.S094: Deep Learning for Self-Driving Cars)

總的來說問題還有許多,希望感興趣的同學朋友多多交流。 最近對強化學習比較感興趣,發現強化學習工作較多的地方是無人駕駛決策規劃這一塊,我自己對這方面也比較感興趣,就想做一個超車模型,設計互動環境如下,讓圖中的紅車以最快的速度超越其他障礙車。 我的思路是用d

論文筆記 — MatchNet: Unifying Feature and Metric Learning for Patch-Based Matching

論文:https://github.com/ei1994/my_reference_library/tree/master/papers 本文的貢獻點如下: 1. 提出了一個新的利用深度網路架構基於patch的匹配來明顯的改善了效果; 2. 利用更少的描述符,得到了比state-of-t

CS229 6.12 Neurons Networks from self-taught learning to deep network

self-taught learning 在特徵提取方面完全是用的無監督的方法,對於有標記的資料,可以結合有監督學習來對上述方法得到的引數進行微調,從而得到一個更加準確的引數a。 在self-taught learning中,首先用 無標記資料訓練一個sparse autoencoder,這樣用對於原始輸入

CS229 6.11 Neurons Networks implements of self-taught learning

在machine learning領域,更多的資料往往強於更優秀的演算法,然而現實中的情況是一般人無法獲取大量的已標註資料,這時候可以通過無監督方法獲取大量的未標註資料,自學習( self-taught learning)與無監督特徵學習(unsupervised feature learning)

Learning hierarchical spatio-temporal features for action recognition with ISA

Reading papers_16(Learning hierarchical invariant spatio-temporal features for action recognition with independent subspace analysis)

《 Self-supervised Sample Mining》筆記

CVPR2018論文:《Human-Machine Cooperation: Self-supervised Sample Mining》 作者:加州大學洛杉磯分校(UCLA)博士後王可澤 Motivation 在許多應用場景中,已標註的資料集不是很多,但是未標註或部分標註的資料

Self-Supervised Sparse-to-Dense:Self-Supervised Depth Completion from LiDAR and Monocular Camera

Abstract 深度補全主要面臨的三個挑戰:在稀疏深度輸入中的不規則空間模式,處理多感測器模式的困難,以及缺乏密集畫素級真實深度標籤。在本文中提出了深度迴歸模型學習直接將稀疏深度直接對映到密

學習筆記之Supervised Learning with scikit-learn | DataCamp

Supervised Learning with scikit-learn | DataCamp https://www.datacamp.com/courses/supervised-learning-with-scikit-learn At the end of day, the value of D

Strong Baselines for Neural Semi-supervised Learning under Domain Shift半監督學習

2018 ACL 論文 Strong Baselines for Neural Semi-supervised Learning under Domain Shift 不同資料集的遷移學習 MT-Tri方法在情感分析上(無監督域適應)超過DANN方法 半監督學習結合了監督學習和無監督學

Recurrent Neural Network for Text Classification with Multi-Task Learning

引言 Pengfei Liu等人在2016年的IJCAI上發表的論文,論文提到已存在的網路都是針對單一任務進行訓練,但是這種模型都存在問題,即缺少標註資料,當然這是任何機器學習任務都面臨的問題。 為了應對資料量少,常用的方法是使用一個無監督的預訓練模型,比如詞向量,實驗中也取得了不錯

step Time Series Forecasting with Machine Learning for Household Electricity Consumption

Given the rise of smart electricity meters and the wide adoption of electricity generation technology like solar panels, there is a wealth of electricity