機器學習模型-決策樹(ID3)

決策樹Decision Tree(Based on ID3)

ID3演算法:以資訊增益作為選擇特徵的準則(只適用於離散屬性)

(一)資料集

使用了2個數據集來測試DT:

(二)程式碼實現

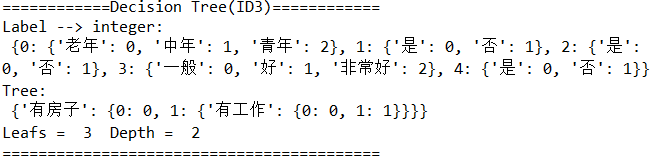

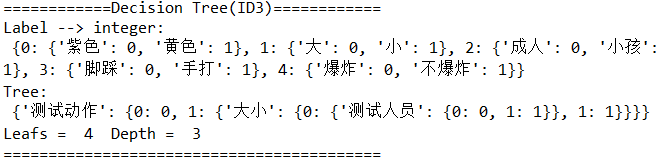

(三)測試結果

相關推薦

機器學習模型-決策樹(ID3)

決策樹Decision Tree(Based on ID3) ID3演算法:以資訊增益作為選擇特徵的準則(只適用於離散屬性) (一)資料集 使用了2個數據集來測試DT: (二)程式碼實現 (三)測試結果

機器學習之決策樹(ID3)

決策樹 我們直觀的通關這個樹狀圖去了解一下決策樹的概念,下面這個例子是姑娘相親見不見的問題 通過上面的圖我們可以看到首先這個姑娘是看相親物件的年齡問題,當年齡大於30歲就不見,小於三十歲就見以此類推形成這個深度為5的樹接下來讓我們一起復習一下我們以前學過的資料結構關於樹的基礎知識: 結點

機器學習演算法 --- 決策樹ID3,C4.5

一、決策樹基本概念及演算法優缺點 1.什麼是決策樹 分類決策樹模型是一種描述對例項進行分類的樹形結構。決策樹由結點和有向邊組成。結點有兩種型別:內部結點和葉結點。內部結點表示一個特徵或屬性,葉結點表示一個類。 決策樹(Decision Tree),又稱判定

機器學習之決策樹與隨機森林模型

會有 strong pytho red -s 很多 4.5 是我 機器 歡迎大家前往騰訊雲技術社區,獲取更多騰訊海量技術實踐幹貨哦~ 作者:汪毅雄 導語 本文用容易理解的語言和例子來解釋了決策樹三種常見的算法及其優劣、隨機森林的含義,相信能幫助初學者真正地理解相關知識

ID3的REP(Reduced Error Pruning)剪枝程式碼詳細解釋+周志華《機器學習》決策樹圖4.5、圖4.6、圖4.7繪製

處理資料物件:離散型資料 資訊計算方式:熵 資料集:西瓜資料集2.0共17條資料 訓練集(用來建立決策樹):西瓜資料集2.0中的第1,2,3,6,7,10,14,15,16,17,4 請注意,書上說是10條,其實是上面列出的11條。 驗證集(用來對決策樹剪枝):西瓜資料集2.0中的5,8

【機器學習】決策樹(基於ID3,C4.5,CART分類迴歸樹演算法)—— python3 實現方案

內含3種演算法的核心部分. 沒有找到很好的測試資料. 但就理清演算法思路來說問題不大 剪枝演算法目前只實現了CART迴歸樹的後剪枝. import numpy as np from collections import Counter from sklearn imp

機器學習:決策樹及ID3,C4.5,CART演算法描述

文章目錄 概念理解 熵: 條件熵: 資訊增益,互資訊: 資訊增益比 基尼指數 ID3演算法描述 C4.5演算法描述 CART (Classification and Regression Tree

【機器學習】決策樹(三)——生成演算法(ID3、C4.5與CRAT)

回顧 前面我們介紹了決策樹的特徵選擇,以及根據資訊增益構建決策樹。 那麼決策樹的生成又有哪些經典演算法呢?本篇將主要介紹ID3的生成演算法,然後介紹C4.5中的生成演算法。最後簡單介紹CRAT演算法。 ID3演算法 前面我們提到,一般而言,資訊增

【Machine Learning·機器學習】決策樹之ID3演算法(Iterative Dichotomiser 3)

目錄 1、什麼是決策樹 2、如何構造一棵決策樹? 2.1、基本方法 2.2、評價標準是什麼/如何量化評價一個特徵的好壞? 2.3、資訊熵、資訊增益的計算 2.4、決策樹構建方法

機器學習系列-決策樹

決策樹歸納 tin 優化 貪心 閾值 相關 數據源 準備 調用 決策樹 什麽是決策樹 決策樹是一種簡單高效並且具有強解釋性的模型,廣泛應用於數據分析領域。其本質是一顆由多個判斷節點組成的樹。 上圖是一個簡單的決策樹模型,用來判斷某個動物樣本是否屬於哺乳動物,樹中包含三種節

機器學習_決策樹

TP mage 技術分享 ima height 分享圖片 image bsp 決策樹 機器學習_決策樹

機器學習:決策樹(基尼系數)

try matplot 代碼實現 sci bubuko div tro 兩種 () 一、基礎理解 1)公式 k:數據集中樣本類型數量; Pi:第 i 類樣本的數量占總樣本數量的比例 2)實例計算基尼系數 3 種情況計算基尼系數: 基尼系數的性質與信息熵

機器學習_決策樹Python代碼詳解

機器 one math n) sco atl return 復雜度 重復 決策樹優點:計算復雜度不高,輸出結果易於理解,對中間值的缺失不敏感,可以處理不相關特征數據; 決策樹缺點:可能會產生過度匹配問題。 決策樹的一般步驟: (1)代碼中def 1,計算給定數據集的香農熵:

機器學習之決策樹(二)

天氣 次數 format 定義 表示 葉子節點 ast 代碼 wid 一、復習信息熵 為了解決特征選擇問題,找出最優特征,先要介紹一些信息論裏面的概念。 1、熵(entropy) python3代碼實現: def calcShannonEnt(

機器學習實戰——決策樹Python實現問題記錄

問題:NameError: name 'reload' is not defined import imp import trees imp.reload(trees) 結論:已經匯入過的模組才能用reload, reload的引數應該是模組名,而不是檔名。在pyhton3.x中要先匯入檔案

[三]機器學習之決策樹與隨機森林

3.1 目標任務 1.學習決策樹和隨機森林的原理、特性 2.學習編寫構造決策樹的python程式碼 3.學習使用sklearn訓練決策樹和隨機森林,並使用工具進行決策樹視覺化 3.2 實驗資料 資料集:鳶尾花資料集,詳情見[機器學習之迴歸]的Logistic迴歸實驗 3.3

機器學習3---決策樹

決策樹(decision tree)是一種典型的非線性分類演算法。因為是針對於非數值型特徵的決策,且決策過程都是按照樹狀結構進行,由此得名決策樹。 首先,非數值型特徵是指非數值化的特徵,如:名義特徵(使用特定的名詞描述某個物體)、序數特

機器學習_8.決策樹演算法

1.ID3演算法 預備知識 1.資訊熵: 2.資訊增益 演算法內容 引入了資訊理論中的互資訊(資訊增益)作為選擇判別因素的度量,即:以資訊增益的下降速度作為選取分類屬性的標準,所選的測試屬性是從根節點到當前節點的路徑上從沒有

【機器學習】決策樹剪枝優化及視覺化

前言 \quad\quad 前面,我們介紹了分類決策樹的實現,以及用 sklearn 庫中的 DecisionTre

【機器學習】決策樹與隨機森林(轉)

文章轉自: https://www.cnblogs.com/fionacai/p/5894142.html 首先,在瞭解樹模型之前,自然想到樹模型和線性模型有什麼區別呢?其中最重要的是,樹形模型是一個一個特徵進行處理,之前線性模型是所有特徵給予權重相加得到一個新的值。決