常見啟用函式(sigmoid/logistic/tanh/softmax/ReLU關係解釋)

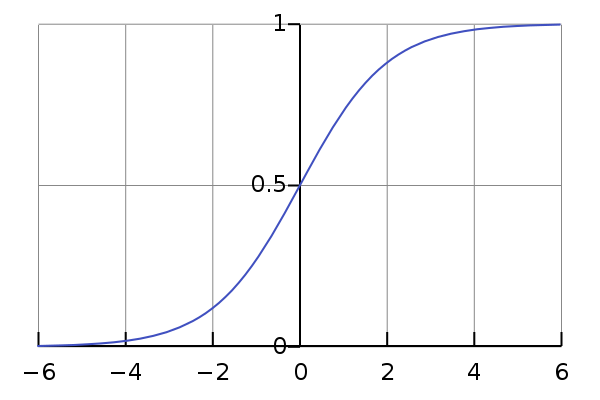

Sigmoid

神經網路最常見的啟用函式就是sigmoid函式。

sigmoid函式意為“S型曲線函式”,它常常指的是logistic(對數機率)函式:

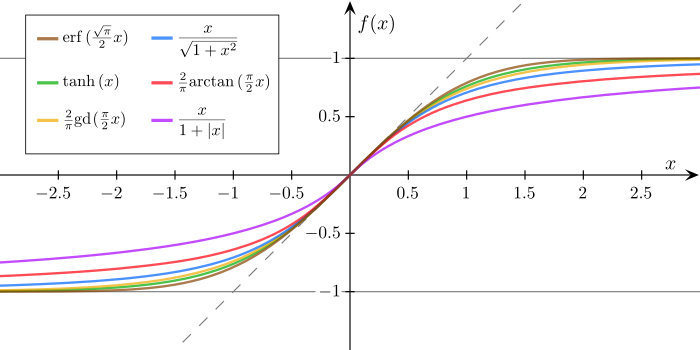

但sigmoid函式還有其他的函式,例如tanh函式等。

(更多見https://en.wikipedia.org/wiki/Sigmoid_function)

Softmax

logistic函式是對於二分類的函式,若擴充套件到K維,則為softmax函式:

其中

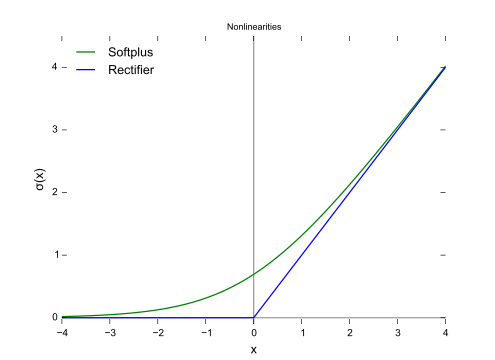

ReLU&softplus

2001年,神經科學家Dayan、Abott從生物學角度模擬出了腦神經元接受訊號更精確的啟用模型,ReLU(Rectified Linear Units)函式被提出:

而ReLU函式是個分段函式,求它的平滑近似函式就是softplus函式:

可以發現,softplus求導為

所以可以得到以上提及的函式的關係圖: