邏輯迴歸模型結果轉為標準評分卡Ⅰ

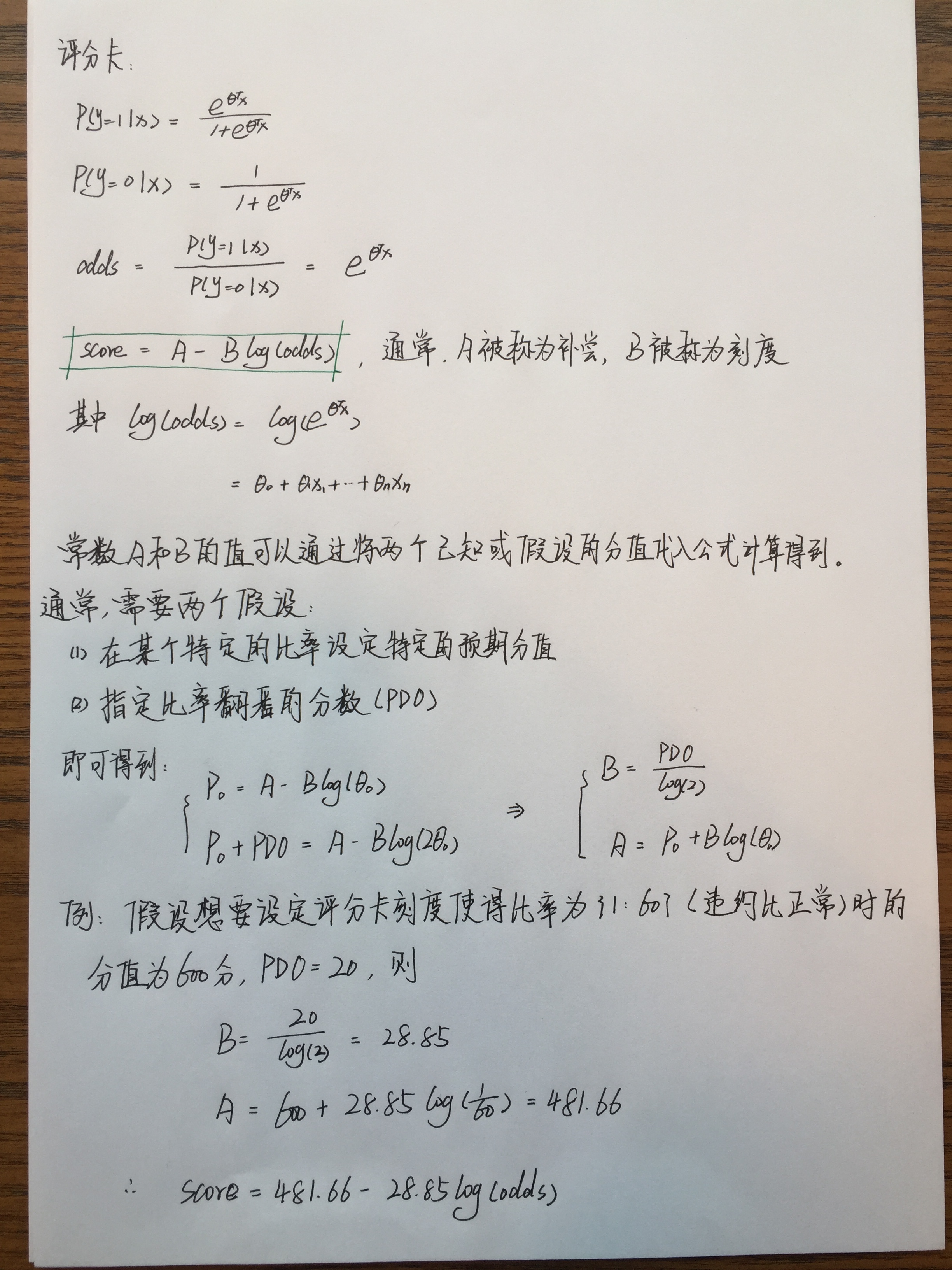

在建立評分卡模型時,我們經常會使用邏輯迴歸來對資料進行建模。但在用邏輯迴歸進行預測時,邏輯迴歸返回的是一個概率值,並不是評分卡分數。下面為大家介紹如何將模型結果轉換為標準評分卡,具體步驟如下:

連結為如何將評分卡的結果做成表格的形式,以便於業務人員去使用:邏輯迴歸模型結果轉為標準評分卡Ⅱ

相關推薦

邏輯迴歸模型結果轉為標準評分卡Ⅱ

上篇文章介紹瞭如何將模型結果轉換為標準評分卡的形式,下面為大家介紹一種更為直觀的評分卡的展現形式:將每個變數的不同取值做成一張表格的形式。這樣我們可以更加清晰的知道樣本每個變數總最終得分的貢獻。具體步驟如下: 通常,該分值將四捨五入到最近的整數,以簡化評分卡的表

邏輯迴歸模型結果轉為標準評分卡Ⅰ

在建立評分卡模型時,我們經常會使用邏輯迴歸來對資料進行建模。但在用邏輯迴歸進行預測時,邏輯迴歸返回的是一個概率值,並不是評分卡分數。下面為大家介紹如何將模型結果轉換為標準評分卡,具體步驟如下: 連結為如何將評分卡的結果做成表格的形式,以便於業務人員去使用:邏輯迴

清華AI自強計劃作業2實驗—邏輯迴歸模型

問題: 執行模型輸出loss值為NAN,訓練200次後未出現線性模型 nan nan的資料型別為float, not a number 的縮寫。python中判斷是否為nan型別的方法,使用math庫中的*isnan()*函式判斷: from math import

tensorflow構造邏輯迴歸模型

import numpy as np import tensorflow as tf import matplotlib.pyplot as plt import input_data mnist = input_data.read_data_sets('data/', one_hot=True)

實戰:利用Python sklearn庫裡的邏輯迴歸模型訓練資料---建立模型

本案例主要是通過對不均衡的28萬組資料建立模型,分析預測欺詐使用者,採用sigmod函式作為損失函式,採用交叉驗證的方法 和l1正交法則,比對了不同懲罰函式下的模型的召回率,也通過預測值和實際值做出混淆矩陣更加直觀看到各種預測結果。 也比較了sigmod函式下的不同閾值下的模型預測的精度和召

邏輯迴歸模型在R中實踐

在日常學習或工作中經常會使用線性迴歸模型對某一事物進行預測,例如預測房價、身高、GDP、學生成績等,發現這些被預測的變數都屬於連續型變數。然而有些情況下,被預測變數可能是二元變數,即成功或失敗、流失或不流失、漲或跌等,對於這類問題,線性迴歸將束手無策。這個時候就需要另一種

邏輯迴歸模型總結-機器學習

邏輯迴歸被廣泛的用來解決分類問題。由於分類是非線性問題,所以建模的主要難點是如何把非線性問題轉換為線性問題。 在模型評估層面,討論了兩類相互有關聯的評估指標。對於分類問題的預測結果,可以定義為相應的查準查全率。對於基於概率的分類模型,還可以繪製它的ROC曲線,以及計算曲線線面的面積AUC。

客戶貸款逾期預測[1]-邏輯迴歸模型

任務 預測貸款客戶是否會逾期,status為響應變數,有0和1兩種值,0表示未逾期,1表示逾期。 程式碼: # -*- coding: utf-8 -*- """ Created on Thu Nov 15 13:02:11 2018

機器學習(四)邏輯迴歸模型訓練

本篇不講演算法 只講用Python (pandas, matplotlib, numpy, sklearn) 進行訓練的一些要點 1.合併index np.concatenate([index1,index2]) 2.from sklearn.cross_va

邏輯迴歸模型實踐-貸款逾期預測

任務 預測貸款使用者是否會逾期,status為響應變數,有0和1兩種值。 程式碼: # -*- coding: utf-8 -*- """ Created on Thu Nov 15 13:02:11 2018 @author: keepi """ i

邏輯迴歸模型(logistic regression)

邏輯迴歸模型意義 邏輯迴歸是機器學習中做分類任務常用的方法,屬於“廣義的線性模型”,即: 考慮二分類任務,其輸出標記y∈{0,1},而線性迴歸模型產生的預測值 z = wx+b是實值,於是,需要將實

LR(Logistic Regression) 邏輯迴歸模型 進行二分類或多分類 及梯度下降學習引數

邏輯迴歸(Logistic Regression, LR)是傳統機器學習中的一種分類模型,由於演算法的簡單和高效,在實際中應用非常廣泛。它的起源非常複雜,可以看參考引用1。具體應用實踐可以看這裡。 問題背景 對於二元分類問題,給定一個輸入特徵向量XX(例

邏輯迴歸模型(Logistic Regression, LR)基礎

邏輯迴歸(Logistic Regression, LR)模型其實僅線上性迴歸的基礎上,套用了一個邏輯函式,但也就由於這個邏輯函式,使得邏輯迴歸模型成為了機器學習領域一顆耀眼的明星,更是計算廣告學的核心。本文主要詳述邏輯迴歸模型的基礎,至於邏輯迴歸模型的優化、邏輯迴歸與計算廣告學等,請關注後續文章。 1

機器學習演算法(一):邏輯迴歸模型(Logistic Regression, LR)

轉自:https://blog.csdn.net/weixin_39910711/article/details/81607386 線性分類器:模型是引數的線性函式,分類平面是(超)平面;非線性分類器:模型分介面可以是曲面或者超平面的組合。 典型的線性分類器有感知機,LDA,邏輯斯特迴歸,SVM

LR模型(邏輯迴歸模型)

1.邏輯迴歸模型 按照音譯logistic regression應該是邏輯斯蒂迴歸,太難聽了,就簡稱邏輯迴歸吧。 1.1 二項邏輯迴歸模型 二項邏輯迴歸模型是一種二分類模型,儘管它叫“迴歸”。 模型如下: P(Y=1|x)=e(w⋅x+b)1+e(

邏輯迴歸模型的兩種定義與引數估計思路

邏輯斯諦迴歸(logistic regression)是統計學習中的經典分類方法,屬於判別模型。 1. 邏輯斯諦迴歸模型定義 在 Andrew NG 的 Machine Learning 課程和李航的統計學習方法中,都有對邏輯斯諦迴歸模型的介紹,然而二者

機器學習中的邏輯迴歸模型簡介

邏輯迴歸(Logistic Regression)是機器學習中的一種分類模型,由於演算法的簡單和高效,在實際中應用非常廣泛。本文作為美團機器學習InAction系列中的一篇,主要關注邏輯迴歸演算法的數學模型和引數求解方法,最後也會簡單討論下邏輯迴歸和貝葉斯分類的關係

邏輯迴歸模型的評估方法

從Weka工具跑回歸模型可以看到評估的輸出,怎麼解讀自行腦補過,大概明白了些。 翠花,上截圖! 我們普通人最直接的理解是正確率吧。應該對應到Correctly Classified Instances比例(正確分類了的例項)。 在上圖中,總例項數100

斯坦福大學機器學習筆記——正則化的邏輯迴歸模型

在上面部落格中我們討論了正則化的線性迴歸模型,下面我們來討論一下正則化的邏輯迴歸模型。 前面我們講述了兩種常用於邏輯迴歸的方法: 基於梯度下降法的邏輯迴歸模型 基於高階優化的邏輯迴歸模型 基於

信用評分卡模型總結10:評分卡的建立及sas部署實施

建立評分卡的基本過程可以總結為以下幾個步驟。 確定最終評分卡將被納入模型的變數 使用WOE值和模型引數,為不同變數的每一類或每一段相應的分配分值。模型的截距項用於計算評分卡的基準點。 每個變數類別或分段分配的分值都根據對應的變數取值範圍製成表格。 為了便於實施,經常要將評分卡表現為某種程式的