[深度學習] 反向傳播的四個基本公式證明及演算法流程

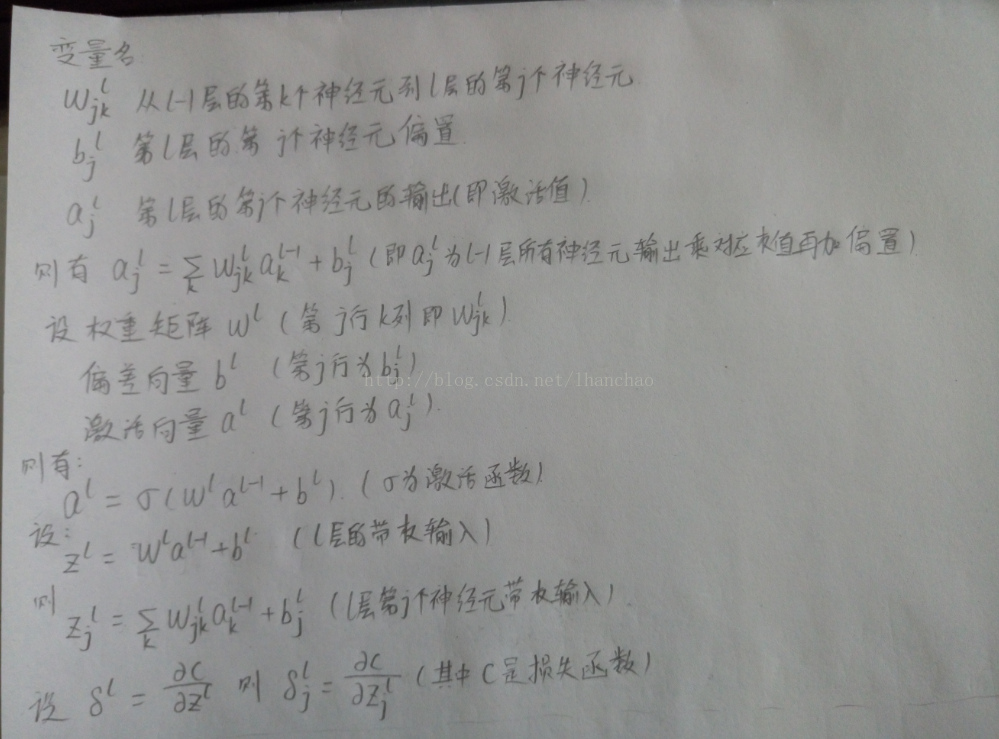

首先,我們來定義一些變數名:

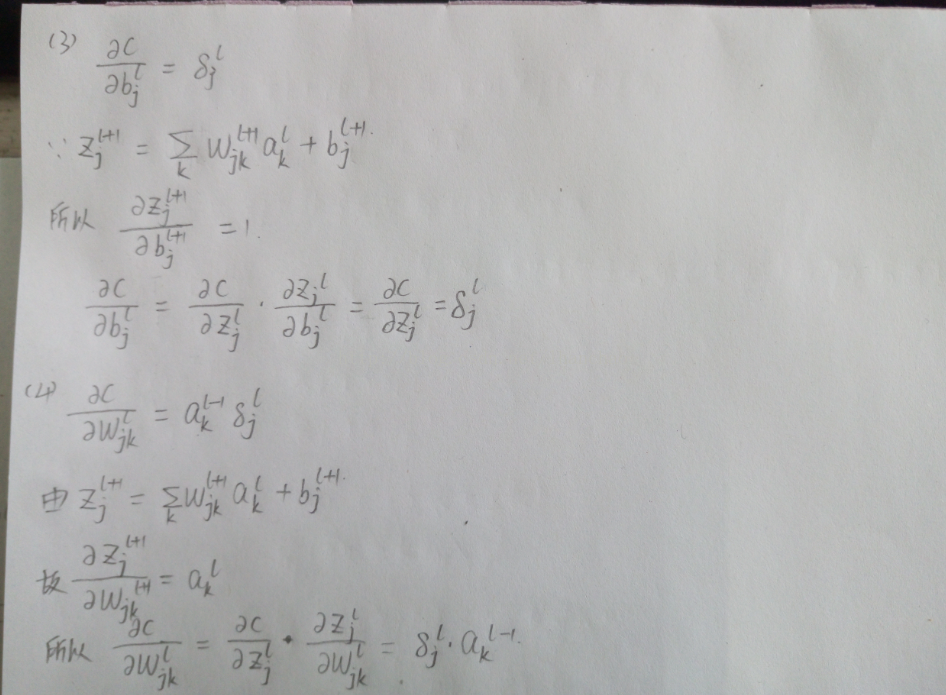

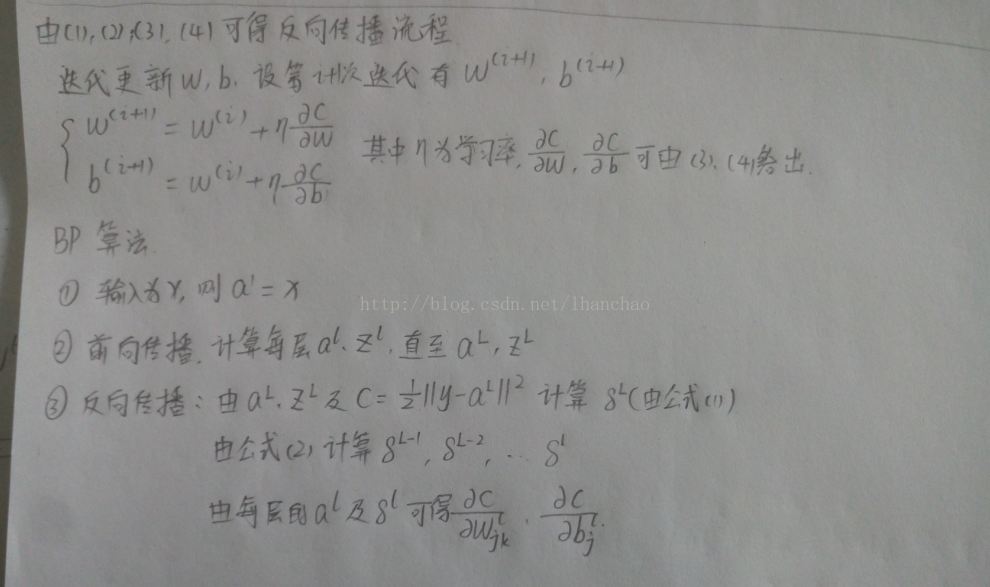

然後是以下四個公式的證明過程:

最後我們得到反向傳播演算法的演算法流程:

PS:對著網上的教程推了小半天,現在總算記住了,沒準以後面試就會考到 = = 不過反向傳播是現在網路訓練的數學基礎,以前只是有感性的認識,現在數學公式一列還是清楚了不少。

相關推薦

[深度學習] 反向傳播的四個基本公式證明及演算法流程

首先,我們來定義一些變數名: 然後是以下四個公式的證明過程: 最後我們得到反向傳播演算法的演算法流程: PS:對著網上的教程推了小半天,現在總算記住了,沒準以後面試就會考到 = = 不過反向傳播是現在網路訓練的數學基礎,以前只是有感性的認識,現在數學公式一列還是

深度學習---反向傳播演算法BP

這個BP演算法可以多看幾遍,條理清晰Stanford機器學習---第五講. 神經網路的學習 Neural Networks learning推導過程:重點參考必看:https://blog.csdn.net/fendouaini/article/details/7978944

深度學習反向傳播---隨機梯度下降法

一、誤差準則函式與隨機梯度下降: 數學一點將就是,對於給定的一個點集(X,Y),找到一條曲線或者曲面,對其進行擬合之。同時稱X中的變數為特徵(Feature),Y值為預測值。 如圖: 一個典型的機器學習的過程,首先給出一組輸入資料X,我們的演算法會通過一系列的過程得到一個

深度學習與計算機視覺: 搞懂反向傳播演算法的四個基本方程

BP演算法,在深度神經網路的發展中有著舉足輕重的地位,對於反向傳播演算法的推導過程,各種資料介紹可謂是多不勝數。但,由於深度神經網路的複雜性,要比較深刻的理解反向傳播演算法還是需要自己手動的推導一遍。 本文以前篇深度學習與計算機視覺: 深度學習必知基本概念以及鏈式求導介紹了神經網路的反向傳播中的鏈式求導法則

數據庫的四個基本語句

基本 bsp update 對數 values font select 增加 數據庫 對數據庫的操作基本是增加,刪除,修改,查詢。 1.基本的查詢語句 select * from 表名 where 查詢條件 select COUNT(*) from 表名(返回的是這個表裏數

REST的四個基本原則

ces 主域名 nta http you 排序 不可 使用方式 cat 網絡應用程序,分為前端和後端兩個部分。當前的發展趨勢,就是前端設備層出不窮(手機、平板、桌面電腦、其他專用設備......)。 因此,必須有一種統一的機制,方便不同的前端設備與後端進行通信。這導致API

吳恩達《深度學習》第四門課(1)卷積神經網絡

圖像分割 1.5 共享 信號處理 soft 沒有 樣本 填充 單元 1.1計算機視覺 (1)計算機視覺的應用包括圖像分類、目標檢測、圖像分割、風格遷移等,下圖展示了風格遷移案例: (2)圖像的特征量非常之大,比如一個3通道的1000*1000的照片,其特征為3*1000*

吳恩達《深度學習》第四門課(2)卷積神經網絡:實例探究

之一 所有 展示 數據擴充 簡介 設置 假設 通道 開源 2.1為什麽要進行實例探究 (1)就跟學編程一樣,先看看別人怎麽寫的,可以模仿。 (2)在計算機視覺中一個有用的模型,,用在另一個業務中也一般有效,所以可以借鑒。 (3)本周會介紹的一些卷積方面的經典網絡經典的包括:

機器學習-反向傳播算法(BP)代碼實現(matlab)

sha eric his work onclick chan same images let %% Machine Learning Online Class - Exercise 4 Neural Network Learning % Instructions

【火爐煉AI】深度學習001-神經網路的基本單元-感知器

【火爐煉AI】深度學習001-神經網路的基本單元-感知器 (本文所使用的Python庫和版本號: Python 3.6, Numpy 1.14, scikit-learn 0.19, matplotlib 2.2 ) 在人工智慧領域,深度學習已經脫穎而出,越來越成為大型複雜問題的首選解決方案。深度學習相對

深度學習筆記(四)——神經網路和深度學習(淺層神經網路)

1.神經網路概覽 神經網路的結構與邏輯迴歸類似,只是神經網路的層數比邏輯迴歸多一層,多出來的中間那層稱為隱藏層或中間層。從計算上來說,神經網路的正向傳播和反向傳播過程只是比邏輯迴歸多了一次重複的計算。正向傳播過程分成兩層,第一層是輸入層到隱藏層,用上標[1]來表示;第二層是隱藏層到輸出層,用上標

機器學習與深度學習系列連載: 第二部分 深度學習(十四)迴圈神經網路 2(Gated RNN - LSTM )

迴圈神經網路 2(Gated RNN - LSTM ) simple RNN 具有梯度消失或者梯度爆炸的特點,所以,在實際應用中,帶有門限的RNN模型變種(Gated RNN)起著至關重要的作用,下面我們來進行介紹: LSTM (Long Short-term Memory )

線性代數之——四個基本子空間

1. 四個基本子空間 行空間 C ( A

[TensorFlow深度學習入門]實戰四·邏輯迴歸鳶尾花進行分類(對比均方根誤差與softmax交叉熵誤差區別)

[TensorFlow深度學習入門]實戰四·邏輯迴歸鳶尾花進行分類 問題描述 資料集 鳶尾花資料集下載地址 鳶尾花資料集包含四個特徵和一個標籤。這四個特徵確定了單株鳶尾花的下列植物學特徵: 1、花萼長度 2、花萼寬度 3、花瓣長度 4、花瓣寬度 該標籤確定了鳶尾花品種,

面向物件的四個基本特徵和七大設計原則

複習一哈~ 基本特徵抽象 將一些事物的共性抽離出來歸為一個類。 如對於動物,具有生命體徵、活動能力等區別於其它事物的共同特徵 封裝 有選擇地隱藏和暴露資料和方法 比如有U盤這個類,我希望隱藏內部組成和實現,只暴露USB介面以供使用 繼承 子類可以直接使用父類的部分資料和方法,可以

MIT 線性代數導論 第九講:四個基本子空間

本講的主要內容: 四種子空間的概念以及維數、基 四種基本子空間 首先了解四種基本子空間是什麼: 列空間(column space),簡記為 C(A)C(A)C(A), 由矩陣的列向量生成的空間 零空間(null space),簡記為 N(A)N(A)N(A

深度學習 --- 優化入門四(Batch Normalization(批量歸一化)一)

前幾節我們詳細的探討了,梯度下降存在的問題和優化方法,本節將介紹在資料處理方面很重要的優化手段即批量歸一化(批量歸一化)。 批量歸一化(Batch Normalization)並不能算作是一種最優化演算法,但其卻是近年來優化深度神經網路最有用的技巧之一,並且這種方法非常的簡潔方便,可以和其他

機器學習(二):機器學習中的幾個基本概念

前言 對於《統計學習方法》中遇到的一些問題,以及機器學習中的一些自己沒有理解透徹的問題,希望通過梳理總結能夠有更深入的理解。 在上一章最開始我們已經概括了統計學習方法的三要素,即模型、策略、演算法,這裡就不再詳述了。 本文討論總結了如下幾個概念:損失函式與風險

flask學習中的四個session

★四個session 1.上下文的狀態保持session 概念:是一個鍵值對字串,鍵儲存在瀏覽器,只儲存在伺服器,是基於cookie實現的。 作用: 用來儲存使用者資訊,記錄使用者狀態 注意:與語言無關,與框架啊無關,是一種抽象的概念 2.flask中的sess

機器學習與深度學習系列連載: 第二部分 深度學習(十四)迴圈神經網路 2(Gated RNN

迴圈神經網路 2(Gated RNN - LSTM ) simple RNN 具有梯度消失或者梯度爆炸的特點,所以,在實際應用中,帶有門限的RNN模型變種(Gated RNN)起著至關重要的作用,下面我們來進行介紹: LSTM (Long Short-term