感知器分類演算法

1、基本介紹

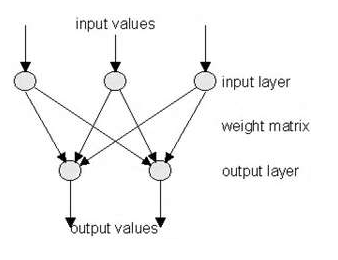

感知器學習演算法是神經網路中的一個概念,單層感知器是最簡單的神經網路,輸入層和輸出層直接相連。

每一個輸入端和其上的權值相乘,然後將這些乘積相加得到乘積和,這個結果與閾值相比較(一般為0),若大於閾值輸出端就取1,反之,輸出端取-1。

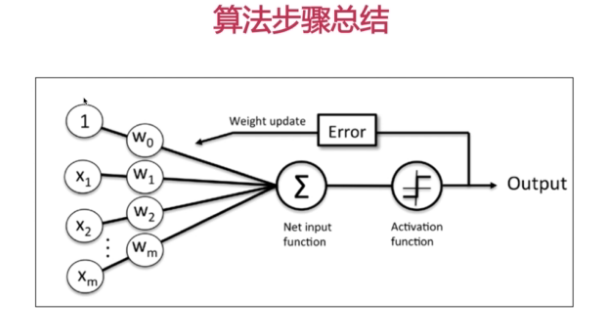

2、權值更新

初始權重向量W=[0,0,0],更新公式W(i)=W(i)+ΔW(i);ΔW(i)=η*(y-y’)*X(i);

η:學習率,介於[0,1]之間

y:輸入樣本的正確分類

y’:感知器計算出來的分類

通過上面公式不斷更新權值,直到達到分類要求。

3、演算法步驟

初始化權重向量W,與輸入向量做點乘,將結果與閾值作比較,得到分類結果1或-1。

相關推薦

第2章 感知器分類演算法 2-2 感知器分類演算法

每一個神經元通過它的分叉組織去接受多個電訊號,而每一個分叉會將電訊號先做一些處理,也就是把這個傳入的電訊號乘以一個引數,所以分叉對應的引數就可以組成一個向量,我們稱之為權重向量W。那麼輸入的電訊號又可以組成一個向量,我們把輸入的電訊號所組成的這個向量稱之為訓練樣本X。 整個機器學習的最終目的,就是通過這個輸

第2章 感知器分類演算法 2-1 分類演算法的總體描述

機器學習的本質是模擬人的神經元對資訊的處理方法。根據神經學的研究,神經元可以看做是一種簡單的帶有二進位制輸出功能的邏輯電路門。多種電訊號能夠從神經元的交叉部分,這種電訊號能夠從交叉部分輸入到我們的神經元之中。那麼這些從這個交叉部分輸進來的電訊號,那麼會進入到神經元的細胞核。那麼細胞核就會將樹突傳入來的這個

神經網路學習(一)——感知器分類演算法

最近,學習了一下神經網路的相關知識。寫一篇部落格,做思路整理。 神經網路包含input layer、hidden layer、output layer三層。(考慮真實神經原傳輸訊號的過程) 感知器分類演算法只適用於可以線性分割的資料!!!!! 相關概念: 訓練樣本X

感知器分類演算法

1、基本介紹 感知器學習演算法是神經網路中的一個概念,單層感知器是最簡單的神經網路,輸入層和輸出層直接相連。 每一個輸入端和其上的權值相乘,然後將這些乘積相加得到乘積和,這個結果與閾值相比較(一般為0),若大於閾值輸出端就取1,反之,輸出端取-1。 2

離散單輸出感知器訓練演算法

二值網路:自變數及其函式的值、向量分量的值只取0和1函式、向量。 權向量:W=(w1,w2,…,wn) 輸入向量:X=(x1,x2,…,xn) 訓練樣本集:{(X,Y)|Y為輸入向量X對應的輸出} 初始化權向量W; 重複下列過程,直到訓練完成

閒談:感知器學習演算法(The perceptron learning algorithm)

這一節我們簡單地介紹歷史上的著名演算法——感知器演算法,這在後面的學習理論中也會有所提及。設想我們改變邏輯迴歸演算法,“迫使”它只能輸出-1或1抑或其他定值。在這種情況下,之前的邏輯函式ggg就會變成閾值函式signsignsign: sign(z)={1if

感知器學習演算法----神經網路

Machine Learning---感知器學習演算法 引言 這裡開始介紹神經網路方面的知識(Neural Networks)。首先我們會介紹幾個監督式學習的演算法,隨後便是非監督式的學習。 一、感知器學習演算法基本介紹 1.神經網路 就像進化計算,神經

機器學習(八)——感知器學習演算法(The perceptron learning algorithm)

現在,讓我們簡要地談論一個歷史上曾經令人很感興趣的演算法,當學習到學習理論章節的時候我們將還會提到這個。試想一下修改logistic迴歸的方法,來“迫使”它能夠輸出除了0或1亦或是其它以外的輸出值。為了達到這個目的,自然而然地會想到去改變閾值函式 gg 的定義:接下來,如果我

Spark中基於神經網路的MLPC(多層感知器分類器)的使用

本文首發於我的個人部落格QIMING.INFO,轉載請帶上鍊接及署名。 MLPC(Multilayer Perceptron Classifier),多層感知器分類器,是一種基於前饋人工神經網路(ANN)的分類器。Spark中目前僅支援此種與神經網路有關的演算

【Python-ML】感知器學習演算法(perceptron)

1、數學模型 2、權值訓練 3、Python程式碼 感知器收斂的前提是兩個類別必須是線性可分的,且學習速率足夠小。如果兩個類別無法通過一個線性決策邊界進行劃分,要為模型在訓練集上的學習迭代次數設定一個最大值,或者設定一個允許錯誤分類樣本數量的閾值,否則感知器

機器學習(三):感知器演算法實現鳶尾花分類專案實戰

上一章我們已經介紹了感知器演算法規則,並且用python語言實現了。現在我們應用感知器學習規則進行鳶尾花分類實驗。 測試資料我們從鳶尾花資料集中挑選出了山鳶尾(Setosa)和變色鳶尾(Versicolor)兩種花的資訊作為測試資料。雖然感知器並不將資料樣本特

spark scala word2vec 和多層分類感知器在情感分析中的實際應用

predict output edi ext oop post format vector spa 轉自:http://www.cnblogs.com/canyangfeixue/p/7227998.html 對於威脅檢測算法使用神經網絡訓練有用!!!TODO待實驗 /

【神經網路入門】用JAVA實現感知器演算法

簡述 隨著網際網路的高速發展,A(AI)B(BigData)C(Cloud)已經成為當下的核心發展方向,假如三者深度結合的話,AI是其中最核心的部分。所以如果說在未來社會,每個人都必須要學會程式設計的話,那麼對於程式設計師來說,人工智慧則是他們所必須掌握的技術(科技發展真tm快)。 這篇文章介紹

用單層感知器實現多個神經元的分類

訓練樣本矩陣: P = [0.1 0.7 0.8 0.8 1.0 0.3 0.0 –0.3 –0.5 –1.5; 1.2 1.8 1.6 0.6 0.8 0.5

《機器學習實戰》基於樸素貝葉斯分類演算法構建文字分類器的Python實現

Python程式碼實現:#encoding:utf-8 from numpy import * #詞表到向量的轉換函式 def loadDataSet(): postingList = [['my','dog','has','flea','problems','help','please'],

基於二次準則函式的H-K演算法較之於感知器演算法的優點

HK演算法的思想很樸實,就是在最小均方誤差準則下求得權向量。 它相對於感知器演算法的優點在於,它適用於線性可分和非線性可分的情況。 對於線性可分的情況,給出最優權向量, 對於分線性可分的情況,能夠判別

樸素貝葉斯分類演算法理解及文字分類器實現

貝葉斯分類是一類分類演算法的總稱,這類演算法均以貝葉斯定理為基礎,故統稱為貝葉斯分類。本文作為分類演算法的第一篇,將首先介紹分類問題,對分類問題進行一個正式的定義。然後,介紹貝葉斯分類演算法的基礎——貝葉斯定理。最後,通過例項討論貝葉斯分類中最簡單的一種:樸素貝葉斯分類。

[模式識別] [講義] 邏輯迴歸與感知器演算法

X − >

機器學習——感知器演算法及python實現

說明:本文從自己的理解出發來講解感知器是如何訓練的,如想知道比較學術的概念,請查閱相關論文。 1、什麼是感知器 本文假設資料為:二維二類、線性可分 感知器就是一個分類器,如:給兩類資料做訓練集A,B,訓練完成之後,給定一個測試資料,通過感知器,可以分成A或B。 因為資料是二

人工智慧深度學習TensorFlow通過感知器實現鳶尾花資料集分類

一.iris資料集簡介 iris資料集的中文名是安德森鳶尾花卉資料集,英文全稱是Anderson’s Iris data set。iris包含150個樣本,對應資料集的每行資料。每行資料包含每個樣本的四個特徵和樣本的類別資訊,所以iris資料集是一個150行5列的二維表。 通俗地說,iris