機器學習與深度學習系列連載: 第二部分 深度學習(十六)迴圈神經網路 4(BiDirectional RNN, Highway network, Grid-LSTM)

阿新 • • 發佈:2018-11-12

深度學習(十六)迴圈神經網路 4(BiDirectional RNN, Highway network, Grid-LSTM)

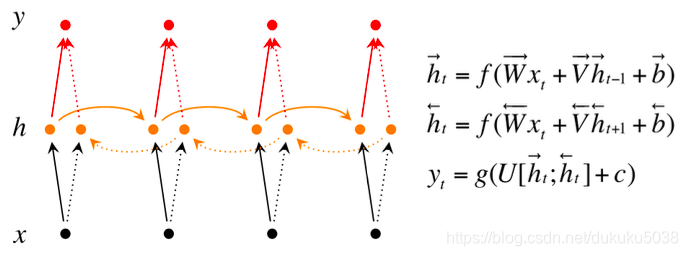

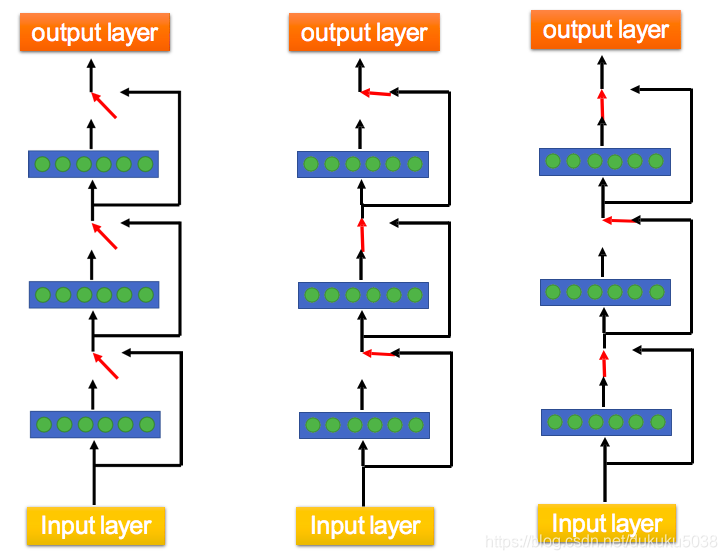

RNN處理時間序列資料的時候,不僅可以正序,也可以正序+逆序(雙向)。下面顯示的RNN模型,不僅僅是simple RNN,可以是LSTM,或者GRU

1 BiDirectional RNN

當然,RNN的層數也不僅僅是一層

2. Highway network

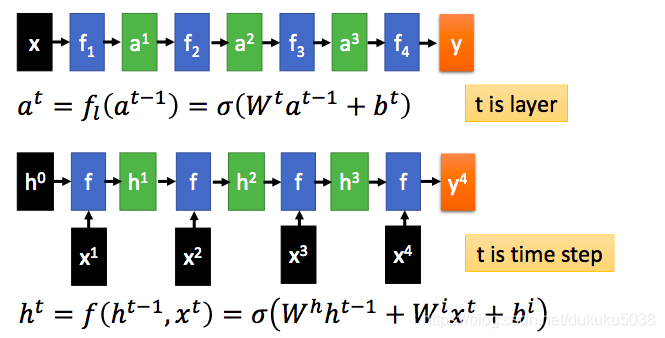

通過傳統的Feedforward neural network和 RNN的學習,對於初學者來講,貌似二者網路結構差異較大,沒有交集。 但是實則不然,我們一起來分析一下。

(1)Feedforward與RNN 網路結構對比

- Feedforward network does not have input at each step

- Feedforward network has different parameters for each layer

當我們嘗試在前向網路中加入Gate門限,我們會得到什麼?

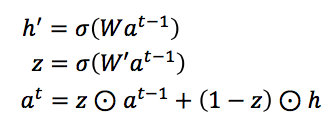

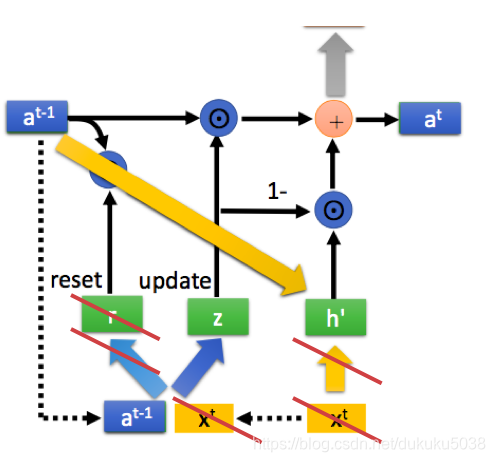

(2)Highway Network

Highway Network 實際上就是豎起來的RNN

Highway Network 與GRU之間的區別

- No input xt at each step

- No output yt at each step

- at-1 is the output of the (t-1)-th layer

- at is the output of the t-th layer

- No reset gate

Highway network 的公式:

我們熟知的殘差神經網路其實就是Highway Network 的一種變種

Highway network 實際上可以自動決定網路的層數:

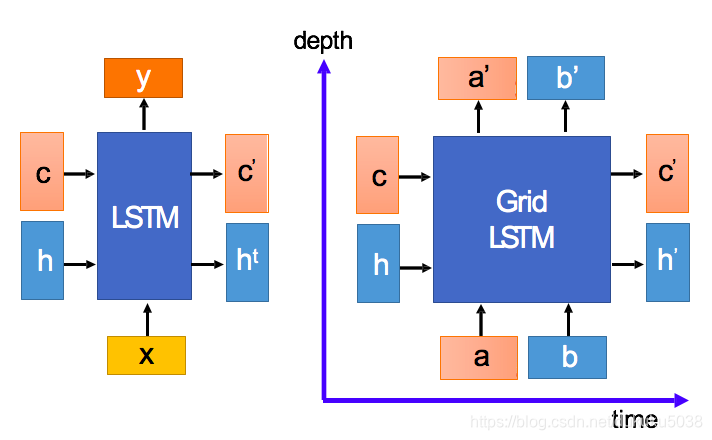

(3) Grid LSTM

傳統的LSTM memory在一個維度,Grid LSTM增加了輸入和輸出的維度,Memory for both time and depth

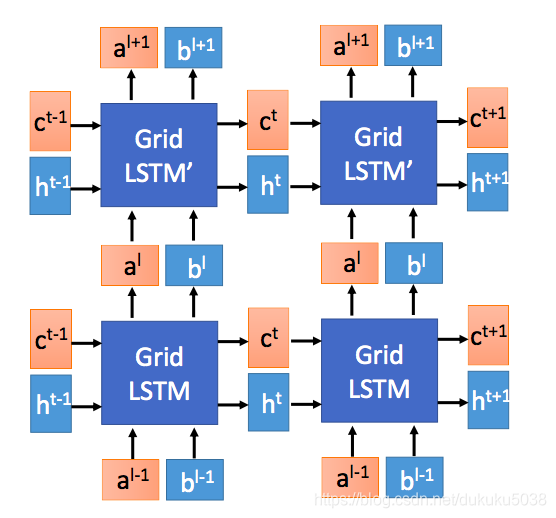

整體time和depth的結構圖:

我們拆解一下Grid LSTM

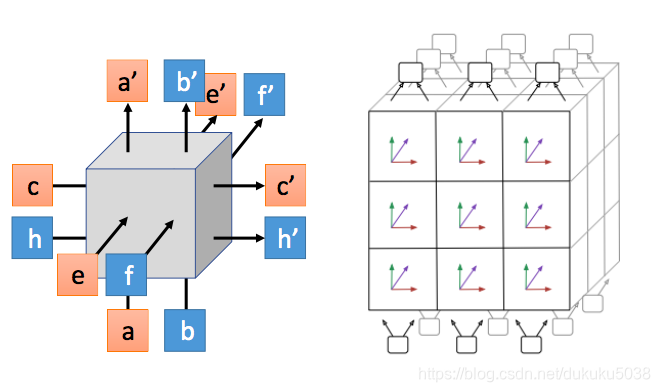

(4) 3D Grid LSTM

又增加一個memory維度

本專欄圖片、公式很多來自臺灣大學李弘毅老師、斯坦福大學cs229,斯坦福大學cs231n 、斯坦福大學cs224n課程。在這裡,感謝這些經典課程,向他們致敬!