機器學習(4)--估算波士頓房屋價格----帶AdaBoost的決策樹迴歸模型

阿新 • • 發佈:2019-01-02

估算波士頓房屋價格—-帶AdaBoost決策樹迴歸模型

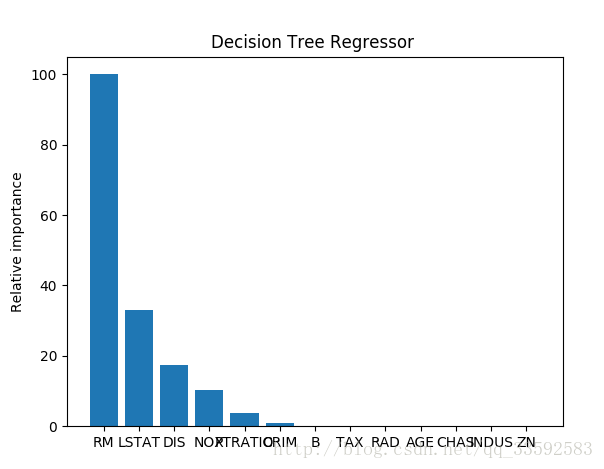

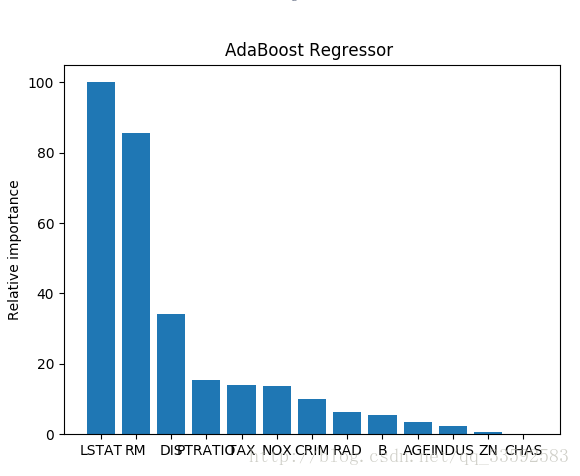

使用帶AdaBoost演算法的決策樹迴歸器(descision tree regressor)

決策樹模型: 樹狀模型,每個節點做決策,從而影響決策結果,葉子節點表示輸出結果,分支表示根據輸入做出中間決策

AdaBoost:利用其他系統增強模型準確型的技術

程式碼如下:

#-*- coding:utf-8 -*-

import numpy as np

from sklearn.tree import DecisionTreeRegressor

from sklearn.ensemble import AdaBoostRegressor

from 輸出結果

###決策樹學習效果###

均方誤差 = 14.79

解釋方差分 = 0.82

###AdaBoost演算法改善效果###

均方誤差 = 7.64

解釋方差分 = 0.91

繪製圖形如下所示: