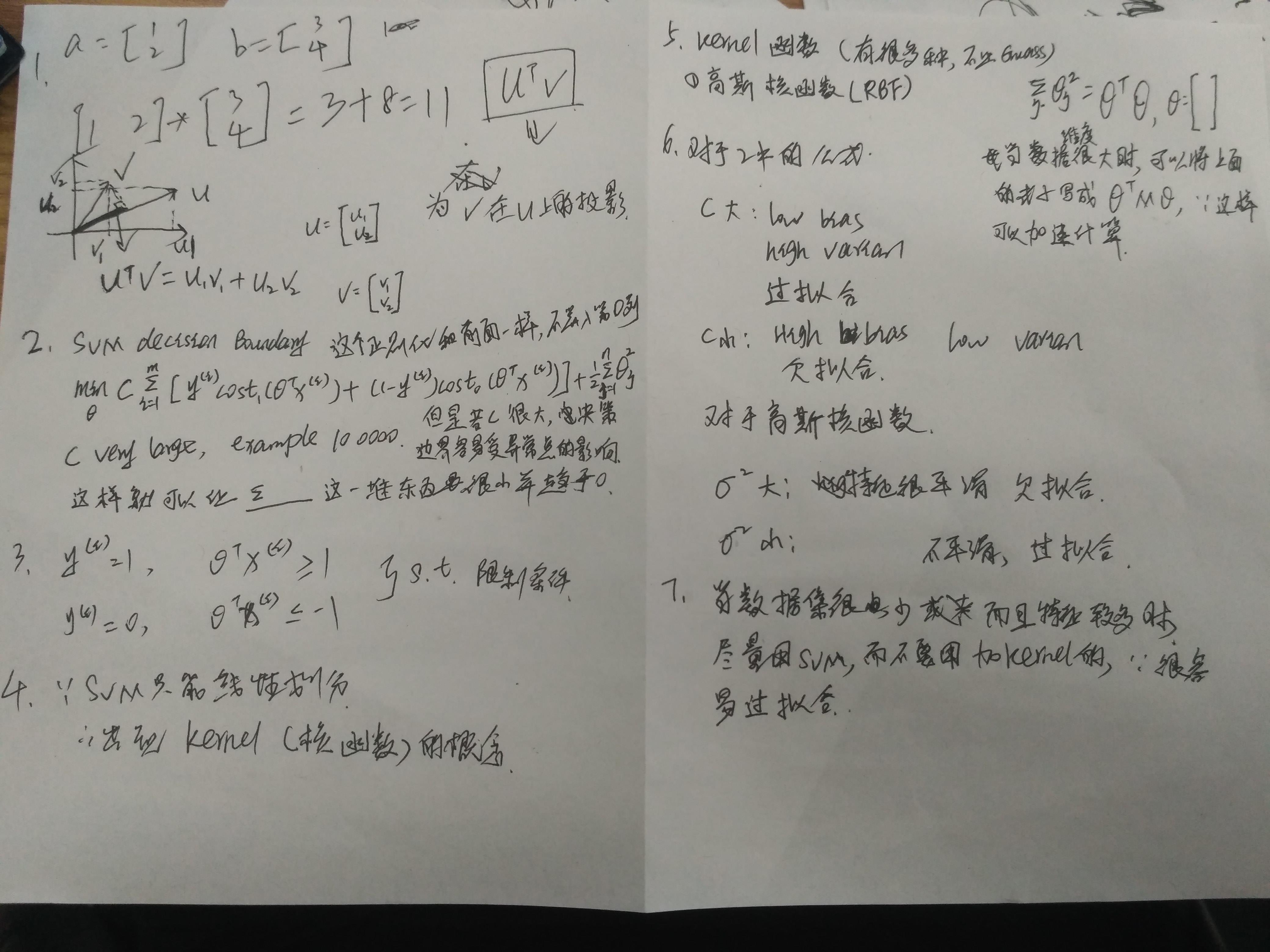

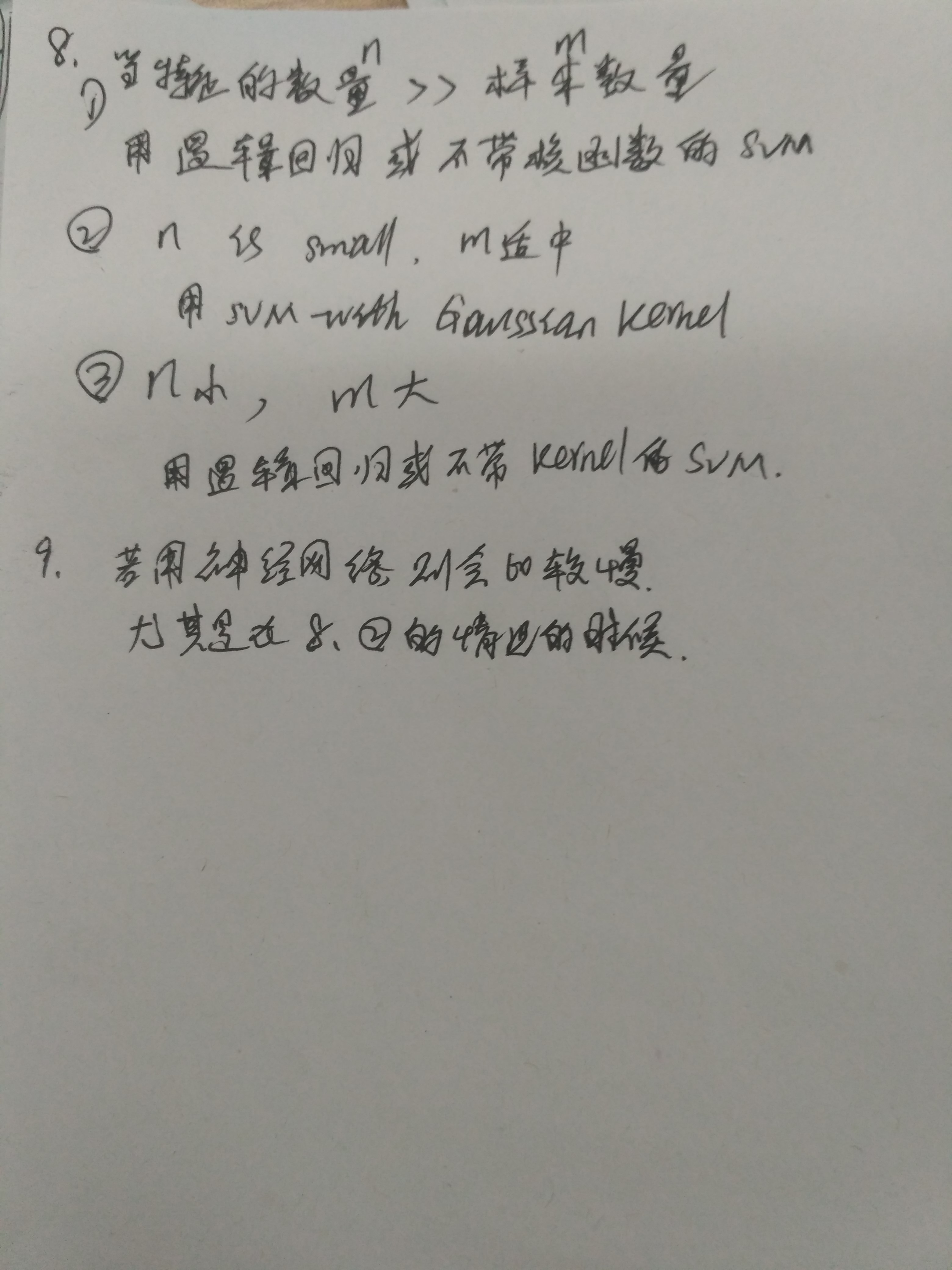

SVM的損失函式

一. 這個還要注意,他的正則化和普通的迴歸差不多,都是不考慮進去那個常數項

svm的原理是依據邏輯迴歸來的,在他的基礎上進行可一些修改和提煉(自己感覺的,不一定準確)

神經網路的偏置b也有點類似的思想

二.在加入核函式的時候,上面的損失函式就變成下面的樣子

(這個文章是參考Andrew'Ng 的)

這個時候原來的x變成了f,還有正則化不是原來的了,而是加入而M(和核函式有關係)

相關推薦

svm 損失函式以及其梯度推導

一般而言,score_matrix=WX W是係數矩陣,X是data_matrix,這兒是學習cs231n的筆記,為了與其程式碼內w,x的含義保持一致, 以下統一使用XW來計算score_matrix。背景是用svm實現圖片分類,輸入引數如下: N 代表樣品個數,D 代表畫素個數,C代表

CS231n——機器學習演算法——線性分類(中:SVM及其損失函式)

損失函式 Loss function 在線性分類(上)筆記中,定義了從影象畫素值到所屬類別的評分函式(score function),該函式的引數是權重矩陣W。 在函式中,資料 (

深度學習基礎--loss與啟用函式--合頁損失函式、摺頁損失函式;Hinge Loss;Multiclass SVM Loss

合頁損失函式、摺頁損失函式;Hinge Loss;Multiclass SVM Loss Hinge Loss是一種目標函式(或者說損失函式)的名稱,有的時候又叫做max-margin objective。用於分類模型以尋找距離每個樣本的距離最大的決策邊界,即最大化樣本和邊界之間的邊

"兩步走方法"解析損失函式:mean square error,cross entropy,softmax,SVM

本文試圖將四類最基礎也最常用的損失函式進行統一歸納,以明白各自的區別,加深對他們的記憶和理解。 本文會從兩個步驟分析損失函式,第一個是從輸入到模型的輸出,第二個是從模型的輸出到損失函式的計算。 第一個步奏,從輸入到模型的輸出。我先解釋一下什麼是模型的輸出。比如當我們訓練好了一個迴歸模型,

手推SVM(三)-軟間隔和損失函式的推導

軟間隔的提出 對偶問題及其化簡 引數的求解 引數的調優 1.軟間隔的提出 上一篇文章(手推SVM(二)-核方法 )我們用核方法來解決線性不可分問題,但如果即使對映到高維空間中,仍然有部分點不能完美的區分開呢? 如圖,無論核函式怎麼選取,都不

機器學習基礎(四十二)—— 常用損失函式的設計(multiclass SVM loss & hinge loss)

損失函式,又叫代價函式(成本函式,cost function),是應用優化演算法解決問題的關鍵。 1. 0-1 損失函式 誤分類的概率為: P(Y≠f(X))=1−P(Y=f(X)) 我們不妨記 m≜fθ(x)⋅y(其中 y∈{−1,1}。對於二分類

【深度學習CV】SVM, Softmax損失函式

Deep learning在計算機視覺方面具有廣泛的應用,包括影象分類、目標識別、語義分隔、生成影象描述等各個方面。本系列部落格將分享自己在這些方面的學習和認識,如有問題,歡迎交流。 在使用卷積神經網路進行分類任務時,往往使用以下幾類損失函式: 平

多類SVM的損失函式

原文:Multi-class SVM Loss 作者: Adrian Rosebrock 翻譯: KK4SBB 責編:何永燦 from: http://geek.csdn.net/news/detail/101547 幾個星期之前,我們討論了線性分類和引數化學

SVM的損失函式

一. 這個還要注意,他的正則化和普通的迴歸差不多,都是不考慮進去那個常數項svm的原理是依據邏輯迴歸來的,在他的基礎上進行可一些修改和提煉(自己感覺的,不一定準確)是最開始的學的預測函式,裡面含有常數項,也就是後來單獨添加了一列全為1的數值,但是在正則化的時候,要把它先

SVM分類器中損失函式梯度求法及理解

一、損失函式的計算公式: s(j)表示該類別錯誤分類為其他類別的估計分數。s(y(i))表示該類別正確的估值分數。這是基礎的概念。 上式還可以進一步

yolo v2 損失函式原始碼解讀

前提說明: 1, 關於 yolo 和 yolo v2 的詳細解釋請移步至如下兩個連結,或者直接看論文(我自己有想寫 yolo 的教程,但思前想後下面兩個連結中的文章質量實在是太好了_(:з」∠)_) yo

tensflow自定義損失函式

三、自定義損失函式 標準的損失函式並不合適所有場景,有些實際的背景需要採用自己構造的損失函式,Tensorflow 也提供了豐富的基礎函式供自行構建。 例如下面的例子:當預測值(y_pred)比真實值(y_true)大時,使用 (y_pred-y_true)*loss_more 作為 loss,

Tensorflow 兩個交叉熵損失函式的區別

tf.nn.sparse_softmax_cross_entropy_with_logits label:不含獨熱編碼,shape:[batch_size, ] logits:原始預測概率分佈向量,shape:[batch_size, num_classes] logits = np

神經網路的損失函式

損失函式可以分成兩大類:分類和迴歸。這裡我們對這兩類進行了細分和講解。 迴歸損失: L1loss(L1損失) L1損失,也稱平均絕對誤差(MAE),簡單說就是計算輸出值與真實值之間誤差的絕對值大小。這種度量方法在不考慮方向的情況下衡量誤差大小。和MSE的不同之處在於,MA

CS231n——機器學習演算法——線性分類(下:Softmax及其損失函式)

在前兩篇筆記中,基於線性分類上,線性分類中繼續記筆記。 1. Softmax分類器 SVM和Softmax分類器是最常用的兩個分類器,Softmax的損失函式與SVM的損失函式不同。對於學習過二元邏輯迴歸分類器的讀者來說,Softmax分類器就可以理解為邏輯迴歸分類器面對多個分類的一

【機器學習】一文讀懂機器學習常用損失函式

損失函式(loss function)是用來估量模型的預測值f(x)與真實值Y的不一致程度,它是一個非負實值函式,通常使用L(Y, f(x))來表示,損失函式越小,模型的魯棒性就越好。損失函式是經驗風險函式的核心部分,也是結構風險函式重要組成部分。模型的結構風險函式包括了經驗風險項和正則項,通常可以

損失函式的選擇

github部落格傳送門 csdn部落格傳送門 損失函式的迭取取決於輸入標籤資料的型別:如果輸入的是實數,無界的值,損失函式使用平方差;如果輸入的標籤是位向量(分類標誌)使用交叉熵會更合適 均值平方差(Mean Squared Error, MSE)也稱均方誤差 神經網路中:表達預測值與真實值之間的差異

最大似然損失和交叉熵損失函式的聯絡

在利用深度學習模型解決有監督問題時,比如分類、迴歸、去噪等,我們一般的思路如下: 資訊流forward propagation,直到輸出端; 定義損失函式L(x, y | theta); 誤差訊號back propagation。採用數學理論中的“鏈式法則”,求L(x,

損失函式震盪不收斂可能原因:tf.train.shuffle_batch

在製作tfrecords資料集的時候,比如說將cifar資料轉換成tfrecords資料集,一般會用到tf.train.shuffle_batch函式,而損失函式震盪不收斂的原因就可能就是資料集製作出現問題。 Cifar-10資料集包含了airlane、automobile、bi

交叉熵損失函式及Tensorflow實現

一、交叉熵損失原理 一般情況下,在分類任務中,神經網路最後一個輸出層的節點個數與分類任務的標籤數相等。 假設最後的節點數為N,那麼對於每一個樣例,神經網路可以得到一個N維的陣列作為輸出結果,陣列中每一個維度會對應一個類別。在最理想的情況下,如果一個樣本屬於k,那麼這個類別所對應的第k個輸出節