神經網路與BP演算法推導

導言

神經網路是深度學習基礎,BP演算法是神經網路訓練中最基礎的演算法。因此,對神經網路結構和BP演算法進行梳理是理解深度學習的有效方法。參考資料UFLDL,BP推導,神經網路教材。

神經網路結構

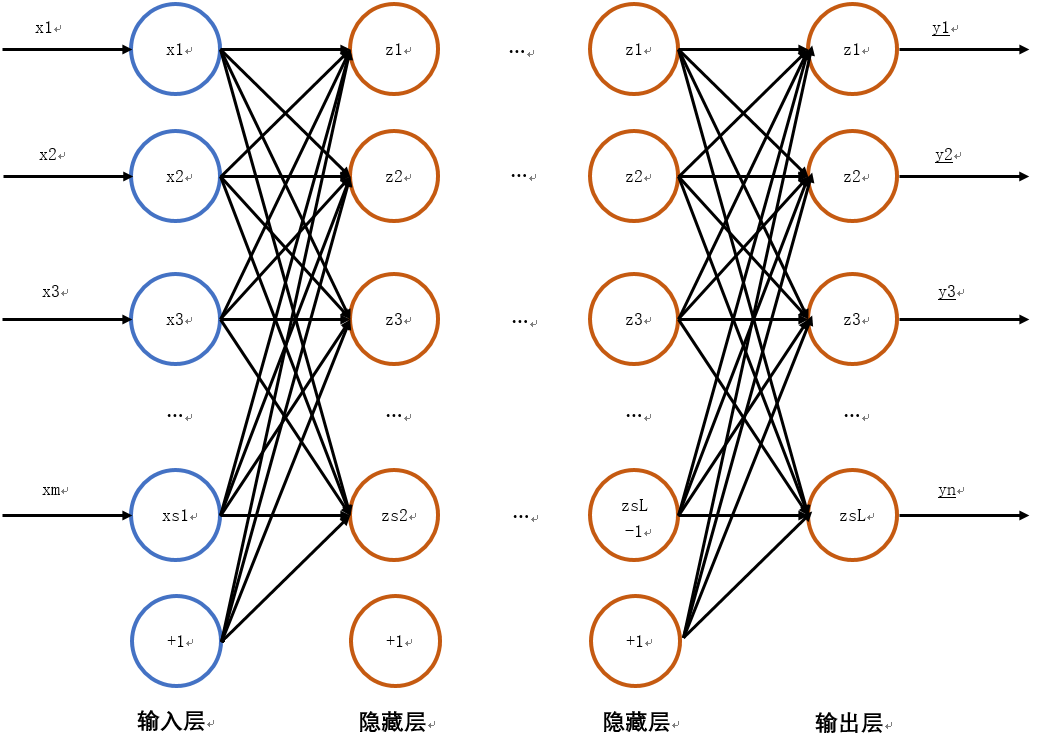

典型網路為淺層網路,一般2~4層。其結構如下圖所示:

假設神經網路有L層,第

用

相關推薦

神經網路與BP演算法推導

導言 神經網路是深度學習基礎,BP演算法是神經網路訓練中最基礎的演算法。因此,對神經網路結構和BP演算法進行梳理是理解深度學習的有效方法。參考資料UFLDL,BP推導,神經網路教材。 神經網路結構 典型網路為淺層網路,一般2~4層。其結構如下圖所示:

神經網路和BP演算法推導

我的原文:www.hijerry.cn/p/53364.htm… 感知機 感知機(perceptron)於1957年由Rosenblatt提出,是一種二分類線性模型。感知機以樣本特徵向量作為輸入,輸出為預測類別,取正、負兩類。感知機最終學習到的是將輸入空間(特徵空間)劃分為正、負兩類的分離超平面,屬於判別

神經網路中BP演算法的原理與用Python實現原始碼

(1)什麼是梯度下降和鏈式求導法則 1.梯度下降 假設我們有一個函式J(w),如下圖所示。 現在,我們要求當w等於什麼的時候,J(w)能夠取到最小值。從圖中我們知道最小值在初始位置的左邊,也就意味著如果想要使J(w)最小,w的值需要減小。而初始位置的切線斜率a>0

卷積神經網路反向BP演算法公式推導

博文轉載至:http://blog.csdn.net/celerychen2009/article/details/8964753 此篇博文只涉及到公式推導,如果想了解卷積神經網路的具體工作過程,可檢視轉載博文博主其它文件或者百度自己去看。轉載的文章涉及到的角下標大家注意下

神經網路和BP演算法

5. 神經網路 5.1 前向傳播 神經網路分為很多層,包括輸入層、輸出層和中間的隱層。 使用的符號如下: a(j)i a i

前向神經網路和 BP 演算法詳解 --- 之 DNN

前向神經網路和 BP 演算法詳解 一、神經網路的概念詳解 1.1、人工神經網路的基礎單元 — > 感知機 1.1.1、感知機模型講解 首先我們需要明確一點就是,針對於擁有核函式的 SVM 或者多隱層 + 啟用函式的多層神

西瓜書5.5 程式設計實現BP神經網路——標準BP演算法、累積BP演算法

這裡照著書上的公式,實現了一下標準BP演算法,和累積BP演算法,BP是error Back Propagation的意思,誤差逆傳播。BP網路通常是指用BP演算法訓練的多層前饋神經網路。程式碼是照著書本公式自己寫的,沒有參考網上的其他版本。 資料和程式碼地址:https:/

機器學習——神經網路累積BP演算法

在上篇的部落格介紹的“標準BP演算法”每次僅針對一個訓練樣例更新連線權和閾值,也就是說,BP演算法中的更新規則是基於單個的 推導而得,如果類似的推匯出基於累積誤差最小化的更新規則,就得到了累積誤差逆傳播

神經網路之BP演算法

文章轉載於http://www.cnblogs.com/charlotte77/p/5629865.html。 最近在看深度學習的東西,一開始看的吳恩達的UFLDL教程,有中文版就直接看了,後來發現有些地方總是不是很明確,又去看英文版,然後又找了些資料看,才發現,中文

多層前饋神經網路及BP演算法

1.多層前饋神經網路 首先說下多層前饋神經網路,BP演算法,BP神經網路之間的關係。多層前饋(multilayer feed-forward)神經網路由一個輸入層、一個或多個隱藏層和一個輸出層組成,後向傳播(BP)演算法在多層前饋神經網路上面進行學習,採用BP

前饋神經網路,BP演算法

單層感知機輸入層——>輸出層啟用函式在輸出層,常見啟用函式Logistic、softmax函式多層感知機(MLP)輸入層——>隱藏層——>輸出層啟用函式在隱藏層,線性變換預啟用+非線性啟用函式,資料分佈“線性可分”隱藏層所含神經元越多,可提取特徵越多常用啟用

機器學習總結(七):基本神經網路、BP演算法、常用啟用函式對比

1. 神經網路 (1)為什麼要用神經網路? 對於非線性分類問題,如果用多元線性迴歸進行分類,需要構造許多高次項,導致特徵特多學習引數過多,從而複雜度太高。 (2)常用的啟用函式及其優缺點 階

從 0 開始機器學習 - 神經網路反向 BP 演算法!

最近一個月專案好忙,終於擠出時間把這篇 BP 演算法基本思想寫完了,公式的推導放到下一篇講吧。 ## 一、神經網路的代價函式 神經網路可以看做是複雜邏輯迴歸的組合,因此與其類似,我們訓練神經網路也要定義代價函式,之後再使用梯度下降法來最小化代價函式,以此來訓練最優的權重矩陣。 ### 1.1 從邏輯迴歸

BP神經網路反向傳播演算法一步一步例項推導(Backpropagation Example)

1. loss 函式的優化 籠統來講: 設計loss函式是為了衡量網路輸出值和理想值之間的差距,儘管網路的直接輸出並不顯式的包含權重因子,但是輸出是同權重因子直接相關的,因此仍然可以將loss函式視作在權重因子空間中的一個函式。 可以將loss 記為E(w),這裡為

深度學習-神經網路 BP 演算法推導過程

BP 演算法推導過程 一.FP過程(前向-計算預測值) 定義sigmoid啟用函式 import numpy as np def sigmoid(z): return 1.0 / (1 + np.exp(-z)) 輸入層值和 標籤結果 l = [5.0, 10.0] y = [0.01,

機器學習之神經網路bp演算法推導

這是一篇學習UFLDL反向傳導演算法的筆記,按自己的思路捋了一遍,有不對的地方請大家指點。 首先說明一下神經網路的符號: 1. nl 表示神經網路的層數。 2. sl 表示第 l 層神經元個數,不包含偏置單元。 3. z(l)i 表示第 l 層第 i 個

BP神經網路,BP推導過程,反向傳播演算法,誤差反向傳播,梯度下降,權值閾值更新推導,隱含層權重更新公式

%% BP的主函式 % 清空 clear all; clc; % 匯入資料 load data; %從1到2000間隨機排序 k=rand(1,2000); [m,n]=sort(k); %輸入輸出資料 input=data(:,2:25); output1 =d

Python基於K-均值、RLS演算法實現RBF神經網路(神經網路與機器學習 第五章 計算機實驗)

1、生成資料集 class moon_data_class(object): def __init__(self,N,d,r,w): self.N=N self.w=w self.d=d self.r=r

演算法工程師之路——Deeplearning.ai神經網路與深度學習篇Week1

寫在前面——一點碎碎念 天將降大任於是人也,必先苦其心志,勞其筋骨,餓其體膚,空乏其身,行拂亂其所為。——《孟子•告子下》 塵埃落定,在好好學(wan)習(shua)三年之後,我成功僥倖收穫了的UESTC MSE的Offer,心裡萬分激動,想著B

演算法工程師之路——Deeplearning.ai神經網路與深度學習篇Week3

上一週的回顧 過去的一週真的發生了很多意想不到、驚心動魄的事情,從大學四年最後一次體測到唐獎競爭,從小IG力挽狂瀾到RNG遺憾折戟,生活可謂是充滿了無數的可能。也正是因為這樣,我們的生活才不至於那麼乏味,像工廠流水線生產一樣標準化、制度化,而隨時都可