tensorflow例項:實現word2vec語言模型

版本說明

———-這次我不會忘記要寫版本了分割線~

python:python3.5

tensorflow:tensorflow-0.12.1

numpy+mkl:numpy-1.11.3+mkl

matplotlib:matplotlib-2.0.0

sklearn:scikit_learn-0.18.1

scipy:scipy-0.19.0

注:雖然程式碼裡沒有直接使用scipy和mkl,但是是sklearn的依賴,也是要下載安裝好的。

匯入的包

資料來源

本次實驗用到的資料來源是網上下載的哈利波特1-7,經過去符號處理,只留下了單詞序列

程式碼

結果

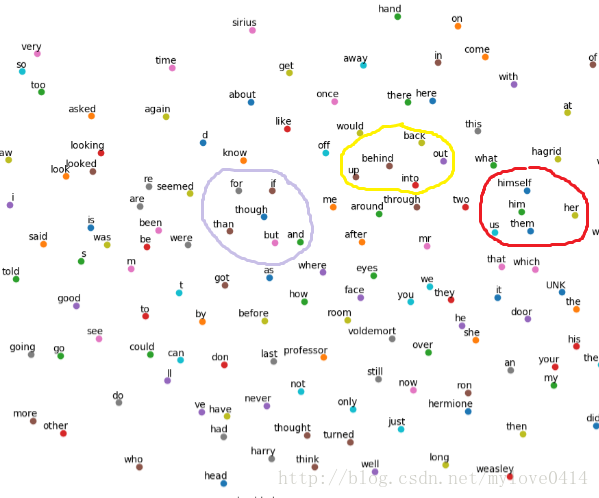

嗯哼,做了word2vec有什麼效果呢?

效果在這裡

實驗取了單詞頻數top150成圖,這裡截取了一部分。

可以看到,黃色圈出來的back,out,behind,into,up距離比較近,himself,her,him,them,us聚在一起,還有for,though,than,but,and這些聚在一起。

當然,迭代次數多一些,效果可能會更棒。

說明

程式碼參考了Tensorflow實戰 黃文堅 唐源著

相關推薦

tensorflow例項:實現word2vec語言模型

版本說明 ———-這次我不會忘記要寫版本了分割線~ python:python3.5 tensorflow:tensorflow-0.12.1 numpy+mkl:numpy-1.11.3+mkl matplotlib:matplotlib-2.0

Tensorflow例項:實現AlexNet

AlexNet以顯著的優勢贏得了ILSVRC 2012比賽的冠軍,可以說是神經網路在低谷期後的第一次發聲,確立了深度學習在計算機視覺的統治地位,同時也推動了深度學習在語音識別、自動語言處理、強化學習等領域的擴充套件。 AlexNet將LeNet的思想發揚光大,

Tensorflow例項:實現簡單的卷積神經網路

CNN最大的特點在於卷積的權值共享結構,可以大幅減少神經網路的引數量,防止過擬合的同時又降低了神經網路模型的複雜度。在CNN中,第一個卷積層會直接接受影象畫素級的輸入,每一個卷積操作只處理一小塊影象,進行卷積變化後再傳到後面的網路,每一層卷積都會提取資料中最有效

Tensorflow例項:(卷積神經網路)LeNet-5模型

通過卷積層、池化層等結構的任意組合得到的神經網路有無限多種,怎樣的神經網路更有可能解決真實的影象處理問題?本文通過LeNet-5模型,將給出卷積神經網路結構設計的一個通用模式。 LeNet-5模型 LeNet-5模型是Yann LeCun教授於1998年

綜合例項:用C語言實現一個自定義的shell程式

一個shell需要實現若干功能,比如解釋執行命令,支援輸入輸出重定向,支援管道,後臺執行程式等。首先對要實現的功能做一個簡要介紹: (1)輸出重定向:就是把執行某命令後的結果輸出到某個檔案。例如: ls -al > list.txt

Word2Vec-語言模型的前世今生

ace 分析 相關性 語音 集中 媒體 任務 統計語言模型 pascal 引言 在機器學習領域,語言識別和圖像識別都比較容易做到。語音識別的輸入數據可以是音頻頻譜序列向量所構成的matrix,圖像識別的輸入數據是像素點向量構成的矩陣。但是文本是一種抽象的東西,顯然不能直接

No.2 Pytorch 實現RNN語言模型

最近使用Pytorch,搭建了一個RNNLM,目的是為了利用詞典中的每個詞的One-Hot編碼(高維的稀疏向量),來生成 Dense Vectors。這篇文章不講解RNN原理以及為什麼使用RNN語言模型,只是對pytorch中的程式碼使用進行講解。 目前Pyt

微信小程式例項:實現tabs選項卡效果

最近微信應用號是炒的如火如荼,熱門滿滿,但是也可以發現搜尋關鍵詞出來,各類網站出現的還都是微信的官方文件解釋。正好趕上這個熱潮,這幾天先把小程式技術文件看了個遍,就直接著手寫案例了。很多元件微信內部已經封裝完了,正好發現沒有tab選項卡效果,這兩天正好研究了下。

人工智慧深度學習-Tensorflow例項:利用LSTM預測股票每日最高價

LSTM全稱長短期記憶人工神經網路(Long-Short Term Memory),是對RNN的變種。舉個例子,假設我們試著去預測“I grew up in France… 中間隔了好多好多字……I speak fluent __”下劃線的詞。我們拍腦瓜子想這個詞應該是French。對於迴圈神經網路

Tensorflow例項:利用LSTM預測股票每日最高價(二)

根據股票歷史資料中的最低價、最高價、開盤價、收盤價、交易量、交易額、跌漲幅等因素,對下一日股票最高價進行預測。 實驗用到的資料長這個樣子: label是標籤y,也就是下一日的最高價。列C——I為輸入特徵。 本例項用前5800個數據做訓練資料。

NLP:NLM-神經語言模型

文章:自然語言處理模型;經過幾天對nlp的理解,接下來我們說說語言模型,下面還是以PPT方式給出。 一、統計語言模型 1、什麼是統計語言模型? 一個語言模型通常構建為字串s的概率分佈p(s),這裡的p(s)實際上反映的是s作為一個句子出現的概率。 這裡的概率指的是組

Tensorflow例項:利用LSTM預測股票每日最高價(一)

這一部分主要涉及迴圈神經網路的理論,講的可能會比較簡略。 什麼是RNN RNN全稱迴圈神經網路(Recurrent Neural Networks),是用來處理序列資料的。在傳統的神經網路模型中,從輸入層到隱含層再到輸出層,層與層之間是全連線的,每層之間

TensorFlow實現經典深度學習網路(5):TensorFlow實現自然語言處理基礎網路Word2Vec

TensorFlow實現經典深度學習網路(5):TensorFlow實現自然語言處理 基礎網路Word2Vec 迴圈神經網路RNN是在自然語言處理NLP領域最常使用的神經網路結構,和卷積神經網路在影象識別領域的地位相似,影響深遠。而Word2Vec則是將語

R語言:實現文字分析例項(基礎篇)

#1載入軟體包: #1.1資料欲處理包: #Snowball(處理帶空格的語句) #rJava(rmmseg4j的支援包) #rmmseg4j(處理中文的分詞,把不帶空格的分為帶空格的。) #1.2文字分析包: #tm #資料處理## library (RODBC) excel_file <- od

TensorFlow 實現基於LSTM的語言模型

一、LSTM的相關概念部落格上有很多講解的很好的博主,我看的是這個博主的關於LSTM的介紹,感覺很全面,如果對LSTM原理不太明白的,可以點選這個連結。LSTM相關概念,這裡就不多做介紹了哈!二、GRU介紹這裡為什麼要介紹下GRU呢!因為在RNN的各種變種中,除了LSTM,另

python應用例項:座標轉換——基於布林莎模型,可實現BJ54座標系/GSC2000座標系/WGS84等各種地心直角座標系的轉換

博主準研究僧一枚,假期在老師指導下接觸專案。本博文可作為座標轉換,特別是布林莎七引數法的學習資料。其python原始碼註釋充分,也可作為python的學習專案。程式UI介面如下,由於是自用程式,博主對美化UI不感興趣,ui部分原始碼註釋充分,顏控可自行修改調整。PS:克總信徒

SPARK官方例項:兩種方法實現隨機森林模型(ML/MLlib)

在spark2.0以上版本中,存在兩種對機器學習演算法的實現庫MLlib與ML,比如隨機森林:org.apache.spark.mllib.tree.RandomForest 和org.apache.spark.ml.classification.RandomForestCl

自然語言處理中傳統詞向量表示VS深度學習語言模型(三):word2vec詞向量

在前面的部落格中,我們已經梳理過語言表示和語言模型,之所以將這兩部分內容進行梳理,主要是因為分散式的詞向量語言表示方式和使用神經網路語言模型來得到詞向量這兩部分,構成了後來的word2vec的發展,可以說是word2vec的基礎。1.什麼是詞向量

tensorflow17《TensorFlow實戰Google深度學習框架》筆記-08-02 使用迴圈神經網路實現語言模型 code

00 reader.py # Copyright 2015 The TensorFlow Authors. All Rights Reserved. # # Licensed under the Apache License, Version 2.0 (the

利用Tensorflow實現神經網絡模型

flow one 什麽 hold test ase tensor dom def 首先看一下神經網絡模型,一個比較簡單的兩層神經。 代碼如下: # 定義參數 n_hidden_1 = 256 #第一層神經元 n_hidden_2 = 128 #第