線性判別分析LDA(Linear Discriminant Analysis)

1、簡介

大家熟知的PCA演算法是一種無監督的降維演算法,其在工作過程中沒有將類別標籤考慮進去。當我們想在對原始資料降維後的一些最佳特徵(與類標籤關係最密切的,即與

2、LDA演算法(二類情況)

給定特徵為

現在我們想將

樣例

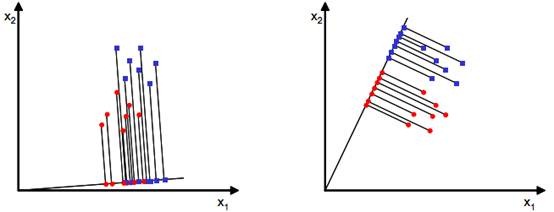

我們的目的是尋找一條從原點出發方向為$w$的直線,可以將投影后的樣例點很好的分離,大概如下圖所示:

從直觀上來講,第二條直線看起來還不錯,可以很好地將兩類樣例分離,那這條直線是不是我們所要找的最佳的直線呢?要回答這個問題,我們就要從定量的角度來確定最佳的投影直線,即直線的方向向量

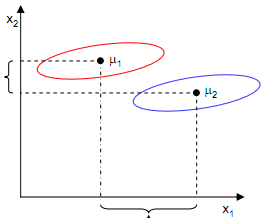

首先求每類樣例的均值(中心點):

那麼投影后的每類樣例的均值(中心點)為:

從上面兩條公式可以看出,投影后的中心點就是中心點的投影。

從上面兩張圖可以看出,能夠使投影后的兩類樣本中心點儘量分離的直線是好的直線,定量表示就是:

儘管在

LDA是基於Fisher準則的演算法,其必須同時遵從類內密集,類間分離這兩個條件。中心點投影間距最大化只是滿足類間分離

每個類別的雜湊值定義如下:

有了雜湊值,我們得以滿足Fisher準則的類內密集的要求,結合最大化中心點的投影間距,我們可以提出最終的度量公式:

將雜湊值的公式展開可得:

1、簡介

大家熟知的PCA演算法是一種無監督的降維演算法,其在工作過程中沒有將類別標籤考慮進去。當我們想在對原始資料降維後的一些最佳特徵(與類標籤關係最密切的,即與y相關),這個時候,基於Fisher準則的線性判別分析LDA就能派上用場了。注意,LDA是一種有

線性判別式分析(Linear Discriminant Analysis, LDA),也叫做Fisher線性判別(Fisher Linear Discriminant ,FLD),是模式識別的經典演算法,它是在1996年由Belhumeur引入模式識別和人工智慧領域的。性鑑別

4. 例項

將3維空間上的球體樣本點投影到二維上,W1相比W2能夠獲得更好的分離效果。

PCA與LDA的降維對比:

PCA選擇樣本點投影具有最大方差的方向,LDA選擇分類效能最好的方向。

LDA既然叫做線性判別分析,應該具有一定的預 png 數學 坐標軸 ima 特征 分析 技術 數據預處理 距離 Linear Discriminant Analysis(LDA線性判別分析)

用途:數據預處理中的降維,分類任務

目標:LDA關心的是能夠最大化類間區分度的坐標軸成分,將特征空間(數據集中的多維樣本

LDA用於分類問題上,在給定一個樣本的情況下,將樣例投影到一條直線上,使得同類樣例的投影點儘可能接近,異類樣例的投影點儘可能遠離。那麼對於一個新的樣本,只要將其投影到這條直線上再根據投影點的位置即可完成分類。

線性判別分析LDA

為了最優分類,我們要計算後驗概率P(G|X)。設fk(x)是類G=k中X的類條件密度,而πk是類k的先驗概率,貝葉斯定理給出

P(G=k|X=x)=fk(x)πk∑Kl=1fl(x)πl

假定我們用多元高斯分佈對每個類密度建模

上一篇寫過線性判別分析處理二分類問題https://blog.csdn.net/z962013489/article/details/79871789,當使用LDA處理多分類問題時,通常是作為一個降維工具來使用的。若我們有一個D維的樣本集,該樣本集包含C個類別共

在主成分分析(PCA)原理總結中,我們對降維演算法PCA做了總結。這裡我們就對另外一種經典的降維方法線性判別分析(Linear Discriminant Analysis, 以下簡稱LDA)做一個總結。LDA在模式識別領域(比如人臉識別,艦艇識別等圖形影象識別領域)中有非常

高斯判別模型,內容其實非常簡單

對於大多數模型,無非就是做這麼幾件事情

1.假設模型

2.設定引數,表示概率

3.用最大似然,通過樣本算出引數

4.用得到的引數,再去測試資料裡計算概率

高斯模型判別是是這樣,因為是判別嗎,所以我們就把判別結果用0,1兩種結果來表 大小 限制 總結 情況 pca 空間 會有 ges nal 1. 問題

真實的訓練數據總是存在各種各樣的問題: 1、 比如拿到一個汽車的樣本,裏面既有以“千米/每小時”度量的最大速度特征,也有“英裏/小時”的最大速度特征,

原文地址

LDA演算法入門

一. LDA演算法概述:

線性判別式分析(Linear Discriminant Analysis, LDA),也叫做Fisher線性判別(Fisher Linear Discriminant ,FLD),是模式識別的經典演算法,它是

綜述

線性判別分析 (LDA)是對費舍爾的線性鑑別方法(FLD)的歸納,屬於監督學習的方法。LDA使用統計學,模式識別和機器學習方法,試圖找到兩類物體或事件的特徵的一個線性組合,以能夠特徵化或區分它們。所得的組合可用來作為一個線性分類器,或者,更常見的是,為後

線性判別分析(Linear Discriminant Analysis)降維演算法

機器學習分為監督學習、無監督學習和半監督學習(強化學習)。無監督學習最常應用的場景是聚類(clustering)和降維(dimension reduction)。聚類演算法包括

1.線性判別原理解析

基本思想是”投影”,即高緯度空間的點向低緯度空間投影,從而簡化問題的處理.在原座標系下,空間中的點可能很難被分開,如圖8-1,當類別Ⅰ和類別Ⅱ中的樣本點都投影至圖中的”原

內容目錄: 一、LDA/fisher判別分析 二、LDA判別分析與PCA對比

一、fisher判別分析

1.首先在模式識別課程上學習的是fisher判別,LDA概念是看川大同學寫的500問接觸的,兩者是一樣的東西。 2推薦:深度學習500問 github連結形式是問答形式,初學者概念

前言

在主成分分析(PCA)原理總結(機器學習(27)【降維】之主成分分析(PCA)詳解)中對降維演算法PCA做了總結。這裡就對另外一種經典的降維方法線性判別分析(Linear Discriminant Analysis, 簡稱LDA)做一個總結。LDA在模式識別領域(比如

本博文為Fisher分類器的學習筆記~本博文主要參考書籍為:《Python大戰機器學習》Fisher分類器也叫Fisher線性判別(Fisher Linear Discriminant),或稱為線性判別分析(Linear Discriminant Analysis,LDA)。

本文為筆者在學習周志華老師的機器學習教材後,寫的課後習題的的程式設計題。之前放在答案的博文中,現在重新進行整理,將需要實現程式碼的部分單獨拿出來,慢慢積累。希望能寫一個機器學習演算法實現的系列。

本文主要包括:

1、logistics迴歸

2、線性判別分析(LDA)

使 至少 最大化 算法 標準 之前 協方差矩陣 一個 滿足 這不 在主成分分析(PCA)原理總結中,我們對降維算法PCA做了總結。這裏我們就對另外一種經典的降維方法線性判別分析(Linear Discriminant Analysis, 以下簡稱LDA)做一個總結。LDA在模式

通過圖中對比兩種演算法的卻別,噪聲特徵對樣本數的比值越來越大時普通lda分類效果越來越低,而shrinkage lda 下降並不多。

程式碼中有效特徵只有一個,其他都是噪音特徵

from __future__ import division

相關推薦

線性判別分析LDA(Linear Discriminant Analysis)

線性判別分析(Linear Discriminant Analysis)

線性判別分析(Linear Discriminant Analysis)(二)

線性判別分析(Linear Discriminant Analysis-LDA)

線性判別分析((Linear Discriminant Analysis,LDA)

線性判別分析(Linear Discriminant Analyst)

線性判別分析(LDA)和python實現(多分類問題)

線性判別分析LDA原理總結

高斯判別分析模型The Gaussian Discriminant Analysis model

【機器學習】主成分分析PCA(Principal components analysis)

線性判別分析(Linear Discriminant Analysis, LDA)演算法分析

線性判別分析(Linear Discriminant Analysis, LDA) 學習筆記 + matlab實現

ML-64: 機器學習之線性判別分析(Linear Discriminant Analysis)降維演算法+程式碼

R語言分類演算法之線性判別分析(Linear Discriminant Analysis)

【機器學習】LDA(線性判別分析)或fisher判別分析

線性判別分析(LDA)基本原理及實現

機器學習筆記之(4)——Fisher分類器(線性判別分析,LDA)

機器學習演算法的Python實現 (1):logistics迴歸 與 線性判別分析(LDA)

線性判別分析(LDA)原理

正常和縮減線性判別分析用於分類的區別(LDA 和 Shrinkage LDA)