矩陣求導

矩陣求導

相關推薦

矩陣求導

logs log nbsp 圖片 分享圖片 https 矩陣 ima bsp 矩陣求導

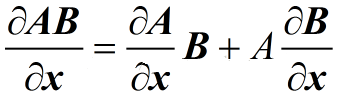

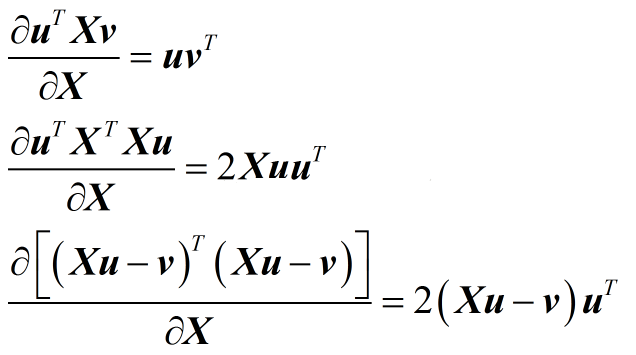

矩陣求導法則

body com mage 9.png img oat right http 技術 矩陣求導法則

線性迴歸 矩陣求導

一種方便區別是概率還是似然的方法是,根據定義,"誰誰誰的概率"中誰誰誰只能是概率空間中的事件,換句話說,我們只能說,事件(發生)的概率是多少多少(因為事件具有概率結構從而刻畫隨機性,所以才能談概率);而"誰誰誰的似然"中的誰誰誰只能是引數,比如說,引數等於 時的似然是多少

矩陣求導(下)——矩陣對矩陣的求導

參考:https://zhuanlan.zhihu.com/p/24863977 本篇使用小寫字母x表示標量,粗體小寫字母 x \boldsym

矩陣求導(上)——標量對矩陣的求導

參考:https://zhuanlan.zhihu.com/p/24709748 這部分內容分兩篇整理,上篇講標量對矩陣的求導,下篇講矩陣對矩陣的求導。 本文使用小寫字母x表示標量,粗體小寫字母

矩陣求導例項

前提及說明 第一次遇見矩陣求導,大多數人都是一頭霧水,而搜了維基百科看也還是雲裡霧裡,一堆的名詞和一堆的表格到底都是什麼呢?這裡總結了我個人的學習經驗,並且通過一個例子可以讓你感受如何進行矩陣求導,下次再遇到需要進行矩陣求導的地方就不

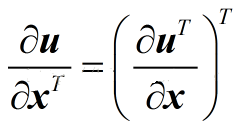

矩陣求導與轉置運算

線性代數補充 矩陣轉置 矩陣求導 前言:在推導演算法過程中遇到一些數學運算,遇到了就記錄下,方便回憶 矩陣轉置 (

矩陣求導與投影梯度相關問題

參考\url{https://www.zhihu.com/question/39523290} 豬豬專業戶 77IX7-UPIUE-7PR75-UTBLT 如果題主學過泛函分析,可能會更容易理解矩陣對矩陣的求導。 定義:假設$X$和$Y$為賦範向量空間, $F: X\rightarrow Y$是

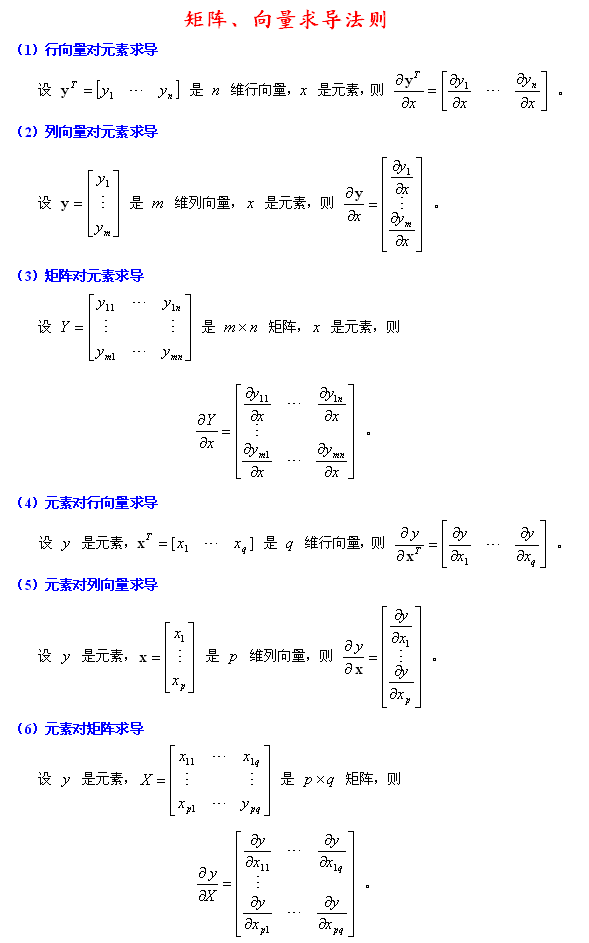

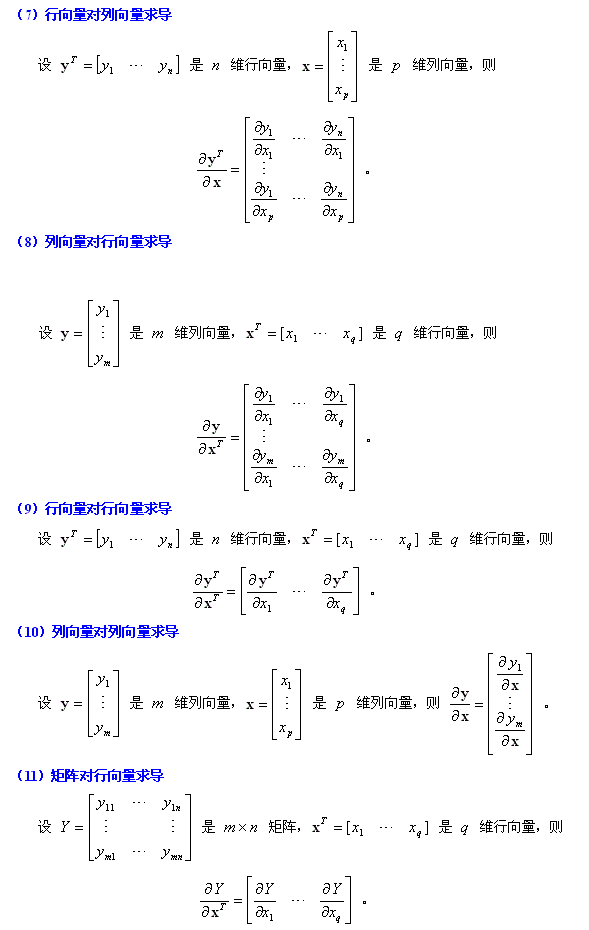

神經網路的反向傳播演算法中矩陣的求導方法(矩陣求導總結)

前言 神經網路的精髓就是反向傳播演算法,其中涉及到一些矩陣的求導運算,只有掌握了與矩陣相關的求導法則才能真正理解神經網路. 與矩陣有關的求導主要分為兩類: 標量 f 對 矩陣 W的導數 (其結果是和W同緯度的矩陣,也就是f對W逐元素求導排成與W尺寸相同的矩陣

神經網路中矩陣求導術的應用

序 本文假設讀者熟悉一元微積分,線性代數,並已經學習過矩陣求導術:知乎專欄. 在神經網路中,矩陣求導術發揮的最重要的作用便是求losslossloss對某個引數的梯度. 比如在多層神經網路(MLP)中,某一層的推導公式為al+1=g(Wal+b)a^{l+1}

線性迴歸 矩陣求導

一種方便區別是概率還是似然的方法是,根據定義,"誰誰誰的概率"中誰誰誰只能是概率空間中的事件,換句話說,我們只能說,事件(發生)的概率是多少多少(因為事件具有概率結構從而刻畫隨機性,所以才能談概率);而"誰誰誰的似然"中的誰誰誰只能是引數,比如說,引數等於 時的似然是多少

機器學習---迴歸預測---向量、矩陣求導

梯度 對於 ,可以通過下面的向量方程來表示梯度: 佈局約定 向量關於向量的導數:即 ,如果分子y 是m維的,而分母x 是n維的: 分子佈局(Jacobian 形式),即按照y列向量和x橫向量. (得到m×n矩陣:橫向y1/x1 y1/x2 y1/x3

反向傳播演算法中的矩陣求導

反向傳播中的梯度 計算圖 矩陣求導 多條連結 在神經網路演算法中,可以把複雜的網路結構看作一個複合函式。即用一個函式表徵輸入與輸出之間的關係。誤差的反向傳遞,提供了確定這個函式的方法。這裡的誤差,指的就是梯度。所以,BP演

矩陣求導公式總結

今天推導公式,發現居然有對矩陣的求導,狂汗--完全不會。不過還好網上有人總結了。吼吼,趕緊搬過來收藏備份。 基本公式: Y = A * X --> DY/DX = A' Y = X * A --> DY/DX = A Y = A' * X * B -->

矩陣求導學習筆記(一)

總的來說,涉及矩陣和向量的求導不外乎五大類別,- 向量對標量- 標量對向量- 向量對向量- 矩陣對標量- 標量對矩陣向量對標量求導分子佈局向量y--->標量x求導,我們假定所有的向量都是列向量,在

矩陣求導術(上)

法則 復雜 image 技術 新的 lan 深度學習 ice 真的是 深度學習我認為最核心的被部分,是求導,更新的這個過程! 這裏涉及的矩陣求導,我覺得很復雜,看了很多的方法,記憶法則,真的是越看越不懂! 清華那本書,也是太龐大了。 學習大佬這個矩陣求導術方法,矩陣求導,算

矩陣求導、幾種重要的矩陣及常用的矩陣求導公式

一、矩陣求導 一般來講,我們約定x=(x1,x2,...xN)Tx=(x1,x2,...xN)T,這是分母佈局。常見的矩陣求導方式有:向量對向量求導,標量對向量求導,向量對標量求導。 1、向量對

機器學習常見的矩陣求導總結

常見求導公式 1.∂(xTAx)∂x=(AT+A)x,x為向量 2.∂tr(XTX)∂X=2X,X為矩陣 3. ∂tr(XTAX)∂X=(A+AT)X,X為向量 4. ∂tr(ATB)∂A=B,X為向量 5. ∂tr(X)X=I,X為向量 6. ∂

(Math)矩陣求導

前言 本文為維基百科上矩陣微積分部分的翻譯內容。本文為原文的翻譯與個人總結,非一一對照翻譯。由於水平不足理解不夠處,敬請原諒與指出。原文地址https://en.wikipedia.org/wiki/Matrix_calculus。原文為矩陣微積分,

矩陣求導(一)

矩陣求導術(上) 矩陣求導的技術,在統計學、控制論、機器學習等領域有廣泛的應用。鑑於我看過的一些資料或言之不詳、或繁亂無緒,本文來做個科普,分作兩篇,上篇講標量對矩陣的求導術,下篇講矩陣對矩陣的求導術。本文使用小寫字母x表示標量,粗體小寫字母x 表示向量,