羅德里格斯公式推導

阿新 • • 發佈:2018-11-30

引言

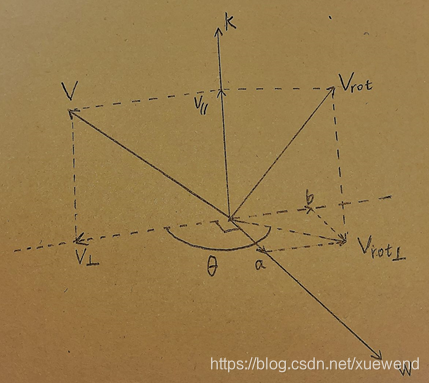

k為單位向量,向量v繞旋轉軸k旋轉Θ得到向量vrot, 那麼就有下面的旋轉方程使等式成立:

vrot = Rv

而這個旋轉方程就是羅德里格斯方程:

R=cosΘ I + (1 - cosΘ )kkτ + sinΘK

下面開始推導:

推導:

向量分解 ,

v // = (v•k)k (向量點乘得標量,k為單位向量)

vrot = vrot⊥ + v //

vrot⊥ = a + b

由圖中的向量關係可得:b= cosΘ v⊥ a=sinΘ k x v

vrot = vrot⊥+v//

= a + b + v//

= sinΘ k x v + cosΘ v⊥ + (v • k)k

= sinΘ k x v + cosΘ (v - v//)+ (v • k)k

= sinΘ k x v + cosΘ (v - (v • k)k)+ (v • k)k

= cosΘ v + (1 - cosΘ )(v • k)k + sinΘ k x v

所以:

cosΘ v + (1 - cosΘ )(v • k)k + sinΘ k x v

= cosΘ v + (1 - cosΘ )kkτv + sinΘKv

=( cosΘ I + (1 - cosΘ )kkτ + sinΘK ) v

=Rv