貝葉斯網路Bayesian network基礎理論及演算法介紹

阿新 • • 發佈:2018-12-06

引言

貝葉斯網路

Bayesian network

belief network

directed acyclic graphical model

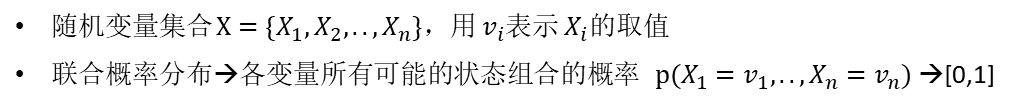

藉由DAGs(有向無環圖)得到一組隨機變數{X1, X2, …, Xn}及其n組條件概率分佈(conditional probability distributions,or CPDs)。

聯合概率分佈

- 聯合分佈通常表示為一張表,包含狀態組合個數

- 如:I:學生智力 D:試卷難度 G:成績等級

條件概率分佈、邊緣分佈

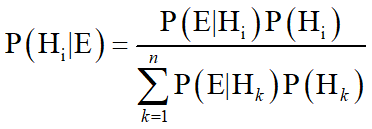

貝葉斯定理

- 基本思想:

通過先驗概率和類條件概率表示式,計算後驗概率。 - 先驗概率:

指在得到任何新證據之前,統計的事件概率——即非條件概率; - 後驗概率:

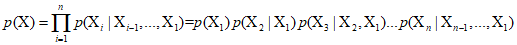

考慮給定新證據之後,統計的事件概率——即條件概率,P(事件|證據)。 - 鏈式規則

- 貝葉斯定理鏈式法則(考慮多個證據)

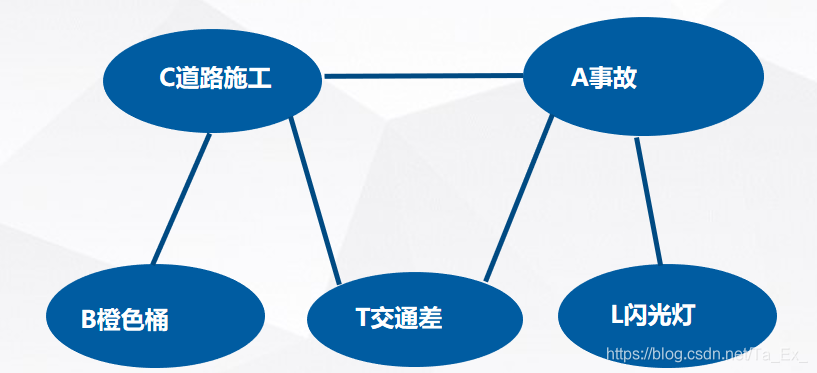

貝葉斯網路 B(G,P)

- G:有向無環圖 (Directed Acyclic Graph)

- P:條件概率表(Conditional Probability Table)

- 節點——代表隨機變數

- 有向邊——代表節點間的(因果/依賴)關係,且存在條件概率表達這種關係的強度

- 每個節點有一個概率分佈:非根節點->條件概率;沒有父節點的根節點->先驗概率

利用條件獨立降低計算複雜度

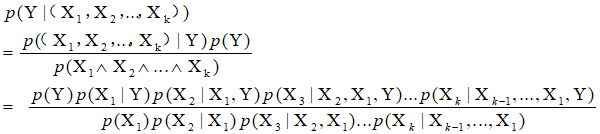

- 條件獨立性可以由圖的結構判定

- 有向分離法(D-separation)

- 在V型結構(匯合連線)兩個父節點間加上一條無向邊

- 將所有有向邊改為無向邊

- 有向分離:將變數集合{ zi }去掉後,x與y不連通,則在{ zi }一定的情況下,x與y相互獨立。

學習演算法

結構學習

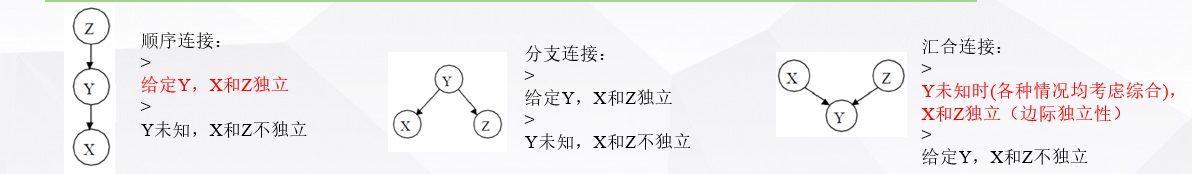

基於專家

通常在故障診斷領域內,通常由專家給出隨機變數的因果圖,得到BN結構

基於資料:

訓練資料集找到結構最恰當的網路

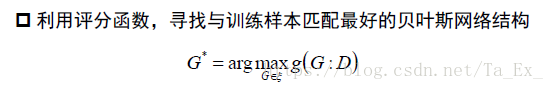

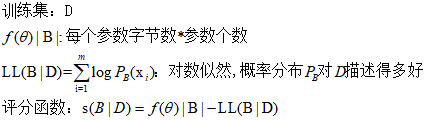

基於評分函式

- K2評分函式,資料服從多項式分佈,Cooper and Herskovits

- BD評分函式,資料符合dirichlet分佈,Heckerman

“最小描述長度”(Minimal Description Length, MDL)準則,看作資料壓縮任務。

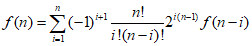

對於n個變數,可能的結構數目

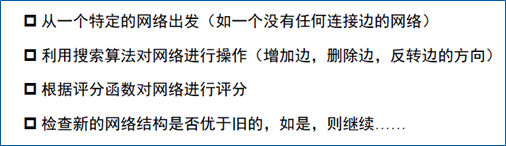

近似求解:貪心演算法

近似求解:半樸素貝葉斯

基於依賴關係(基於條件獨立性)

識別節點間(條件)獨立性關係,適用於結構稀疏的網路結構學習。

引數學習

學習節點的分佈引數,即每條邊對應的條件概率分佈

- 極大似然法

假設的概率分佈形式(概率密度函式)是否符合真實資料分佈 對準確性影響很大 - 貝葉斯分類器

- 樸素貝葉斯

假設屬性獨立地對分類效果產生影響,“屬性條件獨立性假設” - 半樸素貝葉斯

常用獨依賴估計:在類別之外最多僅依賴一個其他屬性 - 樸素貝葉斯和半樸素貝葉斯

推理演算法

已知變數觀測值(證據),通過計算回答 查詢

- 因果推理(自頂而下)

- 診斷推理(自頂而上)

- 支援推理:分析原因之間的相互影響,提供一些解釋

規模較小、不要求推理效率,精確:如聯結樹演算法

網路節點眾多、連線稠密、規模大,NP難,近似:如隨機抽樣演算法

馬爾科夫鏈蒙特卡洛(Markov chain Monte Carlo, MCMC)——Gibbs演算法

某個概率分佈隨機抽樣,生成一組樣本,然後從樣本出發近似估計要計算的量