多元線性迴歸中最優迴歸係數推導過程

背景

**

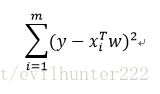

問題的背景是從大量資料中求出迴歸方程,常用的方法就是找出誤差最小的w(存放回歸係數的向量)。一般採用的方法是下圖即平方誤差(這裡X是n*p的矩陣,y是n*1的結果向量,w便是p*1的迴歸係數向量),求和公式是誤差項的平方值,我們需要做的就是取求和公式最小值下的w

用矩陣表示還可以寫作

下面也就是對上述公式進行求導,令其導數等於0,所得w即為最優迴歸引數

**

求導過程

**

敲公式太麻煩就放了張手寫圖

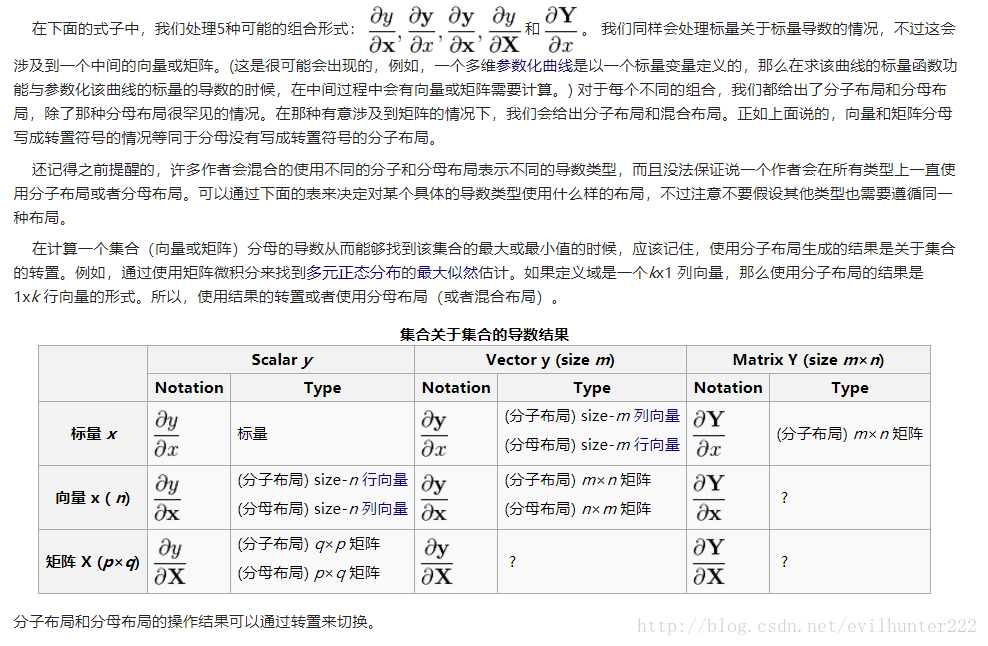

1-4步涉及到了矩陣求導知識和分子佈局、分母佈局兩種不同的規定格式(具體見wiki)

1.先將分子展開成四項,然後就可以對四個部分分別進行求導(累加後求導等於求導後累加)

2 **

佈局約定

**

這裡引用第三個連線中對wiki中矩陣求導的翻譯

相關推薦

多元線性迴歸中最優迴歸係數推導過程

背景 ** 問題的背景是從大量資料中求出迴歸方程,常用的方法就是找出誤差最小的w(存放回歸係數的向量)。一般採用的方法是下圖即平方誤差(這裡X是n*p的矩陣,y是n*1的結果向量,w便是p*1的迴歸係數向量),求和公式是誤差項的平方值,我們需要做的就是取

簡單線性迴歸-最小二乘法推導過程

最近學習線性迴歸,自己推導了一下最小二乘法。 其他參考文章: https://blog.csdn.net/chasdmeng/article/details/38869941?utm_source=blogxgwz0 https://blog.csdn.net/iter

基於迴歸曲線擬合模型的ALS(最小二乘法)推導過程以及Python實現

概念 最小二乘法(Alternative -Least-Squares)是一種迭代演算法。它通過最小化誤差的平方和尋找資料的最佳函式匹配。利用最小二乘法可以簡便地求得未知的資料,並使得這些求得的資料與實際資料之間誤差的平方和為最小。最小二乘法可用於曲線擬合。

關於Adaboos選擇最優弱分類器過程的理解

特徵的設計在此不做解釋,隨著研究的深入,很多學者豐富和改善了以前的那些特徵,最原始的矩形特徵為例: 所謂的弱分類器其實是由特徵f、閾值theta和一個決定不等號方向的p所決定的在此先不考慮p,簡單談談我理解中的選擇最優弱分類器的過程。 在上述的特徵中,第一中的特徵值

使用collapsed gibbs sampling對LDA中引數進行估計的推導過程

使用來表示文件--主題分佈的超引數,使用來表示主題--詞彙分佈的超引數,這些超引數的先驗分佈被定義在一個狄利克萊分佈中,如下所示: 在給定引數的情況下,所有隱變數(主題)的概率被定義在一個多項式分佈中,其中表示在文件m中,被賦給主題k的詞彙數量。 在給定引數的情況下,所有

【機器學習筆記02】最小二乘法(多元線性迴歸模型)

數學基礎 1.轉置矩陣 定義: 將矩陣A同序數的行換成列成為轉置矩陣ATA^TAT,舉例: A=(1203−11)A=\begin{pmatrix} 1 & 2 & 0 \\ 3 & -1 &

線性迴歸模型採用梯度下降演算法求最優解

本人學習人工智慧之深度學習已有一段時間,第一個機器學習演算法就是梯度下降演算法,本部落格將詳細闡述線性迴歸模型採用梯度下降演算法求得最優解。 本文將從運用以下流程圖講解SGD: 1、線性迴歸模型 2、代價函式 3、使用梯度下降最小化代價函式 第一部分:

2.9 線性迴歸演算法學習——kNN模型解決迴歸問題及網格搜尋最優引數

模型引入from sklearn.neighbors import KNeighborsRegressor例項化物件knn_reg=KNeighborsRegressor()訓練資料集knn_reg.fit(X_train,y_train)檢視評估的成績knn_reg.sco

多重共線性的處理(一般現象,迴歸中,自變數係數從正變成負,不符合理論)

造成多重共線性的原因有一下幾種:1、解釋變數都享有共同的時間趨勢;2、一個解釋變數是另一個的滯後,二者往往遵循一個趨勢;3、由於資料收集的基礎不夠寬,某些解釋變數可能會一起變動;4、某些解釋變數間存在某種近似的線性關係;多重共線性的檢驗;1、相關性分析,相關係數高於0.8,表

多元線性迴歸中的公式推導

這次接著一元線性迴歸繼續介紹多元線性迴歸,同樣還是參靠周志華老師的《機器學習》,把其中我一開始學習時花了較大精力弄通的推導環節詳細敘述一下。 本文用到的部分關於向量求導的知識可以參看博文標量、向量、矩陣求導 資料集D={(x1,y1),(x2,y2)⋯(xm

最小二乘法的多元線性迴歸

方法介紹 具體問題程式碼實現 資料 程式碼 本文使用scipy的leastsq函式實現,程式碼如下。 from scipy.optimize import leastsq import numpy as np def main():

機器學習線性迴歸中,用矩陣求導方法求最小二乘法的方法

在我們推導最小二乘法的時候,Andrew提供了兩種方法,一個是梯度下降法則,另一個是矩陣求導法則。後來在《機器學習實戰裡》面看線性迴歸程式碼的時候,裡面就是用了矩陣求導法則。要看懂矩陣求導法則,是需要一些矩陣論的知識的,還記得今年夏天我在苦逼地到處求矩陣論地速成

matlab做三維線性擬合(多元線性迴歸,準確來說不叫插值)

matlab三維擬合(多元線性迴歸) 問題描述 今天同學問了我一個問題,大概意思是給了你三列輸入資料,一列輸出資料,想用一個線性超平面做一個最小二乘擬合(注意這裡不能叫插值)。 一點思考 剛聽到這個問題,同學說的是做插值,說想要做一個插值,這種說法不準確的,不想說迴歸的話

Bobo老師機器學習筆記第五課-多元線性迴歸

思維導圖學習筆記 自己參考BoBo老師課程講解實現: # -*- coding: utf-8 -*- import numpy as np from metrics import r2_score class LinearRegression(object): def __

7.線性迴歸之多元線性迴歸

概念: 當自變數有多個時,迴歸模型就變成了: 多元迴歸方程變為: 估計多元迴歸方程變為: 估計方法: 多元迴歸的求解比簡單線性迴歸複雜但是思路是相同的,運用最小二乘法進行相應的求解,這裡不再進行展開。 python實現的小例子: 問題:如故一

Python金融系列第五篇:多元線性迴歸和殘差分析

作者:chen_h 微訊號 & QQ:862251340 微信公眾號:coderpai 第一篇:計算股票回報率,均值和方差 第二篇:簡單線性迴歸 第三篇:隨機變數和分佈 第四篇:置信區間和假設檢驗 第五篇:多元線性迴歸和殘差分析 第六篇:現代投資組合

Tensorflow之多元線性迴歸問題(以波士頓房價預測為例)

一、根據波士頓房價資訊進行預測,多元線性迴歸+特徵資料歸一化 #讀取資料 %matplotlib notebook import tensorflow as tf import matplotlib.pyplot as plt import numpy as np

sklearn的快速使用之四(多元線性迴歸)

from sklearn.linear_model import LinearRegression X = [[1,1,1],[1,1,2],[1,2,1]] y = [[6],[9],[8]] model = LinearRegression() r = model.f

ND4J求多元線性迴歸以及GPU和CPU計算效能對比

上一篇部落格《梯度下降法求多元線性迴歸及Java實現》簡單了介紹了梯度下降法,並用Java實現了一個梯度下降法求迴歸的例子。本篇部落格,嘗試用dl4j的張量運算庫nd4j來實現梯度下降法求多元線性迴歸,並比較GPU和CPU計算的效能差異。 一、ND4J簡介 &nb

梯度下降法求多元線性迴歸及Java實現

對於資料分析而言,我們總是極力找數學模型來描述資料發生的規律, 有的資料我們在二維空間就可以描述,有的資料則需要對映到更高維的空間。資料表現出來的分佈可能是完全離散的,也可能是聚整合堆的,那麼機器學習的任務就是讓計算機自己在資料中學習到資料的規律。那麼這個規律通常是可以用一些函式來描述,